OpenAI conclut un accord stratégique de 11,9 milliards de dollars avec CoreWeave

Donald Trump, président des États-Unis, a récemment dévoilé un projet titanesque baptisé « Stargate ». Ce programme, qui mobilise les plus grands noms de la technologie mondiale, promet de transformer le paysage de l’intelligence artificielle (IA) avec un investissement colossal de 500 milliards de dollars sur quatre ans. Voici les détails d’une initiative qui réunit innovation, ambition et géopolitique.

Stargate repose sur une alliance stratégique entre trois acteurs majeurs : OpenAI, Oracle et SoftBank. Ces entreprises unissent leurs forces pour construire la plus grande infrastructure d’IA au monde. Masayoshi Son, PDG de SoftBank, sera à la tête de cette coentreprise. Le projet démarre avec un investissement initial de 100 milliards de dollars, et prévoit d’étendre cette somme à 500 milliards dans les prochaines années. Nvidia, le géant des semi-conducteurs, joue également un rôle clé dans la fourniture des technologies nécessaires.

Le projet a déjà commencé avec la construction de data centers près d’Abilene, au Texas. Selon Larry Ellison, cofondateur d’Oracle, 10 bâtiments s’élèvent actuellement, et ce nombre pourrait doubler dans les prochaines phases. Chaque centre, équipé des dernières technologies Nvidia, couvrira environ 50 000 mètres carrés. Ces infrastructures fourniront des capacités de calcul sans précédent pour l’IA générative et d’autres applications avancées.

Cette initiative devrait créer plus de 100 000 emplois aux États-Unis et renforcer la compétitivité du pays face à la Chine. Donald Trump a souligné l’importance de cet investissement pour éviter que les technologies stratégiques ne soient dominées par des pays concurrents.

Outre son ampleur économique, Stargate s’inscrit dans une stratégie plus large de réindustrialisation et de souveraineté technologique américaine. « Cet argent aurait pu aller à la Chine. Maintenant, il renforce notre leadership », a déclaré le président américain.

Cette annonce intervient dans un contexte de compétition accrue pour la domination technologique mondiale. Avec Stargate, les États-Unis affichent leur volonté de rester en tête dans la course à l’IA, grâce à une collaboration public-privé sans précédent.

Le projet Stargate ne se limite pas à la construction d’infrastructures physiques. Il s’agit également de soutenir la recherche et d’accélérer l’émergence d’applications révolutionnaires, comme les diagnostics médicaux précoces et les vaccins personnalisés. Pour OpenAI, ce partenariat représente une opportunité unique d’atteindre son objectif ultime : développer une intelligence artificielle générale.

L’AFP et Mistral AI annoncent la signature d’un partenariat pluriannuel qui permettra à l’assistant conversationnel de ce dernier, “le Chat”, d’exploiter l’ensemble des dépêches de l’Agence afin de renforcer la qualité et la fiabilité de ses réponses tout en valorisant le travail de ses 1 700 journalistes.

Ce partenariat entre Mistral AI, licorne française et acteur européen majeur de la GenAI, et l’AFP, agence de presse mondiale qui vient de fêter ses 80 ans, permettra au Chat de s’appuyer sur les 2 300 dépêches qui enrichissent chaque jour les fils de l’AFP en six langues (français, anglais, espagnol, portugais, allemand et arabe).

Les utilisateurs bénéficieront ainsi de réponses plus détaillées, précises et sourcées, conformes aux plus hauts standards journalistiques.

Arthur Mensch, PDG et cofondateur de Mistral AI, souligne :

“S’appuyer sur une agence de presse reconnue mondialement comme l’AFP permettra au Chat d’apporter des réponses fiables et factuelles, à jour, et vérifiées par des professionnels de l’information. Nous sommes convaincus qu’augmenter la factualité des réponses est une étape clef dans le déploiement de notre technologie, notamment dans les entreprises. Grâce à ce partenariat, nous offrons à nos clients une alternative multiculturelle et multilingue inédite.”

De son côté, en intégrant ses contenus à une application conversationnelle innovante, l’AFP élargit son audience tout en affirmant sa pertinence dans un univers médiatique en mutation, et ce, sans compromettre son éthique ou sa rigueur éditoriale.

Fabrice Fries, PDG de l’AFP, commente :

“Par ce partenariat, l’AFP poursuit la diversification de ses revenus auprès d’une clientèle hors médias et s’ouvre à de nouveaux usages de ses contenus dans le quotidien des entreprises. L’AFP se réjouit de cette première avec un acteur de l’intelligence artificielle à l’identité européenne assumée, qui reconnaît ainsi, ce qui est bienvenu par les temps qui courent, la valeur d’une information vérifiée, contextualisée, hiérarchisée.”

L’intégration de l’AFP sera étendue à tous les utilisateurs du Chat dans les semaines à venir.

Le CES (Consumer Electronics Show) 2025 ouvre ses portes aujourd’hui, rassemblant des participants et des exposants du monde entier. Santé connectée, équipements de maison intelligents, voitures autonomes, puces dédiées, l’IA y sera omniprésente. Comme chaque année, différentes entreprises n’ont pas attendu son lancement officiel pour annoncer les innovations technologiques qu’ils y présenteront. C’est d’ailleurs le cas de Samsung qui lors de son événement “CES 2025 First Look”, a présenté hier Samsung Vision AI, une suite de fonctionnalités alimentées par l’IA pour ses téléviseurs.

Le CES 2025, organisé par la Consumer Technology Association (CTA), réunira plus de 4 500 exposants et attend environ 138 000 participants, dont 1 400 startups et 50 000 visiteurs internationaux. C’est à Jensen Huang, PDG de NVIDIA, nommé meilleur PDG du monde par Fortune et The Economist, figurant parmi 100 personnes les plus influentes du monde selon le magazine TIME. Qu’a été confié le rôle de prononcer le discours d’ouverture, hier soir.

Samsung Vision AI symbolise la prochaine étape dans l’évolution des écrans intelligents. Selon SW Yong, président et responsable de l’activité d’affichage visuel chez Samsung Electronics :

“Samsung ne considère pas les téléviseurs comme des appareils unidirectionnels destinés à la consommation passive, mais comme des partenaires interactifs et intelligents qui s’adaptent à vos besoins.”

Samsung Vion AI, intégrée dans une large gamme de modèles, notamment les Neo QLED, OLED, QLED et The Frame, permet aux téléviseurs de s’adapter à leur environnement, de comprendre les préférences des utilisateurs et d’offrir des fonctionnalités intuitives de manière autonome. Parmi les fonctionnalités principales :

Samsung Vision AI s’intègre également à l’écosystème SmartThings pour un mode de vie connecté :

Samsung Vision AI améliore la qualité visuelle et sonore grâce à des technologies d’IA embarquées qui analysent et ajustent dynamiquement les paramètres selon le contenu et l’environnement.

Par exemple, le modèle Neo QLED 8K QN990F, le téléviseur le plus avancé de Samsung, utilise des fonctionnalités telles que la mise à l’échelle 8K AI Pro et la remasterisation HDR automatique Pro pour offrir des visuels réalistes et des couleurs éclatantes. Son adaptatif Pro sépare et optimise les composants sonores tels que la parole, la musique et les effets sonores pour une immersion totale.

Samsung, qui prévoit de travailler en étroite collaboration avec des partenaires d’IA de premier plan tels que Google et d’autres pour étendre les fonctionnalités de Vision AI, a annoncé un partenariat avec Microsoft visant à intégrer l’assistant Copilot de ce dernier à ses téléviseurs et moniteurs intelligents.

Lors de CES 2025 First Look, il a également dévoilé le Premiere 5, le premier projecteur interactif à ultra-courte focale (UST) à trois lasers de l’industrie et le miroir à affichage innovant MICRO LED Beauty Mirror.

Le jeudi 28 novembre dernier, lors de l’événement Impact PME, Antoine Armand, ministre de l’Économie, des Finances et de l’Industrie, et Clara Chappaz, secrétaire d’État chargée de l’Intelligence artificielle et du Numérique, ont lancé l’appel à manifestation d’intérêt “IA au service de l’efficience”. Initialement prévue pour le 31 décembre 2024, la date de soumission a été repoussée au 15 janvier 2025.

L’IA représente une opportunité stratégique pour stimuler la croissance économique en augmentant la compétitivité, l’innovation et la productivité dans de nombreux secteurs mais son adoption est freinée par des préoccupations liées à son fonctionnement.

Piloté par la DGE, l’AMI vise à recueillir des exemples concrets d’intégrations réussies de l’IA afin de renforcer la confiance, offrir des perspectives pratiques et motiver d’autres organisations à adopter la transformation par l’IA.

Les projets lauréats seront mis en avant lors du Sommet pour l’action sur l’IA qui se déroulera les 10 et 11 février 2025, bénéficiant ainsi d’une visibilité internationale.

L’AMI est ouvert à l’ensemble des entreprises (microentreprises, PME, ETI incluses), administrations publiques et organisations internationales qui ont mis en œuvre des projets d’IA visant à améliorer la compétitivité, les capacités d’innovation et la productivité de l’une des thématiques prioritaires : l’IA pour l’administration publique, l’IA pour les entreprises ou l’IA pour l’industrie.

Les organisations intéressées sont invitées à soumettre leurs contributions pour examen dans ces trois domaines thématiques et sous-thèmes, y compris mais sans s’y limiter :

IA pour les entreprises

Cette thématique explore comment l’intelligence artificielle peut transformer les opérations commerciales dans les organisations :

IA pour l’industrie

Cette thématique explore comment l’intelligence artificielle peut augmenter la productivité et améliorer la durabilité dans diverses industries (par exemple, la fabrication, le transport, l’énergie, la santé) :

IA pour l’administration publique

Cette thématique explore comment l’intelligence artificielle peut fondamentalement améliorer les opérations gouvernementales et les services publics :

Les projets déposés devront remplir plusieurs critères :

Si vous désirez candidater, cliquez ici.

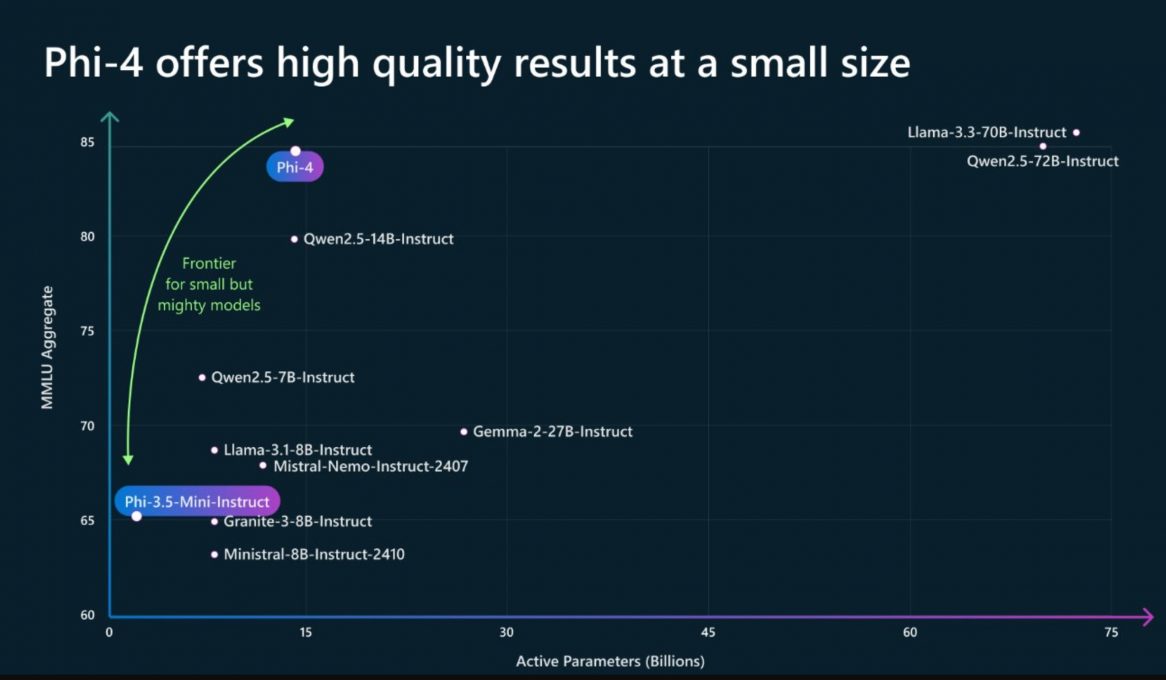

Avec Phi-4, Microsoft démontre une nouvelle fois qu’il est possible de concilier performance et compacité. Ce SLM de 14 milliards de paramètres qui selon l’entreprise “excelle dans le raisonnement complexe dans des domaines tels que les mathématiques, en plus du traitement du langage conventionnel”, a réussi à surpasser sur certains benchmarks des modèles de pointe tels que Gemini Pro 1.5, GPT-4o ou Claude 3.5 Sonnet.

Alors qu’on a pu voir arriver des LLMs affichant un nombre de paramètres de plus en plus impressionnant, certains acteurs de l’IA comme Mistral AI ou Google proposent désormais des modèles beaucoup plus compacts. Microsoft, avec ses modèles Phi, s’est intéressé au potentiel des SLMs dès avril 2023. Alors qu’il a dévoilé les modèles Phi-3,5 : Phi-3.5-mini-instruct, Phi-3.5-MoE-instruct, et Phi-3.5-vision-instruct, optimisé chacun pour des tâches spécifiques, en août dernier, il introduit Phi-4.

Selon Microsoft, si Phi-4 surpasse des modèles comparables et plus grands sur le raisonnement lié aux mathématiques, c’est grâce aux progrès réalisés depuis le développement de Phi-3.5. Il explique cette avancée par :

On peut voir dans l’image ci-dessous qu’il surpasse largement LLama-3.1-8B_Instruct et que ses performances sont légèrement en deçà de celles de LLama-3.3-70B-Instruct.

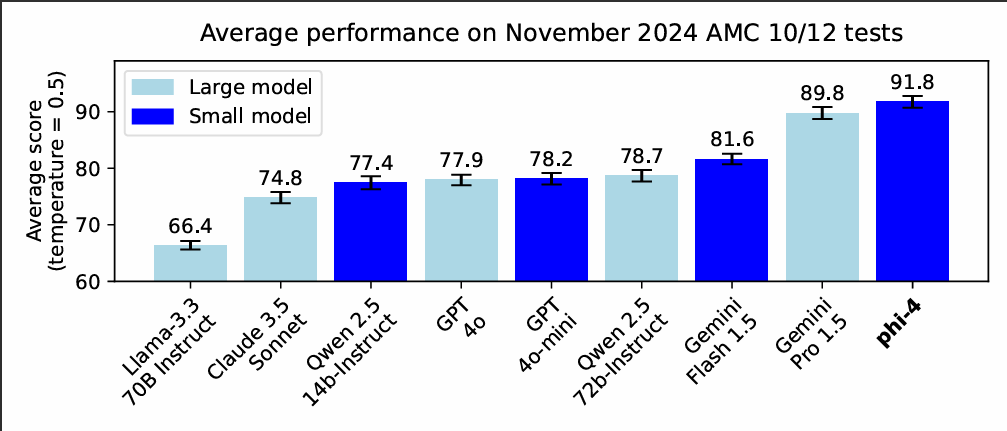

Microsoft a évalué ses performances sur des benchmarks de compétitions mathématiques organisées par la Mathematical Association of America (MAA), notamment les tests AMC 10/12, conçus pour évaluer les compétences en trigonométrie, algèbre, géométrie et probabilité des élèves du secondaire.

Phi-4 a obtenu des résultats impressionnants, surpassant des modèles plus grands comme Gemini Pro 1.5, Claude 3.5 Sonnet et GPT-4o, comme on peut le constater dans ce graphique.

Phi-4 est disponible sous un accord de licence de recherche via Azure AI Foundry. Présentée à Ignite 2024, le mois dernier, cette plateforme fournit des outils robustes pour évaluer, atténuer et gérer les risques liés à l’IA, ce qui garantit une utilisation sûre du modèle. Celui-ci sera également accessible sur Hugging Face dans les prochains jours.

Microsoft Ignite 2024 s’est déroulé la semaine dernière à Chicago. L’événement a été riche en annonces et innovations pour les entreprises, notamment dans les domaines de l’IA, de la sécurité et des outils de collaboration. Parmi les principales annonces, de nouveaux agents d’IA pour Microsoft 365, le nouveau service “Azure AI Foundry” ou un mini-PC basé sur le cloud.

Actuellement en beta privée, les “Copilot Actions” sont conçues pour automatiser les tâches répétitives au sein de Microsoft 365. Ces outils permettent, à partir d’un prompt, de recevoir un résumé quotidien des actions importantes, automatiser la collecte de feedback pour une newsletter hebdomadaire, ou préparer des réunions avec les résumés de dernières interactions avec les clients.

Microsoft introduit de nouveaux agents pour Copilot dans Microsoft 365 qui permettent de trouver rapidement des informations, de résumer des documents et de répondre aux questions courantes des employés.

Copilot dans Teams et PowerPoint : une collaboration enrichie

Copilot dans Teams peut désormais comprendre, récapituler et répondre aux questions basées sur le contenu visuel partagé à l’écran, en plus de la transcription et du chat. Dans PowerPoint, Copilot peut traduire des présentations entières dans 40 langues tout en conservant la conception des diapositives.

Copilot dans Outlook : planification et personnalisation

Copilot dans Outlook aide à planifier des entretiens individuels et à rédiger des ordres du jour de réunion. Les utilisateurs peuvent désormais personnaliser l’apparence de leur interface avec des thèmes uniques.

Agents en libre-service et interprétation en temps réel

Les nouveaux agents en libre-service pour les employés dans Business Chat répondent rapidement aux questions de politique courantes et facilitent l’exécution des tâches clés. L’agent d’interprétation dans Teams fournit une interprétation vocale en temps réel pendant les réunions. Pour une expérience plus personnelle, l’utilisateur peut choisir de lui demander d’imiter sa voix.

Microsoft a également présenté Azure AI Foundry, une plateforme conçue pour rationaliser le développement, la personnalisation ainsi que la gestion d’applications et d’agents d’IA au sein des entreprises.

Elle se compose du portail Azure AI Foundry, anciennement Azure AI Studio, qui a évolué vers une console de gestion d’entreprise centralisée, et du SDK Azure AI Foundry, un kit de développement logiciel unifié qui facilite l’intégration des modèles avec des environnements de développement familiers tels que GitHub et Visual Studio.

Microsoft a dévoilé le Windows 365 Link, un mini-PC basé sur le cloud destiné aux entreprises. Ce dispositif compact permet aux employés de se connecter à leur environnement de travail depuis n’importe où en intégrant pleinement le service Windows 365. Il supporte des moniteurs 4K doubles, dispose du Wi-Fi 6E et du Bluetooth 5.3, et sera disponible en avril 2025 au prix de 349 $.

Teradata, une plateforme d’analyse et de données cloud pour l’IA, a récemment annoncé la nomination de Louis Landry au poste de Chief Technology Officer (CTO). Fort de plus de 20 ans d’expérience en architecture logicielle et ingénierie, Louis Landry prend les rênes de la stratégie technologique de l’entreprise à un moment charnière pour le secteur de l’analytique et de l’IA.

Louis Landry est titulaire d’une licence en informatique acquise à l’université Louisiana Tech et s’est vu décerner un Rethink Strategy Certificate par la Harvard Business School.

Entré chez Teradata il y a plus de 10 ans, il a gravi les échelons pour devenir, en 2020, vice-président de la Technologie et de l’Innovation de l’entreprise. Dans ce rôle, il a piloté plusieurs initiatives stratégiques, notamment Teradata ask.ai et Teradata AI Unlimited, le premier moteur d’IA/ML à la demande de l’entreprise, qui ont positionné cette dernière comme un acteur clé dans l’intégration de l’IA générative et des plateformes de données connectées.

Auparavant, il a occupé des postes de direction clés au sein de la société, notamment celui d’Engineering Fellow et CTO of Unified Data Architecture Platform Technologies.

Dans un contexte où la demande en solutions d’IA et d’analytique s’accélère, la nomination de Louis Landry reflète l’engagement de Teradata envers l’innovation.

Steve McMillan, PDG de Teradata, souligne :

“Je ne peux imaginer meilleur choix que Louis pour veiller à ce que notre roadmap technologique réponde aux besoins actuels et futurs de nos clients et de nos prospects. Je suis ravi que Louis prenne la direction des opérations tandis que nous continuons de construire l’avenir de Teradata en tant que plateforme d’IA hybride. Sa compréhension approfondie du marché et des nouvelles technologies dans le domaine des données et de l’analytique nous permettra de tirer pleinement parti de l’innovation en tant que facteur clé pour une croissance accélérée”.

Avant de rejoindre les rangs de Teradata, Louis Landry a occupé plusieurs postes importants chez MicroStrategy, où il était chargé du développement de produits analytiques. Chez Sears Holdings Corporation, il a dirigé la conception d’une plateforme d’acquisition de données en temps réel à l’aide de technologies open source. Chez eBay Inc., il a supervisé le développement d’une plateforme analytique destinée aux principaux vendeurs du marché, ainsi qu’un projet interne d’analyse as-a-Service visant à rendre l’entreprise plus data-driven.

Louis Landry a également apporté d’importantes contributions à la communauté open source en tant que Project Leader and Development Coordinator dans le cadre du projet Joomla! de 2005 à 2011.

Pour lui, ce nouveau rôle est une opportunité de faire progresser la mission de Teradata. Il commente :

“À l’heure où l’IA transforme les entreprises, la fiabilité des données, les performances et l’efficacité à l’échelle de Teradata offrent exactement les bases dont les entreprises ont besoin. Je suis ravi de contribuer à la poursuite des avancées de notre plateforme ouverte et connectée, en apportant la prochaine génération de valeur axée sur l’IA à nos clients dans l’environnement de leur choix”.

AMD prévoit de réduire ses effectifs de près de 1 000 employés. Cette restructuration intervient dans un contexte économique difficile pour sa division gaming, confrontée à une chute de 69 % de ses revenus sur un an, et la volonté de l’entreprise à s’imposer sur le marché des puces d’IA où NVIDIA est le leader incontesté.

Lisa Su, présidente et PDG d’AMD, déclarait le 29 octobre dernier aux investisseurs :

“Nous avons enregistré de solides résultats financiers au troisième trimestre avec un chiffre d’affaires record grâce à l’augmentation des ventes de produits de centres de données EPYC et Instinct et à une forte demande pour nos processeurs PC Ryzen. Pour l’avenir, nous voyons d’importantes opportunités de croissance dans nos centres de données, nos clients et nos activités intégrées, en raison de la demande insatiable de plus de calcul”.

Si AMD, qui employait 26 000 personnes fin 2023, n’a pas donné plus de précisions sur ces licenciements, une partie d’entre eux concernera sans doute la division gaming.

Un porte-parole de l’entreprise a déclaré :

“Dans le cadre de l’alignement de nos ressources sur nos plus grandes opportunités de croissance, nous prenons un certain nombre de mesures ciblées qui entraîneront malheureusement une réduction de notre effectif mondial d’environ 4% “.

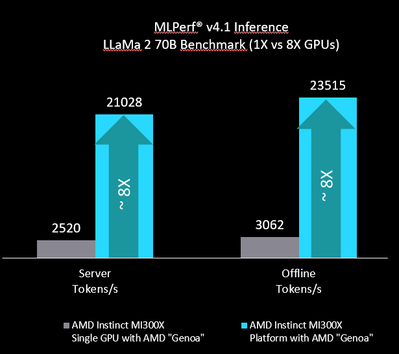

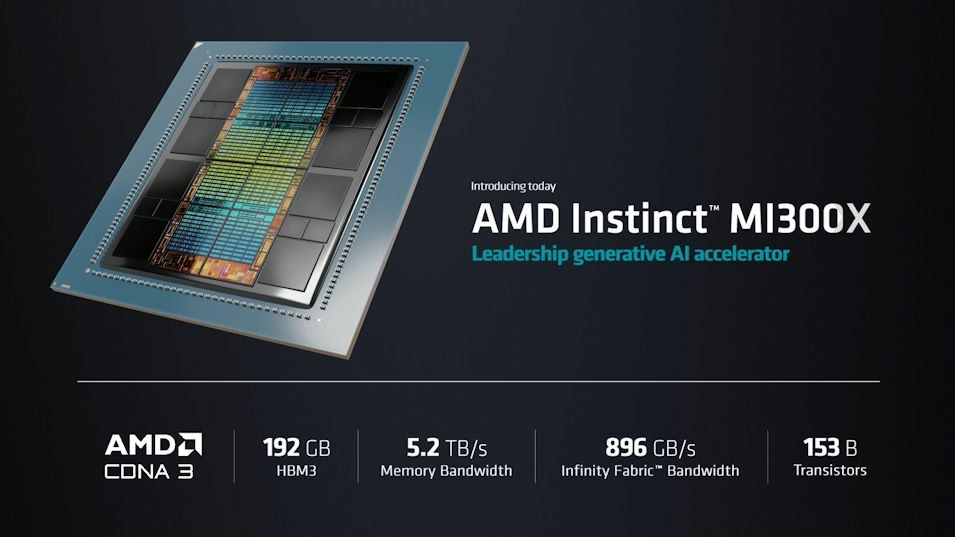

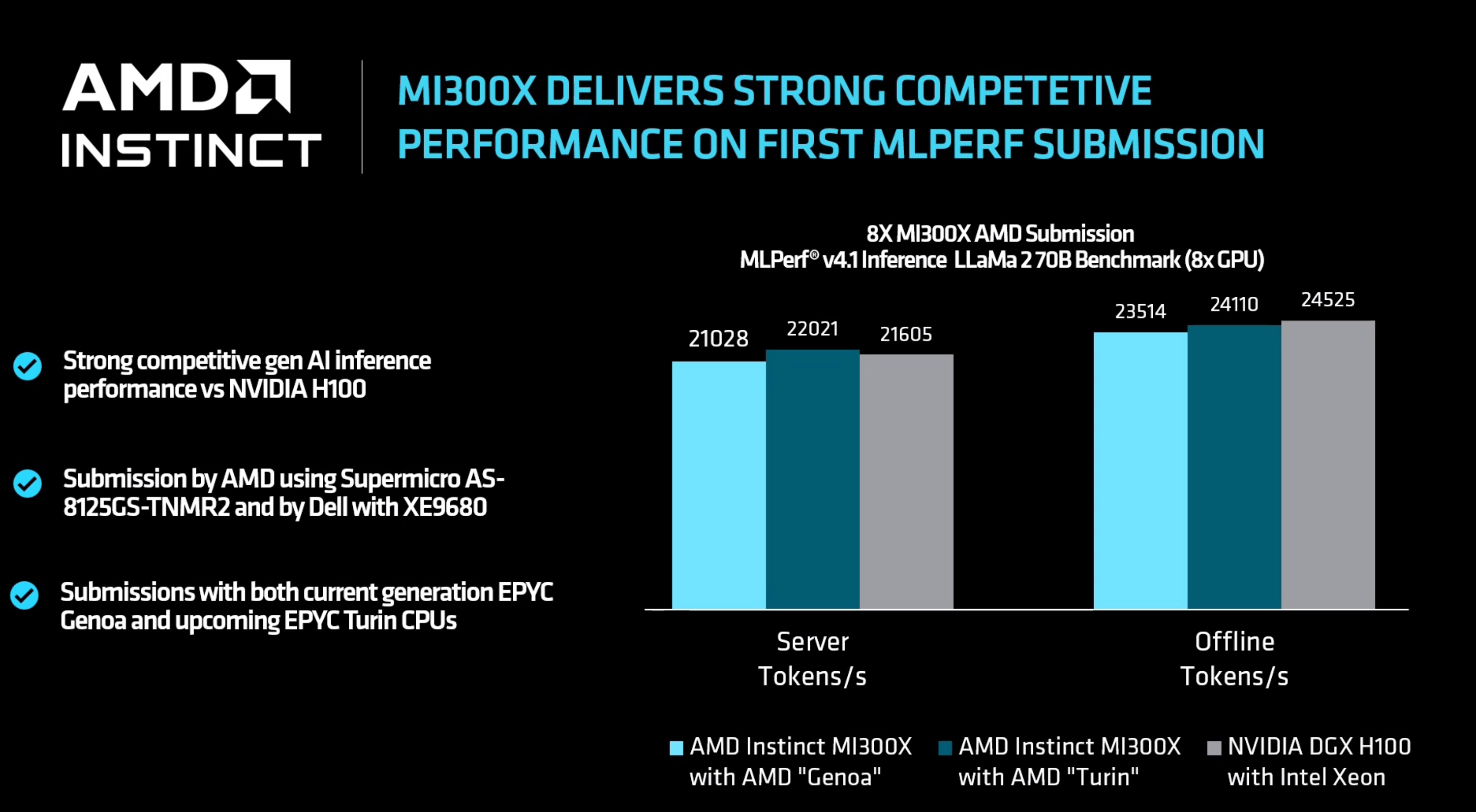

La société s’attendait à ce que son chiffre d’affaires pour le quatrième trimestre 2024 s’élève à environ 7,5 milliards de dollars, soit une croissance de 22 % par rapport à l’année précédente, portée notamment par la vente de son GPU Instinct MI300X , qu’elle présente comme un sérieux concurrent au H100 de NVIDIA.

Malgré ces bons résultats, le cours de l’action AMD a chuté d’environ 16,5% depuis le 29 octobre 2024 alors que celui de NVIDIA, porté par une demande accrue pour ses GPU dédiés aux data centers, a augmenté de 200% depuis le début de l’année.

Pour autant, AMD compte bien lui reprendre des parts de marché avec l’Instinct MI325X, qui devrait être disponible début 2025, l’Instinct MI350 au semestre suivant et l’Instinct MI400 en 2026.

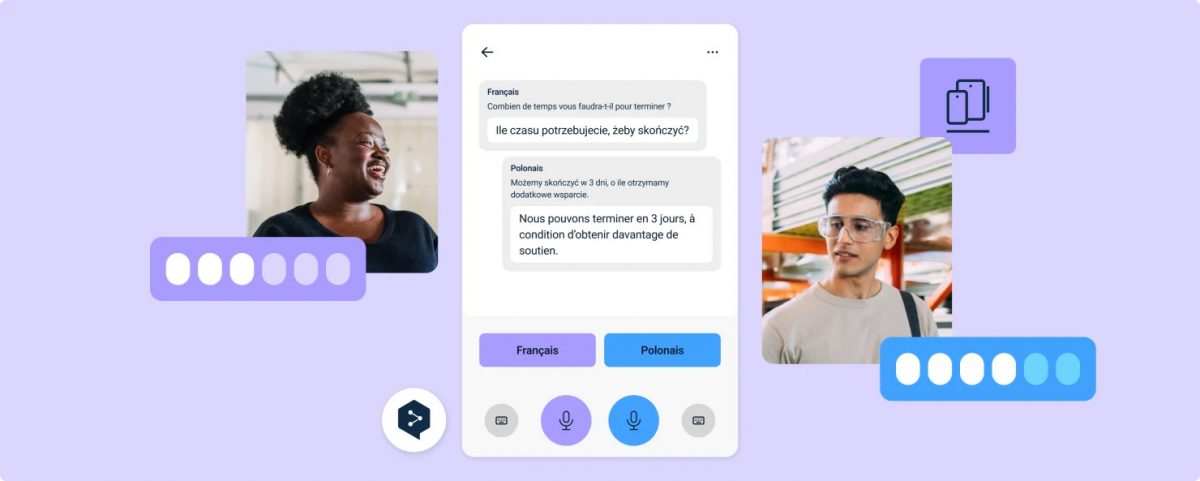

DeepL, l’un des leaders mondiaux de l’IA linguistique, a dévoilé hier lors de sa conférence DeepL Dialogues à Berlin, sa première solution de traduction vocale en temps réel : DeepL Voice. Disponible en deux déclinaisons, DeepL Voice pour réunions et DeepL Voice pour conversations, elle vise à rendre les échanges professionnels plus fluides, en réduisant les barrières linguistiques pour des entreprises évoluant dans un contexte globalisé.

Fondée en 2017 par Jaroslaw (Jarek) Kutylowski, son directeur général, la licorne allemande DeepL, s’est donnée la mission d’affranchir de la barrière de la langue les entreprises du monde entier. Plus de 100 000 entreprises et gouvernements et des millions de particuliers sur 228 marchés internationaux font déjà confiance aux traductions, aussi bien de contenus écrits que de conversations orales, de la plateforme d’IA linguistique de DeepL et à son assistant de rédaction, DeepL Write.

En mai dernier, DeepL a levé 300 millions de dollars, valorisant à 2 milliards l’entreprise qui a intégré la liste Cloud 100 de Forbes.

Conçues pour répondre aux besoins de sécurité des entreprises, les solutions basées sur cette IA permettent à celles-ci de changer leur façon de communiquer, de se lancer sur de nouveaux marchés et d’optimiser leur productivité.

Jarek Kutylowski explique :

“En tant qu’entreprise, la traduction vocale en temps réel avec la qualité et la sécurité éprouvées de DeepL était notre prochain défi. Nous sommes heureux de pouvoir enfin dévoiler aujourd’hui nos premiers produits. Pour y parvenir, nous nous sommes appuyés sur l’expertise et les modèles que nous avons développés depuis notre création en 2017, et avons travaillé en étroite collaboration avec des clients dans le cadre d’un programme bêta afin de proposer une solution adaptée aux défis quotidiens des entreprise”.

Soulignant :

“DeepL est déjà leader dans la traduction de contenus écrits, mais la traduction de la parole en temps réel pose de tout autres défis : informations incomplètes, problèmes de prononciation et latence sont quelques-uns des facteurs qui peuvent entraîner des traductions inexactes et une mauvaise expérience utilisateur. Ces mêmes éléments peuvent conduire à des malentendus dans les interactions personnelles. Nous avons donc conçu une solution qui en tient compte dès le départ et qui permet aux entreprises de dépasser la barrière de la langue en leur donnant la possibilité de communiquer dans plusieurs langues, selon leurs besoins”.

Avec DeepL Voice, l’entreprise fait sa première incursion dans le secteur de la traduction vocale. La sécurité et la qualité de traduction de pointe qui ont fait sa réputation sont également au cœur de ses deux nouveaux produits.

Cette solution permet à tous les participants de s’exprimer dans la langue de leur choix, tandis que leurs contributions sont traduites en temps réel et affichées sous forme de sous-titres aux autres. Les membres d’une même équipe peuvent ainsi échanger dans leur langue maternelle, pour une communication plus claire et dynamique que jamais.

DeepL Voice pour conversations

Disponible sur appareils mobiles, la solution facilite les échanges multilingues avec les clients, entre employés, en face-à-face, grâce à des sous-titres. L’outil propose deux modes de visualisation pratiques pour que chaque personne puisse suivre les traductions facilement sur un seul appareil.

DeepL Voice prend d’ores et déjà en charge les langues parlées suivantes (d’autres seront ajoutées par la suite) : anglais, allemand, japonais, coréen, suédois, néerlandais, français, turc, polonais, portugais, russe, espagnol et italien, avec des sous-titres traduits disponibles dans les 33 langues prises en charge par DeepL Translator.

L’Adobe Firefly Summit 2024, en avril dernier, a été l’occasion pour l’éditeur de logiciels graphiques dont InDesign, Acrobat, Photoshop et Illustrator, de présenter les innovations qui allaient permettre aux marques d’optimiser leur créations de contenu. Cette semaine, lors de sa conférence annuelle Adobe MAX, il a lancé la version bêta de l’extension de la famille à la génération vidéos à partir de texte ou d’image : Firefly Video.

Adobe avait dévoilé le modèle le mois dernier et donné un accès anticipé à certains créateurs, la version bêta publique est déployée dans l’application Web Firefly, mais pour y accéder, il faut au préalable s’inscrire sur la liste d’attente. Pour l’instant, la durée maximale des clips générés n’est que de cinq secondes.

Tout comme Sora, le modèle text-to-video d’OpenAI, Movie Gen, présenté récemment par Meta, Firefly Video peut générer des vidéos à partir d’une invite textuelle. Plus celle-ci sera détaillée, comprenant des descriptions précises de la prise de vue, des mouvements de caméra, de l’éclairage et de l’ambiance, plus elle répondra aux attentes de l’utilisateur, comme ci-dessous.

Prompt : Gros plan cinématographique et portrait détaillé d’un homme âgé au milieu d’une rue la nuit. L’éclairage est sombre et dramatique. L’homme a une texture de peau détaillée extrêmement réaliste et des pores visibles. Le mouvement est subtil et doux. La caméra ne bouge pas. Grain de pellicule. Objectif anamorphique vintage.

Le modèle peut générer des séquences vidéo B-roll pour compléter des plans manquants ou des effets visuels comme du feu ou de la fumée que l’on peut ensuite superposer sur une vidéo existante, à l’aide de modes de fusion ou d’incrustations dans des outils Adobe tels qu’Adobe Premiere Pro ou Adobe After Effects.

Prompt : Fuites de lumière sur fond noir, texture organique, réaliste.

Composite dans Premiere Pro avec le mode de fusion Écran

Firefly permet également de créer des vidéos à partir d’images fixes, donnant une nouvelle vie aux bibliothèques de photos existantes. Par exemple, un simple cliché de fleurs peut être transformé en une vidéo avec l’invite “les fleurs bougent dans le vent et un papillon se pose délicatement sur l’une d’entre elles”

Adobe s’engage à adopter une approche éthique de l’IA. Le modèle Firefly est exclusivement entraîné sur des contenus sous licence ou du domaine public. En outre, chaque création générée par Firefly intègrera des Content Credentials, qui offrent une transparence totale sur l’origine du contenu et le rôle de l’IA dans sa création.

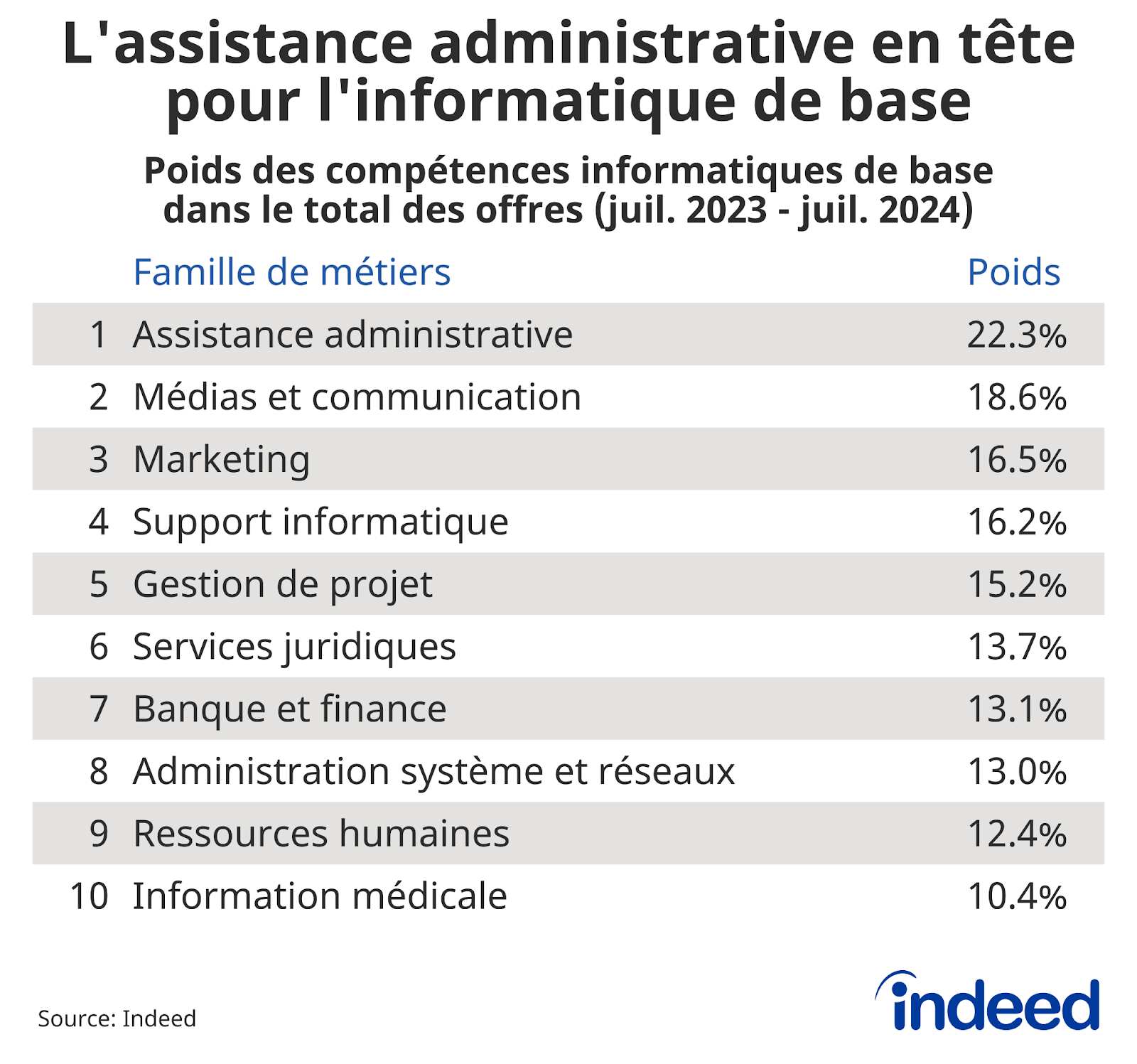

Selon la dernière étude menée par l’Institut de recherche économique Hiring Lab d’Indeed, une entreprise américaine spécialisée dans la recherche d’emploi en ligne, bien que l’IA et d’autres technologies avancées soient appelées à transformer le marché du travail, de nombreux employeurs continuent de valoriser les compétences informatiques de base.

L’étude d’Indeed révèle que les compétences numériques élémentaires, telles que la maîtrise du pack Office et l’utilisation de logiciels courants, figurent dans 13 % des offres d’emploi en France. Ces compétences IT restent particulièrement recherchées dans des secteurs comme l’assistance administrative (22 % des offres), les médias et la communication (19 %), ainsi que le marketing (17 %). Cette récurrence montre que même dans un monde où l’automatisation prend de l’ampleur, la capacité à utiliser un ordinateur de façon fluide est encore un atout clé sur le marché du travail.

Par contre, ces compétences techniques de base ne sont que très peu requises dans les offres d’emploi concernant les professions en présentiel comme la puériculture, les soins personnels et médicaux à domicile ou le transport routier.

En parallèle des compétences techniques, l’étude souligne également l’importance croissante des compétences humaines. L’anglais, par exemple, reste la compétence non technique la plus fréquemment mentionnée dans les offres d’emploi, suivi du sens du service client et des capacités organisationnelles. Ces qualités sont de plus en plus recherchées dans un contexte où les interactions humaines et la collaboration restent des piliers essentiels dans de nombreux secteurs.

Si l’intelligence artificielle promet de bouleverser de nombreux métiers, les compétences directement liées à l’IA ne représentent encore qu’une petite part des offres d’emploi en France. En 2024, seulement 1,5 à 2,5 % des annonces mentionnent des compétences en IA, une proportion encore modeste mais en augmentation depuis 2022, surtout dans les secteurs de la finance, des ressources humaines et du juridique.

Cependant, un segment spécifique lié à l’IA connaît une croissance explosive : celui de l’IA générative, avec une multiplication par 15 des offres d’emploi contenant ce type de compétence depuis 2022, avec l’arrivée de ChatGPT. Bien que ces offres soient encore rares (environ 0,15 % des annonces), leur rapide ascension pourrait annoncer une transformation du marché de l’emploi dans les années à venir.

En plus des compétences de base, certaines compétences techniques plus avancées sont également en forte demande. Par exemple, des logiciels spécialisés comme Power BI dans la finance, ADP dans les ressources humaines, ou Amadeus dans le secteur de l’hôtellerie-restauration gagnent en importance. Cela montre que les recruteurs, tout en insistant sur les compétences fondamentales, commencent à valoriser des connaissances plus spécifiques en fonction des métiers et des secteurs d’activité.

En France, les offres d’emploi dans les segments très techniques, comprenant des métiers tels que le développement informatique, l’ingénierie industrielle ou la recherche scientifique, ont diminué de 4 % par rapport à leur niveau d’avant la pandémie. Ce segment se distingue par des offres nécessitant plusieurs compétences techniques spécifiques.

En revanche, les métiers moins techniques connaissent une dynamique différente. Les segments faiblement techniques, où une seule compétence technique est généralement requise, ont vu une augmentation des offres de 59 % depuis la pandémie. Les professions moyennement techniques, quant à elles, ont enregistré une hausse de 20 %. Ces chiffres soulignent une tendance de fond où la demande pour des compétences plus généralistes, notamment les compétences IT de base, est en forte croissance.

Ce ralentissement dans les métiers très techniques pourrait surprendre dans un contexte où les avancées technologiques se multiplient. Toutefois, il reflète une réalité où les entreprises, tout en s’adaptant aux nouvelles technologies, continuent de valoriser les compétences élémentaires.

L’IA, bien qu’en pleine expansion, n’a pas encore pleinement redéfini le marché du travail. Cependant, plus les compétences numériques de la main-d’œuvre progresseront, plus la diffusion des innovations numériques sera rapide, augmentant ainsi les gains de productivité.

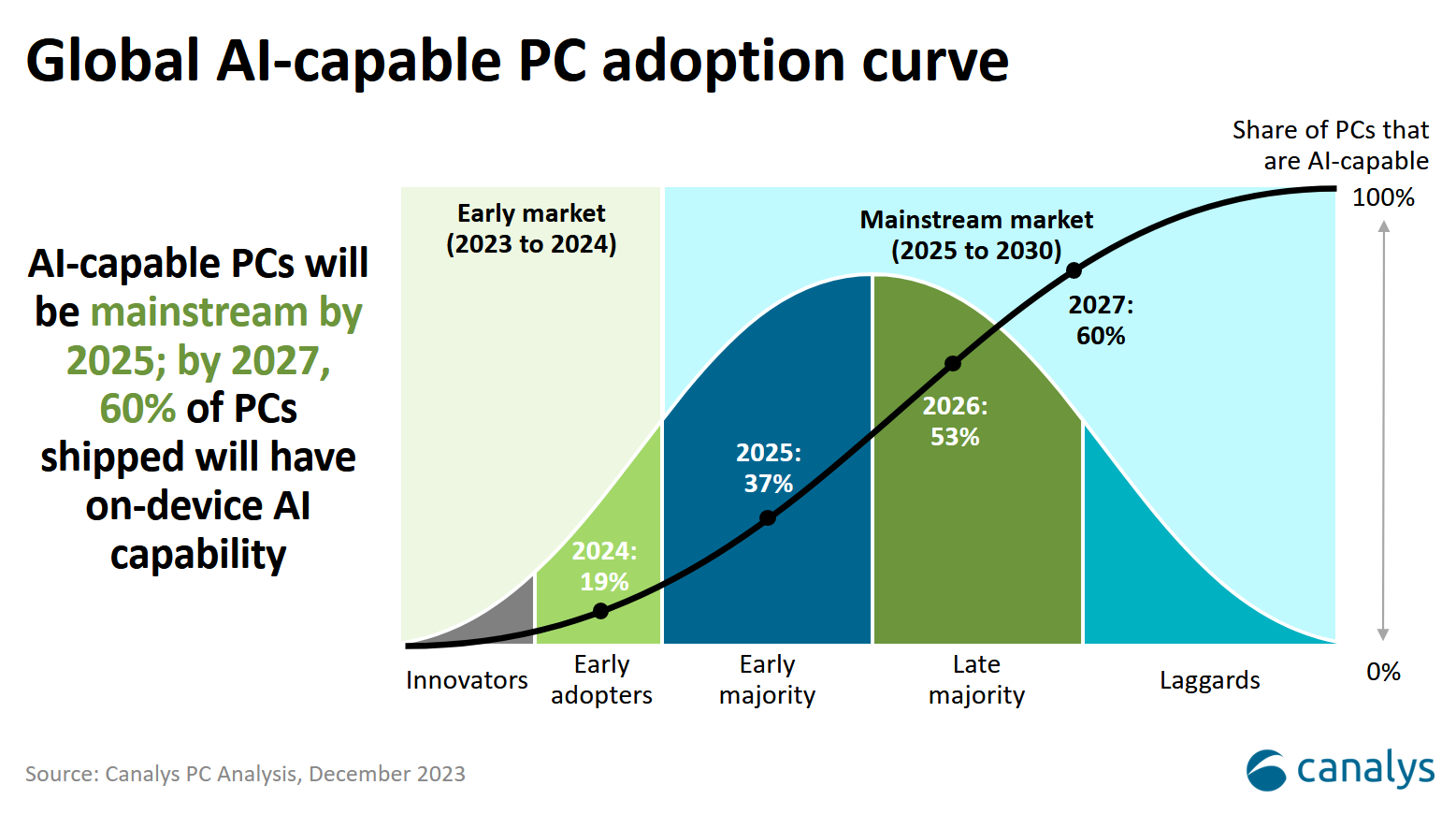

La Chine ne cache pas son ambition de rattraper et dépasser les USA dans le domaine de l’IA pour en devenir le leader mondial. Considérant la GenAI comme un moteur de croissance et un atout concurrentiel clé, elle a annoncé en octobre 2023, un plan pour augmenter sa puissance de calcul globale de plus de 50 % d’ici 2025, visant 300 exaflops. Alors qu’elle s’en approche aujourd’hui, elle fait face à une surabondance d’infrastructures et une inadéquation croissante entre la capacité de calcul disponible et la demande réelle du marché.

La Chine a massivement investi dans les infrastructures de datacenters ces dernières années, pour répondre à la demande croissante liée à l’explosion de l’usage d’Internet, de l’IA, du cloud computing, et des services numériques. Elle a atteint une puissance de calcul totale de 246 exaflops, représentant 26 % du total mondial, juste derrière les États-Unis.

Ce chiffre impressionnant découle de la multiplication des centres de données à travers le pays, soutenue par des gouvernements locaux, des opérateurs télécoms et des investisseurs privés. Plus de 250 centres ont été construits ou sont en cours de construction.

Cependant, selon le Centre d’information d’État de Chine, les taux d’utilisation des CPU dans ces centres sont étonnamment bas, avoisinant seulement 5 %. La course à la construction a créé une surcapacité massive, avec de nombreux centres de données peu connectés aux besoins du marché réel : des régions comme la Mongolie Intérieure ou le Xinjiang, où les coûts énergétiques sont plus bas, ont attiré des projets de datacenters, mais n’ont pas vu de demande de services de calcul suffisante en raison de leur éloignement des grands centres économiques chinois comme Pékin, Shanghai ou Shenzhen.

À cette surabondance s’ajoute un problème technique majeur : le retard de la Chine dans la fabrication des puces de pointe et l’inadéquation des GPU. Alors que l’IA et le traitement de grandes quantités de données nécessitent des unités de traitement graphique (GPU) de pointe, la Chine souffre d’un manque criant de ces équipements essentiels. Les restrictions imposées par les États-Unis, notamment l’interdiction à Nvidia et d’autres fournisseurs américains comme Micron et AMD, de lui vendre des puces avancées, ont compliqué l’accès à ces technologies essentielles pour les applications d’IA à grande échelle.

Dans un premier temps, Nvidia avait donc décidé de vendre à la Chine des produits alternatifs répondant aux exigences du gouvernement : les puces A800 et H800, moins performantes que les GPU A100 et H100, mais assez puissantes pour entraîner des modèles d’IA générative. De nouvelles restrictions ont été annoncées, notamment la vente des puces A800 qui a été interdite sans licence d’exportation spéciale des États-Unis, appliquée également aux sociétés fournissant des solutions informatiques basées sur le cloud utilisées par certaines entreprises chinoises pour contourner les contrôles à l’exportation.

En effet, la Chine est encore loin de la finesse de gravure de 3 nm du leader mondial, le groupe Taiwan Semiconductor Manufacturing Company (TSMC), quand bien même le 1er fondeur du pays SMIC (Semiconductor Manufacturing International Corp), a commencé à produire des puces gravées en 7 nm l’an passé.

En réponse aux restrictions, le gouvernement chinois a encouragé l’utilisation de matériel local, malgré les défis d’intégration. Par exemple, certains centres de données comme celui de China Mobile à Harbin fonctionnent avec des GPU fabriqués en Chine. Cependant, leur complexité d’utilisation en clusters de grande échelle empêche une exploitation optimale des infrastructures. Ces équipements restent moins performants, ce qui pourrait limiter la capacité des modèles d’IA générative chinois à rivaliser avec leurs concurrents étrangers.

Des acteurs de la GenAI chinois ont malgré tout présenté dernièrement des modèles text-to-video, avec l’objectif de rattraper, voire surpasser, leurs concurrents américains : Zhipu AI,Kuaishou, et plus récemment Minimax, une start-up par d’anciens employés de SenseTime, soutenue par Alibaba et Tencent.

Alors que dans le cadre de ses priorités politiques, la Chine entend continuer à encourager l’application de la GenAI dans des secteurs clés tels que l’industrie manufacturière, l’agriculture, l’éducation et la santé afin de renforcer l’économie, elle doit relever le défi de transformer ces installations sous-utilisées en moteurs réels de croissance économique et d’innovation technologique.

Les professionnels de l’automatisation jouent un rôle essentiel dans la modernisation et l’optimisation des processus au sein des entreprises. Chaque année, UiPath, l’un des leaders de l’automatisation des processus robotiques (RPA), enquête auprès d’eux pour appréhender leurs perceptions et l’évolution du secteur. Menée auprès de 1 909 professionnels et étudiants, l’édition 2024 révèle une transition notable dans les tâches des développeurs d’automatisation, ainsi qu’une forte adoption de l’IA pour améliorer la productivité des entreprises.

L’étude UiPath 2024 révèle une année charnière pour l’automatisation, marquée par l’intégration de l’IA, la croissance des équipes spécialisées et l’évolution des tâches des développeurs.

En 2024, l’IA est devenue une composante incontournable des projets d’automatisation : 81 % des répondants indiquent utiliser des produits d’IA dans leurs projets d’automatisation au moins plusieurs fois par semaine, voire quotidiennement.

Selon le rapport, 90 % des professionnels de l’automatisation utilisent ou prévoient d’intégrer l’IA dans leurs workflows d’ici la fin de l’année. La principale raison avancée pour cette intégration est l’augmentation de la productivité, citée par 66 % des répondants.

Les développeurs d’automatisation utilisent l’IA de diverses manières, notamment pour :

Le rapport met en avant une croissance significative des équipes d’automatisation, reflet d’un marché en pleine expansion : 61 % des répondants ont observé une augmentation du nombre d’employés travaillant dans ce domaine au cours des 12 derniers mois. De plus, 81 % s’attendent à des embauches supplémentaires dans l’année en cours.

52 % des entreprises comptent désormais au moins 25 professionnels de l’automatisation, un chiffre en constante augmentation. Cette expansion témoigne de l’adoption généralisée de l’automatisation, devenue un levier clé de transformation pour les entreprises.

L’étude révèle, comme chaque année, un changement dans la typologie des tâches réalisées par les développeurs d’automatisation. Selon les résultats, en 2024, les tâches liées à la révision du code et à la documentation ont diminué par rapport à 2023, une optimisation des processus d’automatisation et l’amélioration des outils utilisés.

Parmi les activités exercées au moins une fois par semaine, les plus courantes sont :

Pour accompagner cette évolution rapide, 98 % des professionnels de l’automatisation ont suivi une formation au cours de l’année écoulée. Parmi les méthodes les plus populaires :

L’utilisation des moteurs d’IA (33 %) et des vidéos sur les réseaux sociaux (20 %) est en augmentation, ces deux nouvelles méthodes ayant fait leur apparition en 2024.

Le rapport souligne que 84 % des répondants croient fermement en la croissance du secteur de l’automatisation logicielle. D’ailleurs 80 % d’entre eux estiment qu’ils joueront un rôle de plus en plus important au sein de leur organisation au cours de l’année à venir. Aujourd’hui, 60 % des entreprises utilisent des solutions d’automatisation depuis plus de cinq ans, contre 47% l’année dernière, ce qui marque une maturité croissante dans l’intégration de ces technologies.

Les automatisations sont principalement développées pour les secteurs de la comptabilité et la finance (67 %), l’informatique (53 %) et les opérations (51 %).

Si des défis persistent, comme la documentation incomplète ou les variations dans les processus, l’avenir de l’automatisation s’annonce prometteur, porté par des innovations technologiques et des équipes de plus en plus compétentes et polyvalentes.

Agi Garaba, Chief People Officer chez UiPath, commente:

“Les résultats de notre enquête montrent des progrès notables en matière de découverte technologique et de préparation à l’IA et à l’automatisation. Les professionnels de l’automatisation ont tout à gagner à sauter le pas des intégrations spécialisées d’IA et de GenAI dans leurs projets d’automatisation.

La combinaison de l’automatisation et de l’IA offre un potentiel de transformation inouï pour les organisations, en augmentant la productivité tout en donnant à ces professionnels essentiels les moyens de faire passer leur carrière à la vitesse supérieure. En outre, des workflows d’IA agentique encore plus performants devraient arriver très prochainement sur le marché et devraient offrir de nouvelles perspectives aux entreprises”.

Télécharger le rapport ici.

Depuis 2017, l’éditeur de logiciels Berger-Levrault, et Inria, l’Institut national de recherche en sciences et technologies du numérique, travaillent de concert pour accélérer le développement de solutions numériques basées sur l’IA destinées aux secteurs des collectivités, de la santé et de l’industrie auxquels Berger-Levrault s’adresse. Ils ont récemment présenté les résultats concrets de leur collaboration.

Berger-Levrault fournit des solutions logicielles de ressources humaines, de gestion financière et de gestion de maintenance. En 2021, le partenariat avec Inria a été renforcé, avec un objectif partagé : construire un numérique plus responsable.

Les résultats de cette collaboration illustrent parfaitement la valeur ajoutée d’une alliance entre la recherche académique et le secteur industriel. L’un des principaux aboutissements est la création d’un outil de génération de code qui accélère considérablement le développement des logiciels chez Berger-Levrault. Cet outil booste la productivité des équipes de production, permettant une mise sur le marché plus rapide des solutions.

Les équipes d’Inria et de Berger-Levrault ont par ailleurs intégré des solutions de réalité augmentée aux logiciels de maintenance. Celles-ci facilitent l’accès instantané à l’information et offrent des services de téléassistance aux techniciens sur le terrain, garantissant ainsi des interventions plus rapides et précises.

Elles ont également développé des algorithmes d’IA dédiés à l’Internet des objets (IoT) et au edge computing. Ces solutions optimisent la maintenance prédictive des équipements et infrastructures, permettant une gestion énergétique plus efficace et une réduction des coûts opérationnels.

Parmi les autres réalisations, on trouve des assistants intelligents, développés pour les clients de divers secteurs de Berger-Levrault, alimentés par des IA génératives sécurisées et spécifiques à la réglementation de chaque métier. Parmi eux, le premier assistant personnel conçu spécifiquement par et pour les secrétaires de mairie des collectivités de moins de 5 000 habitants.

Il est clair pour les deux partenaires que les assistants numériques joueront un rôle central dans les solutions de gestion. Ils travaillent donc à relever plusieurs défis afin de pouvoir optimiser l’interaction homme-machine grâce à la GenAI.

Ils s’efforcent donc de renforcer les capacités de mémoire et de raisonnement des IA, et d’optimiser leur efficience énergétique afin de minimiser l’impact environnemental.

Mustapha Derras, directeur de la recherche et de l’innovation technologique chez Berger-Levrault, souligne :

“Les défis que nous relevons avec Inria témoignent de l’importance d’investir en amont dans la recherche. Notre collaboration de longue date délivre des résultats tangibles qui accélèrent l’innovation numérique au service des utilisateurs de nos solutions”.

Shahin Hodjati, directeur des opérations pour la direction générale déléguée à l’innovation chez Inria, conclut :

“Nous constatons avec grande satisfaction les résultats positifs de la collaboration avec Berger-Levrault dans le domaine du génie logiciel. Aujourd’hui, la mise en production de résultats scientifiques et technologiques apporte un impact significatif à Berger-Levrault. Nous nous réjouissons également de la confiance mutuelle établie entre nos directions respectives et de la volonté de Berger-Levrault d’étendre nos collaborations, notamment sur les sujets gravitant autour de l’intelligence artificielle”.

Ce 1er octobre, le projet DATAWISE (Data Annotation Technology Advancement With Innovative Solutions for Efficiency), lauréat de l’AAP R&D Booster de la région AURA (Auvergne-Rhône-Alpes), est officiellement lancé. Porté par Neovision, en collaboration avec le laboratoire LIRIS (Laboratoire d’Informatique en Images et Systèmes d’Information), ce projet a pour objectif automatiser l’annotation des données, étape cruciale pour l’entraînement des modèles d’IA en vision par ordinateur.

Datawise est l’un des projets labellisés par Minalogic, le pôle de compétitivité des technologies du numérique en Auvergne-Rhône-Alpes, retenus par le programme R&D Booster de la région AURA, dans la thématique “Intelligence Artificielle”. Ce dispositif vise à favoriser et soutenir des projets collaboratifs de R&D entre acteurs de la recherche académique et entreprises de la région pour concrétiser le développement de nouveaux produits, procédés ou services.

Ce projet d’automatisation d’annotation des données a été proposé par Neovision, une société grenobloise créée en 2014, experte en ML et computer vision, spécialisée dans le développement de solutions d’IA sur mesure et est mené en collaboration avec le LIRIS. Cette unité mixte de recherche (UMR 5205) du CNRS, de l’INSA de Lyon, de l’Université Claude Bernard Lyon 1, de l’Université Lumière Lyon 2 et de l’Ecole Centrale de Lyon, à laquelle nous avions consacré un article dans le n° 10 de notre magazine est largement reconnue pour ses travaux de pointe dans les domaines du traitement d’image, des systèmes d’information et des sciences des données.

L’accès à de vastes volumes de données de qualité est essentiel pour le développement de modèles d’IA performants. Cependant, dans des domaines comme la vision par ordinateur, la préparation et l’annotation manuelles de ces données, fastidieuses et chronophages, représentent souvent un obstacle majeur.

Comme l’explique Stefan Duffner, chercheur au LIRIS,

“Cette préparation des données peut considérablement ralentir les cycles de développement des IAs et détourner les Data Scientists de leur cœur de métier : l’analyse et la valorisation des données”.

Ce partenariat allie l’innovation technologique du secteur privé aux dernières avancées académiques, créant une synergie propice à la création de solutions robustes et évolutives pour répondre aux besoins des secteurs industriels. Il permettra de développer des technologies capables d’automatiser non seulement l’annotation des données, mais également leur nettoyage, permettant ainsi d’accélérer le développement des modèles d’IA et d’en améliorer les performances tout en limitant les biais.

Lucas Nacsa, PDG et cofondateur de Neovision, explique :

“Les IA dédiées au traitement d’images sont souvent initialement entraînées sur des tâches simples, comme la reconnaissance de chiens ou de chats, avant de passer à des objets plus complexes. Cette méthode d’apprentissage limite parfois leurs performances. Notre ambition est de développer des modèles capables de s’entraîner directement sur des données industrielles complexes, sans nécessiter une préparation manuelle massive des données. Cela représente un bond en avant significatif en matière de performance et accélère considérablement le processus de création de solutions d’IA.”

En automatisant l’annotation des données, DATAWISE ouvrira de nouvelles perspectives pour de nombreux secteurs industriels, en particulier ceux qui manipulent de grandes quantités de données visuelles. Les technologies développées dans le cadre de ce projet rendront les solutions d’IA plus accessibles et renforceront la compétitivité des entreprises, notamment en leur permettant d’exploiter des bases de données jusqu’ici sous-utilisées.

À terme, les partenaires envisagent l’intégration de grands modèles de langage (LLM) aux outils développés, afin d’améliorer l’ergonomie des solutions et ainsi encourager leur adoption par les entreprises.

Precisely, une entreprise spécialisée depuis plus de 50 ans dans le domaine des données, a publié une nouvelle étude menée en collaboration avec le LeBow College of Business de l’Université Drexel, une école de commerce de Philadelphie. Intitulée “2025 Outlook: Data Integrity Trends and Insights”, cette étude met en lumière les défis majeurs auxquels les entreprises sont confrontées en matière de préparation des données pour l’adoption de l’IA et d’autres initiatives liées à la gestion des données.

Cette étude a été menée au cours du premier semestre 2024, 565 professionnels des données et de l’analytique du monde entier y ont participé.

Bien que 60 % des entreprises interrogées reconnaissent l’influence croissante de l’IA sur leurs programmes de gestion des données (soit une hausse de 46 % par rapport à 2023), seulement 12 % estiment que la qualité de leurs données est suffisante pour soutenir des initiatives efficaces en matière d’IA. L’étude souligne une méfiance persistante des entreprises envers leurs propres données, avec 67 % d’entre elles déclarant ne pas faire entièrement confiance aux données utilisées dans leurs processus décisionnels, un chiffre en hausse par rapport à 55 % en 2023.

Le manque de gouvernance des données est identifié comme le principal obstacle à l’adoption de l’IA par 62 % des répondants. Les entreprises peinent à suivre où sont stockées leurs données, qui y a accès et si elles contiennent des informations personnelles sensibles, ce qui complique les initiatives d’IA.

Outre les problèmes de qualité et de gouvernance des données, 42 % des entreprises signalent que la pénurie de compétences et de ressources nécessaires à la gestion des données, à l’analytique et à l’IA s’est également aggravée cette année.

Pour Murugan Anandarajan, directeur académique du Center for Applied AI and Business Analytics à Drexel LeBow, le manque de compétences et de formation en IA est un défi stratégique crucial pour les dirigeants. Il affirme :

“Alors que les organisations sont impatientes de bénéficier des capacités de l’IA, une pénurie de talents entrave l’intégration de l’IA. Les résultats de notre recherche mettent en évidence cette lacune, puisque 60 % des personnes interrogées citent le manque de compétences et de formation en matière d’IA comme un défi important pour le lancement d’initiatives en matière d’IA – un signal pour les dirigeants que l’amélioration des compétences doit être un impératif stratégique”.

L’étude montre une détérioration des perceptions de la qualité des données, avec 77 % des entreprises classant la qualité de leurs données comme « moyenne » ou « pire » en 2024, contre 66 % l’année précédente. Le manque d’outils d’automatisation pour 49 %, l’incohérence des formats de données (45 %) et le volume de données (43 %) figurent parmi les obstacles les plus fréquemment cités.

Par conséquent, 64 % des entreprises placent désormais la qualité des données en tête de leurs priorités en matière d’intégrité des données.

L’étude montre par ailleurs que la piètre qualité des données continue d’avoir un effet domino sur tous les aspects de l’intégrité des données, 50 % des personnes interrogées déclarant que la qualité est le principal problème pour les projets d’intégration des données de leur entreprise.

Malgré ces défis, l’étude révèle une augmentation significative des efforts en matière de gouvernance des données. En 2024, 71 % des entreprises interrogées déclarent avoir mis en place des programmes de gouvernance des données, contre 60 % en 2023. Les entreprises ayant investi dans ces programmes constatent des améliorations :

L’étude met également en évidence l’importance croissante de l’enrichissement des données et de l’analyse spatiale, deux initiatives clés pour maximiser l’innovation et la compétitivité des entreprises, qui ont émergé l’an passé. En 2024, 28 % des entreprises considèrent l’enrichissement des données comme une priorité, contre 23 % en 2023.

Josh Rogers, CEO de Precisely, conclut :

“L’étude que nous avons menée conjointement avec Drexel LeBow révèle un déclin marqué de la confiance que les entreprises accordent à la préparation de leurs données malgré l’importance croissante de la prise de décision basée sur les données. Pour tirer pleinement parti des avantages métiers qu’apportent l’analytique et l’IA, les entreprises doivent investir dans l’intégrité des données. L’établissement d’un socle de données à la fois précises, cohérentes et contextualisées peut les aider à prendre des décisions avisées en toute confiance ainsi qu’à véritablement bénéficier de la valeur de leurs initiatives en faveur de l’IA”.

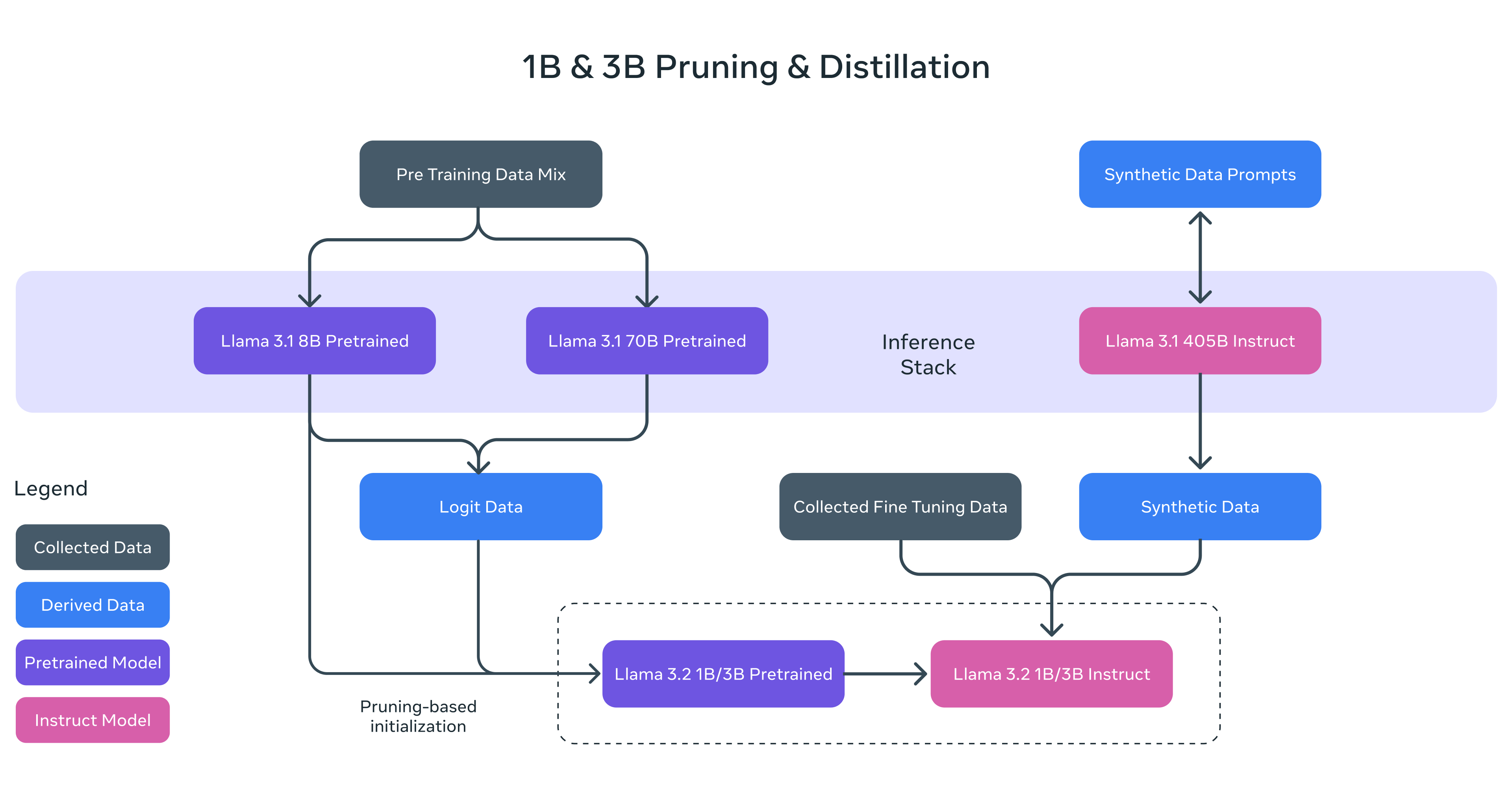

Meta a dévoilé hier, lors de sa conférence annuelle Meta Connect, la dernière itération de sa famille Llama 3, Llama 3.2. Celle-ci se compose de quatre modèles : les deux plus grands (11B et 90B), multimodaux, peuvent traiter les images, tandis que les deux plus légers (1B et 3B) sont uniquement textuels, comme leurs prédécesseurs. Destinés aux smartphones et aux périphériques, ces modèles de petite taille sont disponibles pour l’Europe, contrairement aux modèles de vision, du moins jusqu’à ce que Meta et l’UE trouvent un terrain d’entente.

Pour rappel, c’est en juillet dernier que Meta avait dévoilé la famille de modèles Llama 3.1 : Llama 3.1 8B et Llama 3.1 70B, deux versions améliorées de Llama 3 7B et Llama 3 70B présentés en avril dernier, mais également Llama 3.1 405B. Ce nombre impressionnant de paramètres fait de ce dernier le plus grand modèle open source à ce jour.

Comme les modèles Llama 3.1, les quatre versions Llama 3.2 sont multilingues et disposent d’une fenêtre contextuelle pouvant aller jusqu’à 128 000 jetons.

Pour la première fois, les modèles Llama intègrent des capacités de traitement d’images grâce à une nouvelle architecture intégrant un encodeur d’image au modèle de langage. Ils prennent en charge les entrées de texte et d’image ainsi que la sortie de texte, ce qui les rend adaptés à des tâches comme l’analyse de graphiques, la génération de légendes d’images, ou le “visual grounding” comme la localisation directionnelle d’objets dans des images à partir de descriptions en langage naturel.

Les modèles sont prêts à l’emploi pour de nombreux cas d’usage dès leur téléchargement, sans avoir besoin d’entraînements supplémentaires complexes. Sinon, ils peuvent être peaufinés facilement avec TorchTune, puis déployés localement avec TorchChat, ce qui offre une flexibilité maximale pour des applications spécifiques tout en assurant un contrôle local des données et des ressources.

Ces modèles compacts sont conçus pour fonctionner de manière optimale sur des appareils légers, tels que les téléphones mobiles ou les dispositifs embarqués. Meta a utilisé des techniques d’élagage (pruning) et de distillation pour maintenir des performances élevées sur des tâches telles que la synthèse, le suivi d’instructions et la réécriture, tout en réduisant leur taille pour une meilleure efficacité sur ces appareils.

Disponibles en versions pré-entraînées ou adaptées pour le suivi d’instructions, ils permettent une personnalisation facile pour diverses applications. Optimisés pour les processeurs basés sur l’architecture Arm, ils sont d’ores et déjà disponibles pour les appareils équipés de puces Qualcomm et MediaTek.

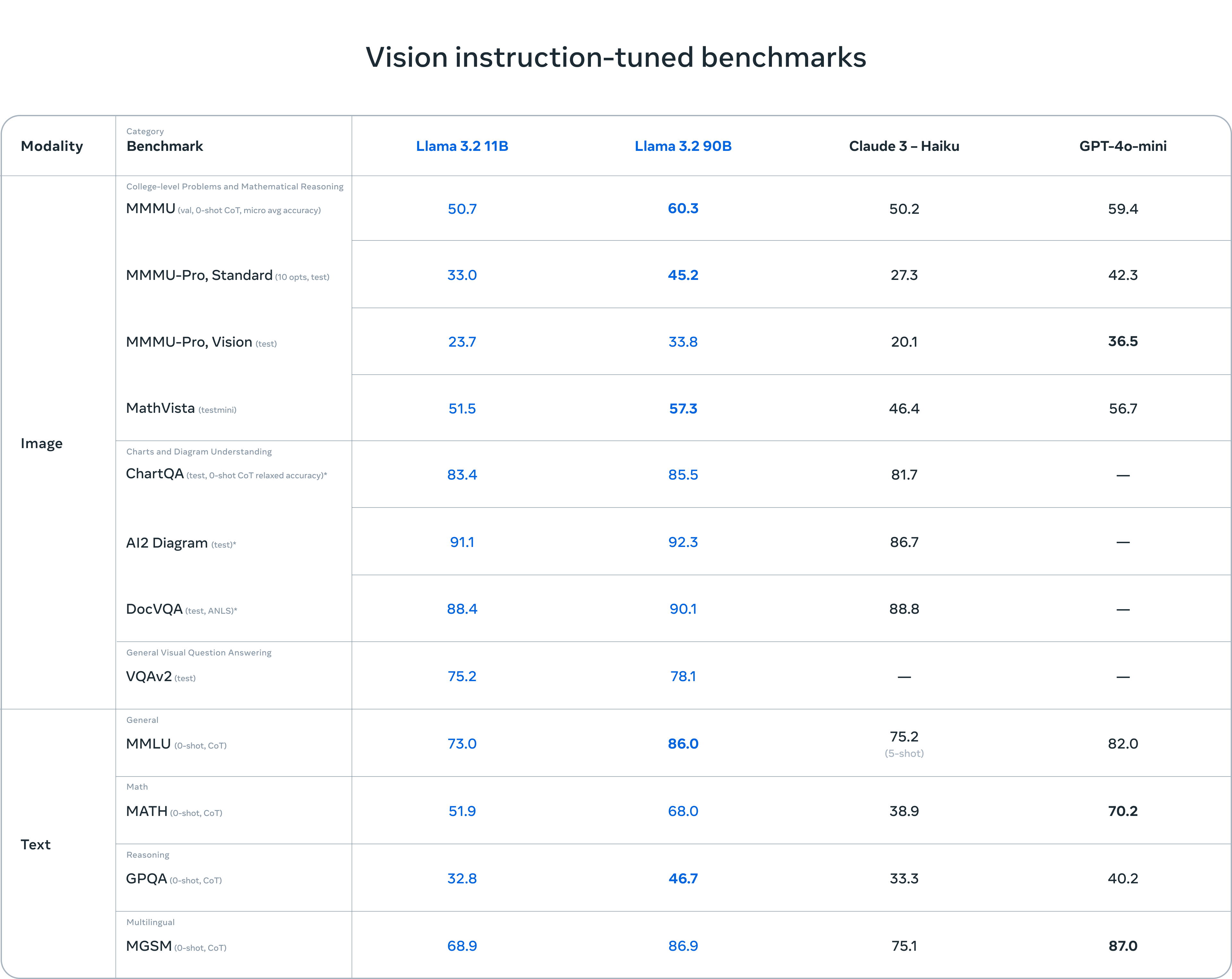

Les modèles de vision Llama 3.2 (11B et 90B) sont compétitifs avec des modèles leaders comme Claude 3 Haiku et GPT4o-mini sur des tâches de reconnaissance d’image et de compréhension visuelle.

Le modèle 3B surpasse des concurrents comme Gemma 2.6B et Phi 3.5-mini dans des tâches comme le suivi d’instructions, la synthèse et l’utilisation d’outils. Le modèle 1B, plus léger, reste compétitif avec Gemma.

Meta continue de promouvoir une approche ouverte pour encourager l’innovation. Les modèles Llama 3.2 sont disponibles au téléchargement via llama.com et Hugging Face, et peuvent être utilisés directement sur un large éventail de plateformes partenaires.

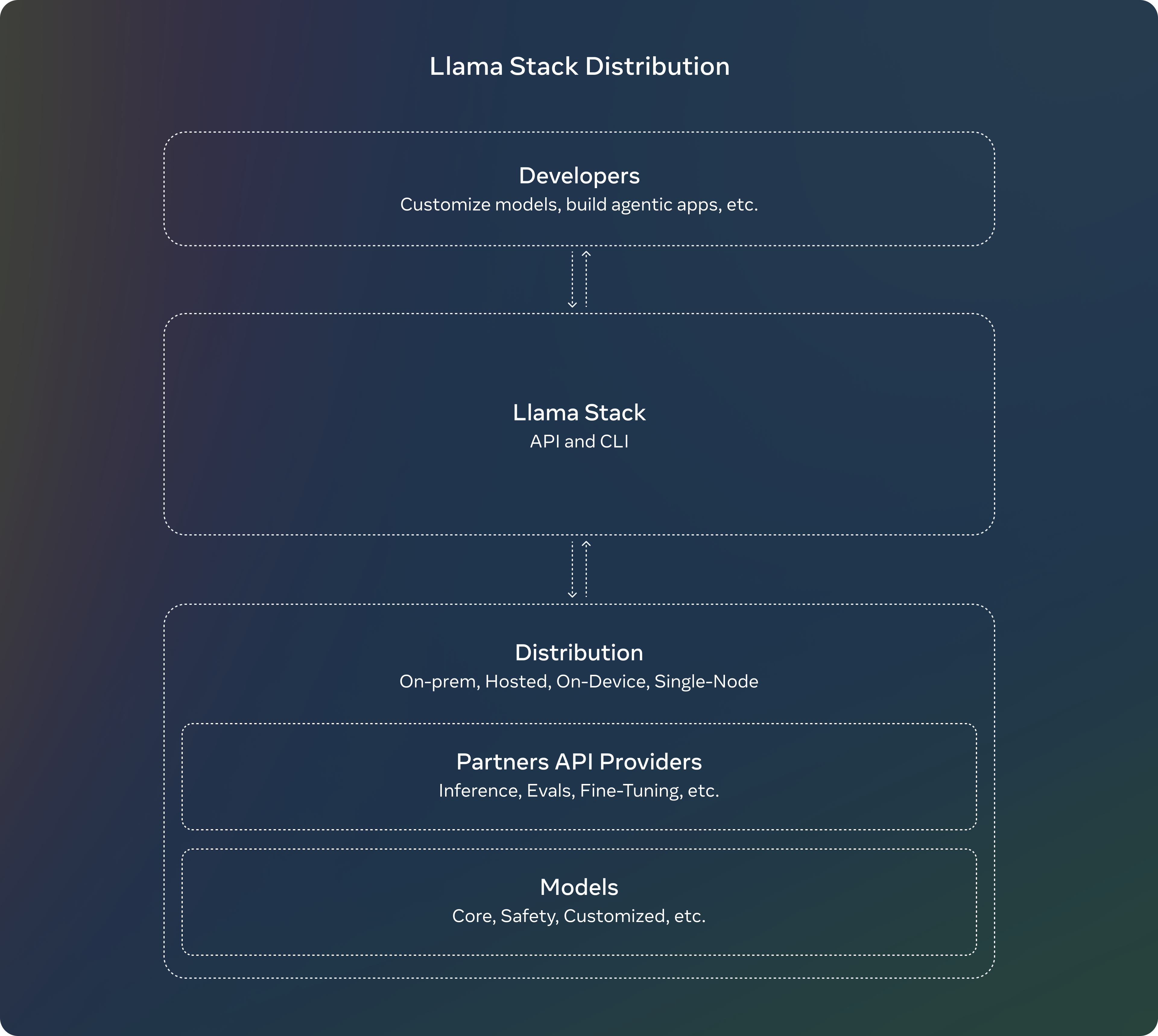

Meta a également introduit les premières distributions de Llama Stack, une suite d’outils conçus pour simplifier le déploiement de ces modèles dans différents environnements y compris en mode nœud unique, sur site, dans le cloud et sur appareil. La distribution sur appareil se fait via PyTorch ExecuTorch, et la distribution en mode nœud unique via Ollama.

Les distributions regroupent plusieurs fournisseurs d’API pour offrir aux développeurs un point d’accès unique. Elles incluent une interface en ligne de commande (CLI), du code client en plusieurs langages (Python, Node, Kotlin, Swift), ainsi que des conteneurs Docker pour simplifier l’intégration. Elles offrent une solution clé en main pour travailler avec les modèles Llama 3.2 dans des contextes variés.

Les étudiants d’aujourd’hui ont grandi avec Internet et les réseaux sociaux. Alors que l’IA générative s’est imposée elle aussi dans leur quotidien, la plateforme d’IA AIPRM a voulu savoir dans quelle mesure ils s’en servaient au Royaume-Uni pour tricher.

Christopher Cemper, fondateur et PDG de LinkResearchTools, Link Detox et URLinspector, est un expert reconnu dans le domaine de l’optimisation des moteurs de recherche (SEO) et du marketing numérique. Il a lancé AIPRM (AI Prompt Repository Manager) pour répondre à la demande croissante d’outils capables de faciliter l’interaction avec les modèles d’IA générative comme ChatGPT.

L’objectif de la plateforme, développée par les experts de LinkResearchTools et URLinspector, est de permettre à ses utilisateurs d’optimiser leur utilisation de ce modèle ainsi que celle de Claude, Midjourney et DALL-E 3, en proposant une gestion efficace des prompts. Elle donne accès à plus de 4 000 invites, vérifiées et approuvées par la communauté, facilitant la création de contenu marketing, de vente, d’exploitation, et d’assistance à la clientèle.

Le recours à la tricherie n’est pas nouveau, souvent motivé par une pression pour obtenir de bons résultats, une mauvaise gestion du temps, ou un manque de compréhension des attentes académiques. Elle englobe divers comportements, tels que la demande d’aide à un parent ou un ami pour rédiger un devoir, la copie sur un autre élève, l’achat de dissertations, l’utilisation d’outils ou de notes interdits lors des examens, ou encore le copier-coller sur Internet.

Les enseignants ont habituellement recours à des logiciels pour déceler le plagiat des textes publiés sur le web, mais détecter un contenu généré par l’IA lorsque l’étudiant a ajouté quelques touches personnelles est beaucoup plus ardu, ce qui avait d’ailleurs amené certaines écoles à interdire ou à limiter l’utilisation de ChatGPT .

Des études ont révélé qu’aujourd’hui les étudiants utilisent fréquemment la GenAI dans le cadre de leurs études (86 %), plus de la moitié (54 %) y ayant recours chaque semaine, notamment pour la production de contenu sans attribution, une nouvelle forme de tricherie. Les écoles ont investi dans des logiciels de détection de génération par l’IA, mais ceux-ci peuvent manquer de fiabilité.

Alors que selon une étude de l’Université de Stanford, plus d’un étudiant sur six admet avoir triché, AIPRM a envoyé plus de 150 demandes d’accès à l’information aux universités britanniques pour découvrir combien d’étudiants ont été pris en flagrant délit de tricherie à l’aide de l’IA au cours des deux dernières années, et où ces infractions sont les plus fréquentes.

Les résultats, provenant des 80 universités disposant de données, montrent que plus de quatre universités sur cinq (82,5 %) ont enquêté sur l’utilisation abusive de l’IA.

Les étudiants de Birmingham City University sont ceux qui ont eu le plus recours à l’IA pour tricher, avec 402 cas au cours des deux dernières années académiques. L’université est celle qui a le plus souffert de l’essor de la GenAI, avec 307 de ces cas survenus en 2022/2023. En comparaison, Birmingham Newman University n’a signalé aucune infraction.

Juste derrière Birmingham City, l’Université de Leeds Beckett a infligé 395 pénalités aux étudiants tricheurs. Parmi ces cas, 205 proviennent de l’année universitaire 2023/2024, indiquant que l’utilisation de l’IA pour tricher est en augmentation dans cette université.

L’Université de Coventry a rapporté 231 sanctions pour utilisation de l’IA, l’Université Robert Gordon 211, suivie de l’Université de Hull avec 193 pénalités. À l’opposé, des universités britanniques comme Cambridge, le Conservatoire royal d’Écosse, l’Université de Londres, l’Université de Gloucestershire, et le Royal College of Art n’ont signalé aucune sanction.

| Universités | Nombre de sanctions |

| Birmingham City University | 402 |

| Leeds Beckett University | 395 |

| Coventry University | 231 |

| Robert Gordon University | 211 |

| University of Hull | 193 |

| Birkbeck, University of London | 147 |

| Leeds Trinity University | 119 |

| University of Lincoln | 82 |

| University of Kent | 74 |

| Abertay University | 72 |

Christopher C. Cemper commente les résultats de l’enquête et explique comment utiliser l’IA de manière éthique dans les études universitaires :

“Utilisez l’IA comme un ami ou un assistant, mais pas comme un substitut pour rédiger votre travail. L’IA peut être une excellente ressource pour trouver des recherches académiques, générer des idées et résumer des articles. Cependant, assurez-vous que le travail reste le vôtre et qu’il conserve son originalité. Par exemple, l’IA peut vous aider avec la grammaire et le style d’écriture, mais ne l’utilisez pas pour rédiger un article ou une section entière de votre devoir”.

“Utilisez l’IA comme un guide pour améliorer vos compétences, mais veillez toujours à appliquer vos propres capacités de réflexion critique et à ajouter une touche humaine. Cependant, ne présentez pas le travail produit par l’IA comme le vôtre ou sans attribution appropriée, sinon vous risquez de lourdes sanctions pour plagiat”.

MV Group, premier groupe indépendant en marketing digital en France, annonce le prochain lancement d’IA VISTA, une plateforme innovante qui promet de transformer les campagnes marketing grâce à l’IA et à la Data. Avec un investissement de plusieurs millions d’euros sur ces prochaines années, ce projet ambitieux marque une étape clé dans l’évolution numérique du groupe.

Créé en 2010, basé à Cesson-Sévigné, près de Rennes, en Bretagne, MV Group s’est donné pour mission d’accroître la performance de ses clients en utilisant tous les leviers du digital : data, webmarketing et médias. Comptant aujourd’hui huit filiales et deux écoles, il a pris en 2017 une avance significative en matière de data grâce à l’acquisition stratégique d’Avanci, une agence de data spécialisée en stratégie de fidélisation clients, renforcée en 2022 par celle du groupe NM Data (ex Neptune media).

En janvier dernier, ce dernier et trois autres filiales du Groupe : Adress Company, Data Company et Ebit Data, ont fusionné avec Avanci, afin de répondre aux exigences du marché en matière de collecte, gestion, analyse et exploitation des données dans les stratégies marketing, notamment grâce à l’intégration de l’IA.

Aujourd’hui, MV Group mobilise plus de 100 experts dédiés à l’IA et la data, consolidant ainsi son positionnement à la pointe de l’innovation, alors que l’adoption de ces technologies reste encore marginale dans le marketing.

IA VISTA incarne l’avenir du marketing digital de l’entreprise. Son objectif : offrir une plateforme technologique unique, capable d’optimiser les performances des campagnes de marketing digital à travers une exploitation intelligente des données. En combinant la 1st party Data des clients avec la 3rd party Data issue de Profilia, la mégabase de données BtoC d’Avanci, IA VISTA ouvre la voie à des ciblages ultra-précis et des contenus hyper-personnalisés.

Le projet IA VISTA est soutenu par une équipe pluridisciplinaire de plus de 10 experts issus des différentes filiales de MV Group. Cette équipe a été renforcée par l’arrivée de David Flouriot, Responsable Data et IA, ainsi que par de nouveaux talents spécialisés en IA et DevOps. Ensemble, ils travaillent au développement d’une plateforme capable de rendre les données facilement accessibles, enrichies et directement exploitables par les entreprises clientes.

Cette solution a pour ambition de répondre à des besoins multiples :

Outre les performances commerciales, IA VISTA s’inscrit également dans une démarche respectueuse de l’environnement. En optimisant l’utilisation des données et en réduisant les campagnes inutiles, cette technologie permet de diminuer l’empreinte énergétique des actions marketing, contribuant ainsi à un marketing digital plus responsable.

IA VISTA est ainsi une réponse aux enjeux actuels du marketing digital : une personnalisation accrue, une efficacité optimisée et un respect accru des normes environnementales et réglementaires, confirmant le rôle de pionnier de MV Group.

La troisième édition du Global AI Summit (GAIN), organisée par la Saudi Data & Artificial Intelligence Authority (SDAIA), s’est déroulée du 10 au 12 septembre derniers dans la capitale saoudienne, Riyad. Cet événement de grande envergure a non seulement mis en lumière les dernières avancées technologiques dans le domaine de l’IA, mais a également insisté sur l’importance cruciale d’une action concertée des gouvernements et des décideurs politiques à l’échelle mondiale. Le sommet a appelé à la mise en place d’un cadre éthique rigoureux et d’une gouvernance responsable pour s’assurer que l’IA se développe au service du bien commun et de l’humanité tout entière.

Depuis sa création en 2020, le Sommet mondial de l’IA a connu une croissance exponentielle, reflétant le rôle central que joue aujourd’hui l’Arabie saoudite dans le domaine de l’IA. Avec plus de 150 sessions, GAIN 2024 a été une plateforme de discussions stratégiques, d’innovations technologiques et de collaborations internationales. Le sommet a accueilli plusieurs annonces importantes, avec plus de 25 lancements de projets et la signature de plus de 80 accords et protocoles d’accord.

Le sommet a été retransmis en direct et visionné 3,7 millions de fois à travers le monde, illustrant l’intérêt croissant pour l’IA et son rôle potentiel dans l’avenir de l’humanité.

Parmi les temps forts du sommet figurent plusieurs partenariats stratégiques établis par la SDAIA, organisatrice de l’évènement.

L’Autorité a signé un protocole d’accord avec Microsoft Arabia visant à renforcer leur collaboration en cours, notamment avec la mise en place un centre d’excellence commun destiné à accélérer l’innovation dans le domaine de l’IA générative, en mettant l’accent sur des modèles linguistiques en langue arabe, avec IBM pour la création d’un Centre de recherche et d’innovation en IA en Arabie Saoudite, et avec NVIDIA pour étendre l’infrastructure d’IA dans tout le Royaume.

D’autres initiatives notables de la SDAIA ont été annoncées, parmi elles, le lancement de la Communauté mondiale de l’IA, ainsi que celui de la plateforme THAKAI, un centre de partage de données et de contenus sur l’IA, en partenariat avec des institutions académiques et des entreprises internationales.

En outre, des lignes directrices relatives à une utilisation responsable de la technologie deepfake ont été présentées, disponibles à la consultation publique.

Lors de la deuxième journée du Sommet, les participants ont largement débattu de la nécessité d’établir un code de gouvernance mondial pour l’IA, en résonance avec le thème du sommet : “Intelligence artificielle pour le bien de l’humanité”. Ils ont insisté sur l’importance cruciale d’une gouvernance efficace pour équilibrer les avantages et les risques associés à ces technologies.

Les discussions ont également mis en évidence le besoin urgent de développer une infrastructure robuste qui facilite l’accès aux réseaux de communication et aux services d’IA à l’échelle mondiale. Par ailleurs, les intervenants ont souligné la nécessité de promouvoir une compréhension sociétale approfondie de l’éthique de l’IA, appelant à des politiques claires qui favorisent la transparence, l’utilisation éthique et la durabilité dans les pratiques commerciales.

Le sommet s’est clôturé par un discours du directeur du Centre national d’information d’Arabie saoudite, Son Excellence le Dr Esam Alwagait, qui a remercié les participants :

“ Vos points de vue sincères nous ont non aidé à avoir une vision plus claire de ce qui nous attend, mais nous ont également ancrés dans les réalités auxquelles nous devons faire face. Ensemble, nous avons non seulement imaginé l’avenir de l’IA, mais nous l’avons aussi concrétisé en identifiant les catalyseurs nécessaires pour véritablement libérer son potentiel” .

Il a conclu :

“Il a été incroyablement inspirant de voir le monde se rassembler ici à Riyad, uni par l’élan de mettre l’IA au service de tous. L’engagement en faveur d’une action collaborative a été évident tout au long du sommet”.

Une équipe de chercheurs de l’UC Davis Health a développé une interface cerveau-ordinateur (BCI) qui permet à un homme atteint de sclérose latérale amyotrophique (SLA) de retrouver sa capacité à communiquer. Cette technologie innovante, qui traduit les signaux cérébraux en paroles avec une précision pouvant atteindre 97 %, pourrait redonner espoir aux millions de personnes atteintes de paralysie et de troubles de la parole dans le monde.

L’interface BCI a été implantée dans le cerveau de Casey Harrell, un homme de 45 ans souffrant de la maladie de Lou Gehrig (SLA), une maladie neurodégénérative qui affecte les cellules nerveuses responsables du contrôle des mouvements et des muscles de la parole. Grâce à ce dispositif, Casey Harrell peut désormais s’exprimer par l’intermédiaire d’un ordinateur qui convertit son activité cérébrale en texte parlé, avec une précision qui n’avait jamais été atteinte dans le domaine des neuroprothèses vocales.

L’étude rapportant ces travaux “An Accurate and Rapidly Calibrating Speech Neuroprosthesis” a été publiée le 14 août dernier dans le New England Journal of Medicine.

Le Dr David Brandman, neurochirurgien à l’UC Davis et co-auteur principal de l’étude avec Nicholas Card, a supervisé l’implantation de quatre réseaux de microélectrodes dans le gyrus précentral gauche de Casey Harrell une région du cerveau clé pour la coordination des mouvements de la parole. Ces électrodes captent l’activité neuronale lorsque Casey tente de parler, permettant ainsi au système de déchiffrer les phonèmes et les mots qu’il essaie de prononcer. Les mots sont affichés sur l’écran de l’ordinateur avant d’être traduits à voix haute par un modèle de synthèse vocale pré-entraîné affiné par les chercheurs.

David Brandman souligne :

“Cette technologie BCI a non seulement permis à Casey de communiquer avec ses proches, mais elle ouvre la voie à un nouveau monde d’interactions pour des patients incapables de parler. Nous avons franchi une étape décisive dans la compréhension et la décodification de l’activité cérébrale liée à la parole”.

Lors des premiers tests, le dispositif a montré une précision impressionnante de 99,6 % avec un vocabulaire limité à 50 mots, après seulement 30 minutes d’entraînement. En augmentant la taille du vocabulaire à 125 000 mots, le BCI a maintenu une précision de 97,5 %, marquant ainsi une avancée sans précédent.

Malgré les avancées récentes dans la technologie BCI, les tentatives de rétablir la communication ont été lentes et souvent imparfaites. En effet, les algorithmes de machine learning utilisés pour décoder les signaux cérébraux demandaient beaucoup de temps et de données pour fonctionner efficacement.

David Brandman explique :

“Les systèmes BCI de discours précédents comportaient de fréquentes erreurs de mots. Il était donc difficile pour l’utilisateur d’être compris de manière cohérente et constituait un obstacle à la communication. Notre objectif était de développer un système qui permette à quelqu’un d’être compris chaque fois qu’il veut parler.”

Ce qui rend cette technologie encore plus remarquable est la capacité du système à reproduire la voix de Casey telle qu’elle était avant l’apparition de la SLA, cinq ans plus tôt. L’équipe a utilisé des enregistrements audio de Casey datant d’avant la maladie pour entraîner l’IA à générer une voix proche de celle d’origine, restituant non seulement ses mots, mais aussi son identité vocale.

Sergey Stavisky, neuroscientifique à l’UC Davis et co-directeur du laboratoire de neuroprothèses, a souligné l’importance de cette avancée :

“Voir Casey exprimer des pensées et des émotions à travers sa propre voix a été incroyablement émouvant. Pour lui, comme pour nous, c’était un moment de joie pure”.

L’essai clinique, intitulé BrainGate 2, se poursuit avec d’autres participants, et les chercheurs espèrent que cette technologie pourra bientôt être généralisée pour améliorer la vie de milliers de patients atteints de paralysie sévère.

Casey Harrell, le premier patient à bénéficier de cette technologie, résume son expérience :

“Ne pas pouvoir parler, c’est être prisonnier de soi-même. Grâce à cette technologie, je retrouve une partie de ma liberté, et je peux à nouveau participer aux conversations”.

L’équipe de recherche continue de perfectionner le système pour augmenter encore plus la précision et la fluidité du dialogue, avec l’espoir que d’autres applications médicales suivront.

Cette percée est un immense pas en avant pour la science et la technologie, mais surtout pour les millions de personnes dans le monde qui rêvent de retrouver une voix. Avec cette technologie, ce rêve pourrait bientôt devenir une réalité.

Références de l’article :

Auteurs : Nicholas S. Card, Maitreyee Wairagkar, Carrina Iacobacci, Xianda Hou, Tyler Singer-Clark, Francis R. Willett, Erin M. Kunz, Chaofei Fan, Maryam Vahdati Nia, Darrel R. Deo, Aparna Srinivasan, Eun Young Choi, Matthew F. Glasser, Leigh R. Hochberg, Jaimie M. Henderson, Kiarash Shahlaie, Sergey D. Stavisky, David M. Brandman.

Selon les chiffres communiqués par OpenAI, le succès de ChatGPT ne se dément pas, loin de là. Aujourd’hui, le nombre d’utilisateurs hebdomadaires de la version gratuite a non seulement atteint la barre des 200 millions, soit deux fois plus qu’en novembre dernier, mais plus d’un million d’utilisateurs professionnels payants utilisent désormais ses solutions contre 600 000 en avril dernier.

Cette croissance impressionnante repose sur ses trois produits phares : ChatGPT Enterprise (lancé en août 2023), Team (janvier 2024) et Edu (mai 2024). Ces outils offrent aux entreprises et institutions des solutions sur mesure pour améliorer la productivité, la collaboration et l’innovation. Le modèle de “seats” payants permet aux entreprises d’ajuster le nombre de licences en fonction de leurs besoins, consolidant la flexibilité et l’accessibilité des produits d’OpenAI.

Bien que les États-Unis restent le marché principal d’OpenAI, plus de la moitié des seats payants sont désormais répartis à travers le monde. L’Allemagne, le Royaume-Uni et le Japon se hissent parmi les plus grands marchés internationaux, reflétant l’adoption croissante de l’IA en Europe et en Asie.

En Europe, OpenAI travaille avec des partenaires de renommée mondiale, notamment le Financial Times, pour permettre aux équipes de ce dernier de bénéficier des gains de créativité et de productivité apportés par ses outils. L’Université d’Oxford, en partenariat avec Microsoft, mène une transformation numérique majeure grâce aux technologies d’IA développées par OpenAI, tandis que des entreprises comme Sanofi les utilisent pour accélèrer le développement de nouveaux médicaments. BBVA et Zalando figurent également parmi les utilisateurs notables de ChatGPT, le premier cherchant à stimuler la productivité de ses employés et à continuer d’innover dans ses services bancaires, le second pour lancer un assistant de mode alimenté par l’IA sur ses plateformes web et son application.

Selon les équipes d’OpenAI, l’utilisation de son API a doublé depuis le lancement de GPT-4o mini, en juillet dernier. D’autres grandes entreprises européennes l’utilisent pour développer des produits innovants et interagir avec leurs clients : la plateforme Spotify pour son DJ IA personnalisé, Klarna pour améliorer les performances des employés et l’expérience client.

Une enquête récente menée auprès de 4 700 utilisateurs professionnels d’OpenAI montre que 92 % d’entre eux constatent une nette augmentation de leur productivité, tandis que 88 % déclarent gagner du temps dans leurs tâches quotidiennes. L’IA semble également être un moteur de créativité, avec 75 % des utilisateurs affirmant que les outils d’OpenAI ont stimulé l’innovation au sein de leurs organisations.

Les cas d’utilisation vont de la collecte d’informations à la rédaction et l’édition de contenu, en passant par la génération d’idées nouvelles. Leur adoption dans les secteurs de l’éducation, de la santé, des médias, et des services financiers reflète une tendance globale de transformation numérique facilitée par l’IA.

Brad Lightcap, directeur des opérations d’OpenAI, conclut :

“De la refonte de l’apprentissage des étudiants à l’optimisation des soins aux patients, en passant par la transformation de la manière dont les gouvernements servent leurs citoyens, l’IA redéfinit la manière dont les gens travaillent. Nous sommes fiers d’aider plus d’un million d’utilisateurs professionnels payants à travailler de manière plus productive, à rationaliser leurs opérations et à découvrir de nouvelles opportunités d’innovation”.

Deux mois et demi après sa création, Safe Superintelligence Inc (SSI), la start-up cofondée par Ilya Sutskever, Daniel Gross et Daniel Levy, a finalisé un tour de table d’1 milliard de dollars. Rapportée par Reuters, cette levée de fonds, menée par des investisseurs de premier plan tels qu’Andreessen Horowitz, Sequoia Capital, DST Global et SV Angel, reflète la confiance accordée à SSI. La start-up a pris le parti de ne pas commercialiser de produit avant d’avoir la certitude que ses systèmes d’IA ne présentent aucun risque pour l’humanité.

Les trois cofondateurs ont déclaré en juin dernier lors du lancement de SSI :

“La superintelligence est à portée de main. La construction d’une superintelligence sûre (SSI) est le problème technique le plus important de notre époque. Nous avons lancé le premier laboratoire SSI au monde, avec un seul objectif et un seul produit : une superintelligence sûre. Il s’appelle Safe Superintelligence Inc. SSI est notre mission, notre nom et l’ensemble de notre feuille de route produit, car c’est notre seul objectif. Notre équipe, nos investisseurs et notre modèle commercial sont tous alignés pour réaliser SSI”.

Ilya Sutskever avait démissionné le mois précédant le lancement de SSI de son poste de scientifique en chef chez OpenAI, dont il était l’un des cofondateurs, et où il codirigeait avec Jan Leike, l’équipe de superalignement mise en place par la start-up en juillet 2023 pour minimiser les risques potentiels d’une IA qui surpasserait l’intelligence humaine.