Vue normale

-

IA

-

Les ruses de la Chine pour contourner les sanctions américaines

Début mars, quatre ingénieurs chinois prenaient un vol depuis Beijing en direction de la Malaisie, chacun muni d’une valise. À l’intérieur, 15...

-

Intelligence artificielle

-

AI Act, RGPD, NIS 2 : Les trois chantiers de la présidence danoise de l'UE

Successeur de la Pologne, le Danemark a pris la tête du Conseil de l'Union européenne pour six mois, du 1er juillet au 31 décembre 2025. A...

AI Act, RGPD, NIS 2 : Les trois chantiers de la présidence danoise de l'UE

-

Intelligence artificielle

-

Disney et NBCUniversal attaquent Midjourney en justice pour violation du copyright

Midjourney est-il, comme le disent les studios américains Disney et NBCUniversal, "un distributeur numérique, qui génère, à l’infini, des...

Disney et NBCUniversal attaquent Midjourney en justice pour violation du copyright

-

Intelligence artificielle

-

Uber entend déployer des voitures autonomes avec Momenta en Europe dès 2026

Pour déployer des taxis autonomes sur sa plateforme, Uber n'entend pas se contenter du marché américain. Le numéro 1 du VTC a annoncé le 2 mai...

Uber entend déployer des voitures autonomes avec Momenta en Europe dès 2026

-

IA

-

Safran s’appuie sur l’IA pour accélérer la vérification de la conformité d’un projet aux normes cyber

Vérifier la conformité d’un projet aux exigences réglementaires en moins de 10 minutes. C’est la promesse de l’outil MindHead Conformité...

Safran s’appuie sur l’IA pour accélérer la vérification de la conformité d’un projet aux normes cyber

-

Intelligence artificielle

-

IA générative : Meta AI débarque en Europe mais reste privé de certaines fonctionnalités

Il ne sera plus nécessaire aux utilisateurs européens de Facebook, Messenger, WhatsApp ou Instagram de solliciter Google Search ou ChatGPT,...

IA générative : Meta AI débarque en Europe mais reste privé de certaines fonctionnalités

-

Intelligence artificielle

-

IA générative : Les syndicats français vent debout contre l'utilisation d'œuvres protégées par Meta

Meta se fait rattraper par le droit. Et plus particulièrement par le droit d'auteur. Le géant des réseaux sociaux est en effet accusé par trois...

IA générative : Les syndicats français vent debout contre l'utilisation d'œuvres protégées par Meta

-

Les Temps Électriques

-

Revue des principaux instruments juridiques et documents internationaux, régionaux et nationaux applicables à l’intelligence artificielle

La revue des instruments et documents réalisée ci-après ne concerne que les principaux textes internationaux, régionaux et nationaux directement attachés à l’IA. Les autres textes, applicables à l’IA mais non directement concernés (comme le RGPD) ou applicables à l’IA mais avec une portée moindre, ont été exclus de cette revue. Par instances Instances Document Année… Plus...

Revue des principaux instruments juridiques et documents internationaux, régionaux et nationaux applicables à l’intelligence artificielle

-

Intelligence artificielle

-

MWC 2025 : "Les opérateurs télécoms ont une réelle opportunité de devenir des hyperscalers", Arthur Mensch (Mistral)

Cette dernière édition du Mobile World Congress a su attirer des personnalités du monde de l'intelligence artificielle. A commencer par Arthur...

MWC 2025 : "Les opérateurs télécoms ont une réelle opportunité de devenir des hyperscalers", Arthur Mensch (Mistral)

-

Intelligence artificielle

-

Scoring financier : La communication de l'algorithme ne suffit pas à respecter le droit d'accès

Dans une décision rendue le 27 février 2025, la Cour de justice de l'Union européenne (CJUE) a tranché un litige portant sur le droit d'accès à...

Scoring financier : La communication de l'algorithme ne suffit pas à respecter le droit d'accès

-

Intelligence artificielle

-

La Cnil canadienne enquête sur X pour l'entraînement de ses modèles d'IA générative

Le Commissariat canadien à la protection de la vie privée a annoncé, le 26 février, l’ouverture d’une enquête sur l’utilisation par X, la...

La Cnil canadienne enquête sur X pour l'entraînement de ses modèles d'IA générative

-

Intelligence artificielle

-

Nvidia poursuit les régulateurs européens suite à l'enquête sur le rachat de Run:ai

Bien qu’il ait obtenu en décembre dernier, l’aval de la Commission européenne pour acquérir la start-up israélienne Run:ai, Nividia ne se remet...

Nvidia poursuit les régulateurs européens suite à l'enquête sur le rachat de Run:ai

-

Intelligence artificielle

-

Droit d'auteur et IA générative : Thomson Reuters gagne un procès contre Ross Intelligence

Voilà une affaire qui pourrait servir de précédent pour les années à venir. Thomson Reuters a remporté un procès contre Ross Intelligence pour...

Droit d'auteur et IA générative : Thomson Reuters gagne un procès contre Ross Intelligence

-

Intelligence artificielle

-

IA, vie privée, brevets : Bruxelles se déleste de réglementations importantes

L’exécutif européen fait le ménage dans son arsenal législatif. Au cours de la présentation de son programme de travail 2025, le 12 février, il...

IA, vie privée, brevets : Bruxelles se déleste de réglementations importantes

-

Intelligence artificielle

-

Adobe développe une IA pour lire les contrats

Plus la peine de se triturer les méninges pour déchiffrer de longs contrats, avec des clauses juridiques parfois incompréhensibles. Adobe vient...

Adobe développe une IA pour lire les contrats

-

IA

-

L’AI Act européen entre en application mais les discussions sont toujours en cours sur sa mise en œuvre

«La date du 2 février marque le début d’une nouvelle ère pour le déploiement des technologies d’intelligence artificielle». Kirsten Rulf,...

L’AI Act européen entre en application mais les discussions sont toujours en cours sur sa mise en œuvre

-

Intelligence artificielle

-

Quelles vérifications effectuer avant de réutiliser des données librement accessibles ? La Cnil répond

Dans un document publié le 23 janvier 2025, la Commission nationale de l'informatique et des libertés (Cnil) a rappelé les étapes à respecter...

Quelles vérifications effectuer avant de réutiliser des données librement accessibles ? La Cnil répond

-

ActuIA

-

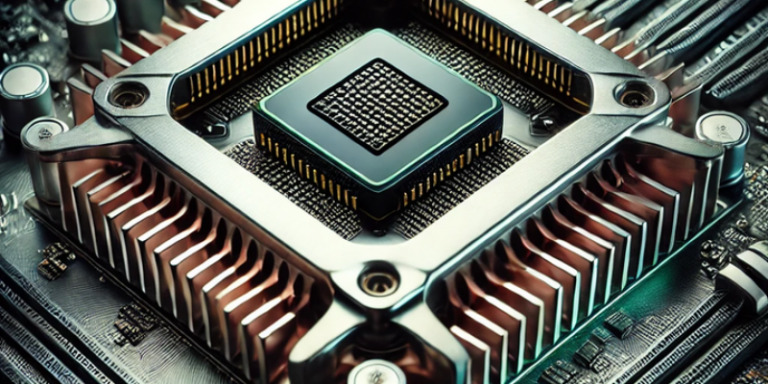

Nouvelles restrictions américaines sur les puces d’IA : la réaction de NVIDIA

Alors que l’administration Biden a dévoilé début décembre de nouvelles restrictions visant à limiter l’accès de la Chine à certaines technologies de pointe, notamment les puces d’IA, elle a présenté hier, une semaine avant de céder la place à Donald Trump, un projet de réglementation visant à bloquer les exportations de ces puces vers la Chine, la Russie, l’Iran et la Corée du Nord. Leur accès à ses principaux alliés, dont la France, sera également soumise à certaines conditions, soulevant le to

Nouvelles restrictions américaines sur les puces d’IA : la réaction de NVIDIA

Alors que l’administration Biden a dévoilé début décembre de nouvelles restrictions visant à limiter l’accès de la Chine à certaines technologies de pointe, notamment les puces d’IA, elle a présenté hier, une semaine avant de céder la place à Donald Trump, un projet de réglementation visant à bloquer les exportations de ces puces vers la Chine, la Russie, l’Iran et la Corée du Nord. Leur accès à ses principaux alliés, dont la France, sera également soumise à certaines conditions, soulevant le tollé chez les acteurs de l’IA, notamment chez NVIDIA.

Sous couvert de sécurité nationale, les Etats-Unis, pour préserver leur position prédominante dans la course à l’IA, ont mis en place des restrictions vers l’exportation des GPU et des puces d’accélération d’IA vers la Chine, son principal concurrent, et la Russie dès 2022, introduisant des exigences plus strictes pour l’octroi de licences pour les exportations vers la Chine et d’autres pays en 2023.

Ils pourraient franchir un nouveau pas avec cette nouvelle réglementation, que critique Ned Finkle, vice-président des affaires gouvernementales chez NVIDIA. Il affirme dans un billet de blog où il rappelle l’apport de l’IA pour les soins de santé, l’agriculture, la fabrication, l’éducation, entre autres :

“L’administration Biden cherche maintenant à restreindre l’accès aux applications informatiques grand public avec sa règle sans précédent et erronée de « diffusion de l’IA », qui menace de faire dérailler l’innovation et la croissance économique dans le monde entier”.

Que stipule la réglementation provisoire ?

La réglementation provisoire, présentée par la Maison-Blanche, introduit une série de mesures destinées à encadrer strictement la diffusion des technologies d’IA avancées, tout en préservant les intérêts économiques et stratégiques des États-Unis.

Blocage des exportations vers les pays de préoccupation

Les exportations de puces avancées seront strictement interdites vers la Chine, la Russie, l’Iran et la Corée du Nord. Ces pays, considérés comme des adversaires stratégiques, sont ciblés pour empêcher l’utilisation de ces technologies à des fins militaires, cybernétiques ou de surveillance de masse.

Aucune restriction pour les alliés

Les 18 principaux alliés des États-Unis, parmi lesquels la France, l’Allemagne, la Belgique, le Danemark, l’Irlande, l’Italie, l’Espagne, le Royaume-Uni, la Suède, le Japon, la Corée du Sud et Taïwan, pourront continuer à importer ces technologies, mais sous réserve de répondre à des critères de sécurité stricts et d’obtenir des licences pour les commandes de grande envergure.

Deux statuts ont été créés pour encadrer les exportations vers les utilisateurs finaux :

- Universal Verified End User (UVEU) : Ce statut permettra aux entreprises situées dans des pays alliés et respectant des normes de sécurité élevées de bénéficier de livraisons flexibles pour leurs besoins en IA. Elles ne pourront toutefois déployer que 7% de leur capacité de calcul dans chaque pays tiers ;

- National Verified End User (NVEU) : Accordé aux entreprises des pays considérés comme non-préoccupants qui pourront acheter jusqu’à 320 000 GPU avancés sur deux ans, tout en respectant les exigences de sécurité.

Les entités non-VEU pourront quant à elles acheter jusqu’à 50 000 GPU avancés par pays, un nombre qui pourra être doublé en cas d’accord signé avec les États-Unis.

Exemptions pour les petites commandes de puces

Les commandes de puces dont la capacité de calcul collective ne dépasse pas 1 700 GPU avancé ne nécessiteront pas de licence et ne seront pas comptabilisées pas dans les plafonds nationaux. Ces exemptions concernent principalement des institutions universitaires, médicales et de recherche qui utilisent ces technologies à des fins non-sensibles et pourront ainsi les recevoir rapidement.

Encadrement des modèles d’IA avancés

Les poids de modèles fermés ne pourront être transférés qu’à des acteurs vérifiés, tandis que des normes de sécurité accrue sont imposées pour leur stockage.

Cette réglementation pourrait entrer en vigueur d’ici 120 jours, reste à savoir ce qu’en fera le gouvernement Trump, soutenu par les acteurs de la Silicon Valley.

Pour Ned Finkle :

“Elle sape déjà les intérêts des États-Unis. Comme l’a démontré la première administration Trump, l’Amérique gagne grâce à l’innovation, à la concurrence et au partage de nos technologies avec le monde – et non en se retirant derrière un mur d’excès de pouvoir gouvernemental. Nous attendons avec impatience un retour à des politiques qui renforcent le leadership américain, stimulent notre économie et préservent notre avantage concurrentiel dans le domaine de l’IA et au-delà”.

-

Intelligence artificielle

-

Trois questions sur la vérification de l'âge en ligne sur les sites pornographiques

"C'est une date historique pour la protection en ligne des mineurs". Voici comment Clara Chappaz, la ministre déléguée chargée de...

Trois questions sur la vérification de l'âge en ligne sur les sites pornographiques

-

Intelligence artificielle

-

L'administration Biden publie une directive sur les commandes de GPU qui fait enrager Nvidia

Nvidia n'en peut plus et tire la sonnette d'alarme. Trop c'est trop. "Pendant des décennies, le leadership dans les écosystèmes informatiques...

L'administration Biden publie une directive sur les commandes de GPU qui fait enrager Nvidia

-

Intelligence artificielle

-

RGPD : L'intérêt légitime, une base légale pour le traitement des données dans les modèles d'IA

Le Comité européen de la protection des données (European Data Protection Board, EDPB) a adopté le 17 décembre sa position très attendue sur le...

RGPD : L'intérêt légitime, une base légale pour le traitement des données dans les modèles d'IA

-

Intelligence artificielle

-

Le gouvernement britannique lance une consultation sur le droit d'auteur appliqué à l'IA

Le Royaume-Uni est prêt à s'attaquer au dossier brûlant de l'IA. Conscient de la nécessité de clarifier le droit d'auteur appliqué aux...

Le gouvernement britannique lance une consultation sur le droit d'auteur appliqué à l'IA

-

Intelligence artificielle

-

Nvidia aurait violé les lois antitrust de la Chine, le régulateur national enquête

Coup de massue pour le roi des GPU. La Chine a déclaré ce lundi avoir lancé une enquête sur Nvidia concernant des violations présumées de la...

Nvidia aurait violé les lois antitrust de la Chine, le régulateur national enquête

-

Intelligence artificielle

-

Elon Musk remet une pièce dans la machine judiciaire contre OpenAI

C'est un bras de fer qui risque de s'éterniser. Elon Musk a déposé une motion préliminaire ce 29 novembre devant le tribunal de district...

Elon Musk remet une pièce dans la machine judiciaire contre OpenAI

-

ActuIA

-

La Fondation Eclipse et l’OSI s’associent pour façonner l’avenir de l’IA open source

La Fondation Eclipse, l’une des plus grandes fondations open source au monde, et l’Open Source Initiative (OSI), ont signé la semaine dernière un protocole d’accord (MoU) pour promouvoir l’intérêt de la communauté open source dans la mise en œuvre d’initiatives réglementaires sur l’intelligence artificielle open source (OSAI). L’OSI, une organisation californienne à but non-lucratif créée en 1998, qui défend et éduque sur les avantages de l’open source, a récemment publié la première définition

La Fondation Eclipse et l’OSI s’associent pour façonner l’avenir de l’IA open source

La Fondation Eclipse, l’une des plus grandes fondations open source au monde, et l’Open Source Initiative (OSI), ont signé la semaine dernière un protocole d’accord (MoU) pour promouvoir l’intérêt de la communauté open source dans la mise en œuvre d’initiatives réglementaires sur l’intelligence artificielle open source (OSAI).

L’OSI, une organisation californienne à but non-lucratif créée en 1998, qui défend et éduque sur les avantages de l’open source, a récemment publié la première définition officielle de l’IA open source, l’OSAID. L’Eclipse Foundation a été l’une des premières à soutenir cette version.

Alors que les réglementations sur l’IA se multiplient, leur partenariat vise à ce qu’elles s’alignent sur cette définition et les valeurs de l’open source. La Fondation Eclipse et l’OSI s’efforceront d’apporter de la clarté dans le langage et les termes sur lesquels l’industrie, la communauté, la société civile et les décideurs peuvent se baser pour élaborer et appliquer les politiques publiques. Elles tireront parti de leurs plateformes et événements publics respectifs pour sensibiliser le public sur le sujet.

Stefano Maffulli, directeur exécutif de l’OSI, explique :

“L’IA est sans doute la technologie la plus transformatrice de notre génération. Le défi est maintenant d’élaborer des politiques qui non seulement favorisent la croissance de l’IA, mais garantissent que l’IA Open Source prospère dans ce paysage en évolution. Le partenariat avec la Fondation Eclipse et son expertise, combinée à son expérience en matière de développement open source en Europe et de conformité réglementaire, est important pour façonner l’avenir de l’IA Open Source”.

Objectifs et actions

Le mémorandum d’accord définit plusieurs domaines de coopération, notamment :

- Échange d’Information : L’OSI et la Fondation Eclipse partageront des informations et des points de vue pertinents sur l’élaboration des politiques publiques et les activités réglementaires en matière d’intelligence artificielle ;

- Représentation aux décideurs : OSI et la Fondation Eclipse coopéreront pour représenter les principes et les valeurs des licences open source auprès des décideurs politiques et des organisations de la société civile ;

- Promotion des principes Open Source : Des efforts conjoints seront déployés pour sensibiliser le public au rôle de l’open source dans l’IA, en soulignant comment elle peut favoriser l’innovation tout en atténuant les risques.

Un partenariat pour l’avenir

Pour l’OSI et la Fondation Eclipse, l’évolution rapide des technologies de l’IA, ainsi que les nouveaux paysages réglementaires complexes à venir, exigent des orientations claires, cohérentes, alignées et enracinées dans les principes de l’open source. Les deux organisations s’engagent à fournir à la communauté open source, aux leaders de l’industrie et aux décideurs les outils et les connaissances dont ils ont besoin pour naviguer dans ce domaine en évolution rapide.

Ce protocole d’accord marque le début d’une collaboration à long terme, de nouvelles initiatives et activités conjointes seront prochainement annoncées.

-

Intelligence artificielle

-

AI Act : La Commission lance une consultation sur les systèmes et les pratiques d'IA interdits

Le Bureau européen de l'IA, créé en février 2024 au sein de la Commission, vient de lancer un processus de consultation ciblée des parties...

AI Act : La Commission lance une consultation sur les systèmes et les pratiques d'IA interdits

-

Intelligence artificielle

-

La Cnil néerlandaise condamne l'utilisation d'une IA pour détecter la fraude aux bourses étudiantes

De 2012 à 2023, l'Agence exécutive pour l'éducation (Dienst Uitvoering Onderwijs, DUO) – un organisme public qui assure le financement, gère...

La Cnil néerlandaise condamne l'utilisation d'une IA pour détecter la fraude aux bourses étudiantes

-

Intelligence artificielle

-

Amazon envisage de renflouer les caisses d'Anthropic de plusieurs milliards

4 milliards de dollars. C'est le montant qu'Amazon a investi dans la start-up Anthropic. Dans un premier temps, le géant américain prévoyait un...

Amazon envisage de renflouer les caisses d'Anthropic de plusieurs milliards

-

Intelligence artificielle

-

Intégration de l'IA dans les services publics : le CESE appelle à plus de transparence

"Favoriser les opportunités et gérer les risques liés aux nouvelles technologies pour les services publics, l'organisation du travail et des...

Intégration de l'IA dans les services publics : le CESE appelle à plus de transparence

-

Intelligence artificielle

-

Le gouvernement britannique prêt à s'attaquer au dossier brûlant de la régulation de l'IA

Si le Royaume-Uni a quitté l'Union européenne avec fracas, il n'en reste pas moins qu'il regarde avec attention ce qui se trame sur le vieux...

Le gouvernement britannique prêt à s'attaquer au dossier brûlant de la régulation de l'IA

-

Intelligence artificielle

-

Meta signe un accord de licence avec Reuters pour alimenter son chatbot

OpenAI n'est pas le seul à multiplier les accords dans le secteur des médias pour alimenter ses modèles d'intelligence artificielle en contenus...

Meta signe un accord de licence avec Reuters pour alimenter son chatbot

-

Intelligence artificielle

-

Apple Intelligence posera définitivement ses valises dans l'UE en avril 2025

Début juin, Apple donnait rendez-vous au monde entier pour sa conférence annuelle. Au-delà des annonces habituelles concernant ses produits...

Apple Intelligence posera définitivement ses valises dans l'UE en avril 2025

-

Intelligence artificielle

-

Les artistes se mobilisent contre l'utilisation de leurs œuvres pour l'entraînement de modèles d'IA

Ils sont désormais 13 500 artistes à avoir signé la pétition. Musiciens, compositeurs, écrivains, chefs d'orchestre, actrices, romanciers,...

Les artistes se mobilisent contre l'utilisation de leurs œuvres pour l'entraînement de modèles d'IA

-

Intelligence artificielle

-

Partage de données par l'OTAN, concurrence dans le cloud... Les 5 actus clés sur la protection des données

Frais de migration, interopérabilité des services... L'Arcep veut rétablir la concurrence dans le cloud. Dans le cadre de ses nouvelles...

Partage de données par l'OTAN, concurrence dans le cloud... Les 5 actus clés sur la protection des données

-

Intelligence artificielle

-

Meta déploie son assistant IA aux quatre coins du globe... mais pas dans l'Union européenne

Si la maison-mère de Facebook et Instagram boude l'Union européenne, les autres régions du monde peuvent se targuer de bénéficier des dernières...

Meta déploie son assistant IA aux quatre coins du globe... mais pas dans l'Union européenne

-

Intelligence artificielle

-

En Allemagne, Microsoft placé sous la surveillance renforcée de l'autorité de la concurrence

Relativement épargné par le Digital Markets Act européen, Microsoft n'échappera pas à une supervision renforcée en Allemagne. Lundi 30...

En Allemagne, Microsoft placé sous la surveillance renforcée de l'autorité de la concurrence

-

Intelligence artificielle

-

L'autorité britannique de la concurrence abandonne son enquête sur Amazon et Anthropic

En avril dernier, l'Autorité britannique de la concurrence et des marchés (CMA) faisait part de ses préoccupations croissantes concernant le...

L'autorité britannique de la concurrence abandonne son enquête sur Amazon et Anthropic

-

Intelligence artificielle

-

RGPD : Docaposte, Doctrine, la Française des Jeux et ShareID bénéficient du soutien renforcé de la Cnil

La Commission nationale de l'informatique et des libertés (Cnil) annonce ce 23 septembre que quatre entreprises ont été sélectionnées par ses...

RGPD : Docaposte, Doctrine, la Française des Jeux et ShareID bénéficient du soutien renforcé de la Cnil

-

ActuIA

-

Lettre ouverte : “L’Europe a besoin de certitude réglementaire en matière d’IA”

Ce 19 septembre, une trentaine d’entreprises, des chercheurs et des institutions européens ont publié une lettre ouverte adressée aux régulateurs de l’UE avec un message clair : l’Europe doit harmoniser ses approches réglementaires en matière d’IA si elle veut libérer pleinement le potentiel de l’IA générative, notamment open source. Parmi les signataires figurent Mark Zuckerberg (Meta), Daniel Ek (Spotify), Yann LeCun (Meta), Christian Klein (SAP), Maurice Lévy (Publicis Groupe), Börje Ekholm (

Lettre ouverte : “L’Europe a besoin de certitude réglementaire en matière d’IA”

Ce 19 septembre, une trentaine d’entreprises, des chercheurs et des institutions européens ont publié une lettre ouverte adressée aux régulateurs de l’UE avec un message clair : l’Europe doit harmoniser ses approches réglementaires en matière d’IA si elle veut libérer pleinement le potentiel de l’IA générative, notamment open source. Parmi les signataires figurent Mark Zuckerberg (Meta), Daniel Ek (Spotify), Yann LeCun (Meta), Christian Klein (SAP), Maurice Lévy (Publicis Groupe), Börje Ekholm (Ericsson) qui soulignent l’urgence d’une prise de décision rapide et cohérente pour garantir que l’Europe reste compétitive.

Selon la lettre ouverte, “l’Europe est devenue moins compétitive et moins innovante par rapport à d’autres régions, et elle risque maintenant de prendre encore plus de retard à l’ère de l’IA en raison de décisions réglementaires incohérentes”.

L’environnement réglementaire européen, qui a pour but de protéger les consommateurs et de garantir une concurrence équitable, a été source de tensions entre des géants technologiques comme Meta ou OpenAI et les régulateurs européens.

La loi sur les Marchés Numériques (DMA), cherche à limiter le pouvoir des grandes plateformes en ligne, en imposant des règles pour empêcher les comportements anticoncurrentiels alors que la loi sur les Services Numériques (DSA) vise à créer un espace numérique plus sûr, exigeant des plateformes en ligne une modération rigoureuse des contenus. De son côté, le règlement Général sur la Protection des Données (RGPD) impose des règles strictes sur la collecte, le traitement et le stockage des données personnelles des citoyens européens.

L’AI Act, entré en vigueur le 1er août dernier, sera quant à lui appliqué progressivement. Il établit un cadre pour l’utilisation de l’IA, notamment pour les applications à haut risque, imposant des exigences strictes en matière de transparence et de sécurité, mais selon certains, manque de clarté et d’exemption à part entière pour les modèles de fondation open source.

L’Europe à un tournant décisif

L’un des points cruciaux soulevés dans la lettre est l’absence d’une réglementation unifiée en Europe sur l’utilisation des données pour l’IA, empêchant les entreprises de développer des solutions innovantes à l’échelle locale. Les interventions récentes des autorités européennes de protection des données ont semé le trouble quant aux types de données qui peuvent être utilisés pour entraîner des modèles d’IA, ce qui freine considérablement les efforts de recherche et développement.

Les signataires avertissent que sans règles harmonisées et cohérentes, l’Europe se privera des dernières avancées technologiques dont bénéficient les États-Unis, la Chine et l’Inde, comme celles des LLMs multimodaux qui pourraient radicalement transformer des secteurs comme la santé, la science ou encore la culture, tout en contribuant à une augmentation significative du PIB mondial estimée à 10 % au cours de la prochaine décennie. Elle va également se priver d’un second élément essentiel à l’innovation en IA : “le développement de modèles “ouverts”, disponibles gratuitement pour que tout le monde puisse les utiliser, les modifier et les améliorer, multipliant ainsi les bénéfices et diffusant des opportunités sociales et économiques”.

Pour Laurent Solly, vice-président de Meta Europe du Sud :

“Les entreprises qui travaillent sur l’IA générative ont besoin de décisions harmonisées, cohérentes, rapides et claires dans le cadre de la réglementation européenne sur les données. C’est l’avenir et la place de l’Europe qui se jouent ici”.

Ce que la lettre ouverte souligne :

“L’Europe fait face à un choix qui aura un impact sur la région pendant des décennies. Elle peut choisir de réaffirmer le principe d’harmonisation inscrit dans des cadres réglementaires comme le RGPD afin que l’innovation en matière d’IA se produise ici à la même échelle et à la même vitesse qu’ailleurs. Ou bien, elle peut continuer à rejeter le progrès, trahir les ambitions du marché unique et regarder le reste du monde développer des technologies auxquelles les Européens n’auront pas accès”.

Vous pouvez retrouver la lettre ouverte et rejoindre les signataires ici.

-

Intelligence artificielle

-

IA générative : Meta va entraîner ses algorithmes sur les publications des utilisateurs britanniques

Meta passe finalement à l'action. L'entreprise a annoncé dans un billet de blog publié le 13 septembre "qu'au cours des prochains mois" elle...

IA générative : Meta va entraîner ses algorithmes sur les publications des utilisateurs britanniques

-

Intelligence artificielle

-

L'État de Californie prêt à employer la manière forte pour réglementer le secteur de l'IA

Mise à jour du 29 août 2024 : Les législateurs californiens ont adopté ce mercredi le projet de loi controversé visant à réglementer le...

L'État de Californie prêt à employer la manière forte pour réglementer le secteur de l'IA

-

Intelligence artificielle

-

Les sociétés chinoises contournent les sanctions sur l'IA en utilisant des fournisseurs cloud américains

Fin juillet, les États-Unis annonçaient vouloir serrer davantage la vis quant aux exportations d'équipements de fabrication de semi-conducteurs...

Les sociétés chinoises contournent les sanctions sur l'IA en utilisant des fournisseurs cloud américains

-

ActuIA

-

La Californie prend les devants sur la régulation de l’IA : controverses autour de la loi SB 1047

Alors que le Congrès américain peine à établir une réglementation encadrant les systèmes d’IA, l’état de Californie a décidé de se doter de sa propre réglementation au grand dam des principales entreprises du secteur de l’Etat, OpenAI en tête. La loi SB 1047 en Californie est une proposition législative visant à encadrer les modèles d’IA générative. Elle a été introduite par le sénateur démocrate Scott Wiener dans le but de prévenir les dommages potentiels que des systèmes d’IA puissants pourrai

La Californie prend les devants sur la régulation de l’IA : controverses autour de la loi SB 1047

Alors que le Congrès américain peine à établir une réglementation encadrant les systèmes d’IA, l’état de Californie a décidé de se doter de sa propre réglementation au grand dam des principales entreprises du secteur de l’Etat, OpenAI en tête.

La loi SB 1047 en Californie est une proposition législative visant à encadrer les modèles d’IA générative. Elle a été introduite par le sénateur démocrate Scott Wiener dans le but de prévenir les dommages potentiels que des systèmes d’IA puissants pourraient causer, comme des cyberattaques ou des incidents qui pourraient entraîner des pertes massives de vies humaines. Ses détracteurs, comme ceux de l’AI Act, estiment qu’elle pourrait freiner l’innovation et faire fuir les investisseurs.

Le 2 août dernier, la société de capital-risque Andreessen Horowitz (“a16z”), basée à la Silicon Valley écrivait au sénateur Wiener :

“Bien que nous soyons convaincus que vos intentions sont de protéger la sécurité des Californiens – un objectif louable, bien sûr – le projet de loi tel qu’il est actuellement rédigé n’atteindra pas ses objectifs. Il entravera l’innovation et l’investissement dans cette technologie émergente importante, affaiblira la position des États-Unis en tant que leader mondial de la technologie et créera des obstacles inutiles et arbitraires pour une industrie compétitive qui stimule la création d’emplois en Californie à une échelle record. C’est pourquoi votre législation a généré des réactions ouvertes et des préoccupations généralisées de la part de presque tous les principaux développeurs et investisseurs de l’écosystème de l’IA”.

Face à cette opposition, les législateurs californiens ont apporté des modifications au projet de loi. Le 15 août dernier, celui-ci a été adopté par la California Appropriations Committee, une commission législative de l’Assemblée de l’État de Californie, dernière étape avant qu’il ne soit soumis à un vote final.

Le sénateur Wiener a précisé à TechCrunch :

“Nous avons accepté un certain nombre d’amendements très raisonnables proposés, et je pense que nous avons répondu aux principales préoccupations exprimées par Anthropic et beaucoup d’autres dans l’industrie. Ces amendements s’appuient sur des modifications importantes apportées précédemment au SB 1047 pour répondre aux besoins uniques de la communauté open source, qui est une source importante d’innovation”.

La version amendée du projet de loi a en effet atténué certaines exigences initiales, comme la création d’une nouvelle agence de régulation, qui a été retirée, mais elle propose néanmoins la mise en place d’un conseil consultatif chargé de développer des normes pour les systèmes d’IA les plus avancés. En outre, la législation maintient les obligations pour les développeurs de LLMs de tester la sécurité de leurs systèmes et de simuler des cyberattaques. En cas de non-respect, des amendes sont prévues, mais sans sanctions pénales.

Opposition et soutien au projet de loi

Malgré ces compromis, le projet de loi rencontre une ferme opposition de la part d’acteurs clés du secteur technologique, comme OpenAI, Google, et Meta. OpenAI, par exemple, a exprimé des préoccupations concernant le risque de voir les innovateurs quitter la Californie pour des environnements moins régulés. Des chercheurs reconnus comme Yann LeCun ou Fei-Fei Li, de l’université de Stanford, ont critiqué le projet de loi. Pour Yann LeCun, l’un des parrains de l’IA, il vise à répondre à une “illusion de ‘risque existentiel’ poussée par une poignée de groupes de réflexion délirants”, pour Fei-Fei Li, il nuira à l’écosystème d’IA naissant.

Certaines figures influentes, comme Nancy Pelosi, membre du parti démocrate, bien qu’elles soutiennent l’idée de protéger les consommateurs et de réguler l’IA, estiment que le projet de loi actuel est mal conçu et pourrait nuire à la position de leader de la Californie dans le domaine de l’IA.

Les défenseurs du projet, comme Scott Wiener et des experts comme les deux autres parrains de l’IA, Geoffrey Hinton et Joshua Bengio, estiment quant à eux que la régulation est nécessaire pour anticiper les dangers potentiels des systèmes d’IA tout en soutenant l’innovation responsable.

Le projet de loi SB 1047 doit encore passer par un vote à l’Assemblée californienne avant la fin du mois. Si elle est adoptée, ce sera au gouverneur Gavin Newsom de décider de sa promulgation. La décision du gouverneur est encore incertaine, car il n’a pas pris publiquement position sur ce texte.

Ce projet de loi est suivi de près, car il pourrait poser un précédent pour la régulation de l’IA aux États-Unis et influencer la manière dont d’autres États, voire le gouvernement fédéral, abordent cette question.

-

Intelligence artificielle

-

X va arrêter d’utiliser les données des citoyens européens pour entraîner son modèle Grok

La Data Protection Commission (DPC), équivalent de la Cnil en Irlande, a annoncé le 8 août que X (ex-Twitter) avait cessé la collecte de...

X va arrêter d’utiliser les données des citoyens européens pour entraîner son modèle Grok

-

Intelligence artificielle

-

Le ministère américain du Commerce publie un outil de mesure des risques inhérents aux LLM

Le ministère américain du Commerce a annoncé il y a quelques jours la publication d'orientations et de logiciels destinés à améliorer la...

Le ministère américain du Commerce publie un outil de mesure des risques inhérents aux LLM

-

Intelligence artificielle

-

Données personnelles : La FTC enquête sur les pratiques commerciales de “tarification ciblée”

La Federal Trade Commission (FTC), agence américaine chargée du droit de la consommation et de la concurrence, a ordonné le 23 juillet à huit...

Données personnelles : La FTC enquête sur les pratiques commerciales de “tarification ciblée”

-

Intelligence artificielle

-

Le régulateur britannique de la concurrence enquête sur l’accord entre Microsoft et Inflection AI

La Competition and Markets Authority (CMA - Autorité britannique de la concurrence et des marchés) vient de notifier dans un document qu'elle...

Le régulateur britannique de la concurrence enquête sur l’accord entre Microsoft et Inflection AI

-

Intelligence artificielle

-

Microsoft renonce à son siège d'observateur au board d'OpenAI

La firme de Redmond desserre les liens qui l'unissent à OpenAI. Après avoir obtenu en novembre dernier un poste d'observateur sans droit de...

Microsoft renonce à son siège d'observateur au board d'OpenAI

-

Intelligence artificielle

-

Nvidia en passe d'être inculpé par le régulateur antitrust français ?

Coup de chaud pour Nvidia. Selon Reuters, le régulateur antitrust français, à savoir l'Autorité de la concurrence, pourrait poursuivre la firme...

Nvidia en passe d'être inculpé par le régulateur antitrust français ?

-

Intelligence artificielle

-

Selon Mustafa Suleyman, tout le contenu du web est libre d'utilisation

Au Festival "Ideas" d'Aspen, Mustafa Suleyman, CEO de Microsoft AI, s'est entretenu avec le journaliste et auteur américain Andrew Ross Sorkin...