Développement et adoption de l’IA : l’AIE appelle à une coordination renforcée des besoins énergétiques

Hier, alors que le Sommet pour l’Action sur l’IA réunissait des dirigeants du monde entier, le Dr Fatih Birol, directeur exécutif de l’Agence internationale de l’énergie (AIE), est intervenu pour rappeler l’interdépendance croissante entre l’IA et le secteur de l’énergie. Selon lui, le développement rapide de l’IA nécessite une infrastructure énergétique robuste, en particulier en matière d’électricité, pour soutenir l’expansion prévue des centres de données, mais également une collaboration étroite entre l’industrie énergétique, le secteur technologique et les gouvernements.

En décembre dernier, l’AIE a organisé à son siège de Paris une conférence mondiale sur l’énergie et l’IA qui a contribué à jeter les bases des résultats énergétiques du Sommet de cette semaine à Paris.

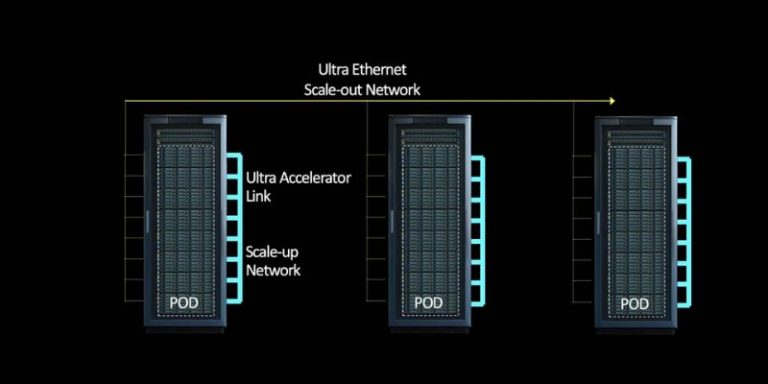

L’essor de l’IA et, en particulier celui de la GenAI, nécessite d’énormes datacenters, chacun consommant une quantité d’électricité équivalente à celle de 100 000 ménages. Selon l’agence, bien que les centres de données ne représentent actuellement que 1 % de la consommation mondiale d’électricité, le réseau est déjà confronté à des défis importants dans les zones où ils sont concentrés, et la demande devrait continuer à augmenter. Ainsi, en Irlande, les datacenters représentent déjà 20 % de la demande d’électricité, tandis que dans l’État américain de Virginie, cette part est supérieure à 25 %.

Lors de son allocution, le Dr Fatih Birol a souligné les nombreuses opportunités offertes par l’IA, mais également le risque que les progrès de l’IA ne soient entravés si l’infrastructure énergétique nécessaire n’est pas planifiée de manière adéquate :

“Il n’y a pas d’IA sans énergie, en particulier sans électricité. Des milliers de centres de données devraient être construits au cours des cinq prochaines années. Mais notre analyse à l’AIE montre que si l’industrie de l’énergie, le secteur technologique et les gouvernements ne collaborent pas pour fournir l’infrastructure électrique nécessaire, de nombreux projets pourraient être retardés, voire annulés.”

Il a ajouté:

“C’est pourquoi il est si stratégique et si important de réunir les entreprises et les décideurs politiques en matière d’énergie, et c’est pourquoi l’AIE continuera de travailler avec les dirigeants du monde entier sur cette question essentielle.”

Un observatoire de l’énergie, de l’IA et des centres de données

Mr Birol a annoncé que l’AIE lancera le 10 avril prochain ce nouvel observatoire afin de collecter les données les plus complètes sur les besoins en électricité de l’IA et sur les innovations de rupture pour l’IA appliquée à l’énergie.

Elle a également prévu de publier un “rapport spécial sur l’énergie et l’IA” ce même jour. Il explorera des solutions pour répondre à la demande énergétique croissante des centres de données et comment les innovations en IA pourraient transformer la production, la consommation et la distribution de l’énergie.