Sécurité des puces H20 : Pékin convoque NVIDIA après des soupçons de fonctions de traçage à distance

Au-delà des débats qu’il a pu susciter, les performances du modèle DeepSeek R1, doté de capacités de raisonnement avancées, ont surpris les experts. Alors qu’il a été présenté fin janvier, l’industrie automobile chinoise s’en est très vite emparée. Du fournisseur de technologies de mobilité ECARX aux constructeurs eux-mêmes à l’image de Geely ou BYD, il a été intégré pour des applications variées allant de l’assistance à la conduite à l’amélioration des interactions entre conducteurs et véhicule.

Geely, acteur majeur de l’automobile chinoise avec des marques comme Smart, Volvo ou Zeerk, a été le premier à annoncer intégrer DeepSeek-R1 pour perfectionner Xingrui, le LLM au coeur de son système “Full-Domain AI for Smart Vehicles” présenté en janvier dernier au CES 2025.

Cette intégration permet d’améliorer la reconnaissance vocale, l’analyse des images et la gestion des données en temps réel. L’objectif est de fluidifier l’interaction entre les conducteurs et leurs véhicules, tout en optimisant la prise de décisions en temps réel, notamment pour les systèmes d’aide à la conduite.

BYD(Build Your Dreams), l’un des leaders de l’automobile électrique, a intégré DeepSeek dans son système de conduite autonome de niveau 2 DiPilot (baptisé God’s Eye). Ce système repose sur une IA avancée qui permet une assistance au stationnement et une navigation autonome plus précises. L’objectif est d’améliorer la sécurité et de rendre les véhicules plus intelligents et autonomes, tout en réduisant la dépendance aux infrastructures cloud.

Great Wall Motors exploite DeepSeek pour entraîner son IA interne avec des données collectées, afin de développer des fonctionnalités proactives pour ses assistants embarqués. Cette approche, qui améliore l’interaction entre les conducteurs et leur véhicule, vise à rendre la conduite plus intuitive et à renforcer l’ergonomie des systèmes d’assistance.

SAIC a misé sur DeepSeek pour améliorer l’expérience utilisateur de ses véhicules connectés. Son intégration de permet de répondre de manière plus précise et personnalisée aux besoins des conducteurs. Les assistants virtuels de SAIC sont désormais capables d’adapter leurs réponses et recommandations en fonction des habitudes de conduite et des préférences des utilisateurs.

Dongfeng a également adopté DeepSeek pour optimiser ses systèmes d’infodivertissement. Cette intégration permet d’offrir une expérience plus immersive et intuitive, avec une interaction vocale améliorée et des recommandations adaptées aux habitudes des conducteurs. L’objectif est de faciliter l’utilisation des fonctionnalités du véhicule et d’améliorer le confort de conduite.

ECARX, fournisseur de technologies de mobilité, a choisi DeepSeek-R1 pour développer son application d’IA embarquée, ECARX AutoGPT. Cette solution permet d’exécuter des tâches complexes en local, sans dépendance aux ressources cloud. Parmi les bénéfices attendus, on retrouve une meilleure protection des données, une réduction de la latence et une diminution des coûts de transmission et de stockage.

D’autres constructeurs automobiles chinois ont l’intention eux aussi de mettre à jour leur assistant d’IA embarquée avec DeepSeek R1. Le modèle a par ailleurs été rapidement adopté dans d’autres secteurs, notamment par trois des principaux opérateurs de télécommunications : China Mobile, China Telecom et China Unicom.

AMD (Advanced Micro Devices), acteur majeur des semi-conducteurs et concurrent de NVIDIA sur le marché des GPUs et des puces IA, a annoncé hier la signature d’une lettre d’intention avec le Commissariat à l’énergie atomique et aux énergies alternatives (CEA). Ce partenariat avec l’un des principaux organismes de recherche scientifique français vise à repousser les limites du calcul haute performance et à optimiser l’efficacité énergétique des infrastructures IA, répondant ainsi aux besoins croissants de secteurs stratégiques comme l’énergie et la médecine où les besoins en calcul sont particulièrement élevés.

Le CEA se concentre sur quatre principaux domaines : les énergies bas carbone, le numérique, les technologies pour la médecine du futur, ainsi que la défense et la sécurité.

En mettant en synergie l’expertise du CEA en matière de recherche et d’architecture informatique et le savoir-faire d’AMD dans le domaine des semi-conducteurs et du HPC, les deux partenaires travailleront au développement des technologies avancées, composants et architectures de système de prochaine génération.

L’un des principaux défis que vise à relever ce partenariat est celui de l’efficacité énergétique. L’essor des modèles d’IA toujours plus complexes et gourmands en calcul nécessite des solutions capables de concilier puissance de traitement et sobriété énergétique.

Ralph Witting, Corporate Fellow et responsable de la recherche chez AMD, souligne :

“Le calcul IA continue de stimuler l’innovation dans tous les secteurs de l’industrie, et une collaboration internationale est critique pour repousser les limites du possible. Avec ce partenariat avec le CEA et les ingénieurs français de premier plan, nous visons à rapprocher la recherche de pointe sur l’IA des applications du monde réel en faisant progresser les architectures de systèmes répondant aux exigences des charges de travail de l’IA de demain.”

Au-delà des avancées technologiques, ce partenariat s’inscrit dans une volonté de renforcer les liens entre les acteurs industriels et académiques américains et européens. En prévoyant l’organisation d’un symposium cette année sur le calcul IA, AMD et le CEA ambitionnent de réunir les parties prenantes européennes du secteur, les fournisseurs mondiaux de technologies, les start-ups, les centres de calcul intensifs, les universités et les responsables politiques.

Julie Galland, Directrice de la recherche technologique du CEA, affirme :

“Le CEA est engagé à stimuler l’innovation dans le domaine du calcul IA en faisant progresser les technologies de nouvelle génération ouvrant la voie à des architectures de rupture qui concilient performance et efficacité énergétique. Notre collaboration avec AMD représente une étape importante dans la promotion de la coopération internationale dans l’informatique de haute performance, en réunissant une expertise de classe mondiale pour adresser les besoins grandissant de charge de travail IA.”

AMD a par ailleurs annoncé que ses derniers GPUs Instinct alimenteront l’un des centres de données dédiés à l’IA de la société DataOne. Situé à Grenoble, il devrait être opérationnel dans quelques mois. Il pourrait faire partie des investissements des Emirats arabes unis annoncés par Emmanuel Macron puisque G42, basé à Abu Dhabi, est impliqué dans le projet via l’une des sociétés de son portefeuille, Core42.

Lisa Su, présidente et directrice générale d’AMD, commente :

“Notre collaboration stratégique avec G42 contribuera à dynamiser l’écosystème français de l’IA, en fournissant la capacité de calcul nécessaire pour permettre aux start-ups locales et aux pionniers de l’IA de bénéficier d’une innovation de pointe et de renforcer l’économie française.”

Le collectif Impact AI, en collaboration avec le cabinet d’audit et de conseil KPMG et BNP Paribas, a publié hier la première édition de son “Observatoire de l’IA responsable”. Ce rapport, réalisé avec l’institut de sondage Viavoice et le centre de prospective GCF, analyse les perceptions des salariés du secteur privé en France quant au déploiement de l’IA dans leur entreprise.

Plus de la moitié des salariés français (52 %) considère que l’IA joue un rôle crucial dans le développement et le rayonnement d’un pays, une proportion qui grimpe à 74 % parmi les utilisateurs réguliers de ces technologies. Pour ces derniers, les grands gagnants du développement de l’IA sont les Etats-Unis (53 %), devant la Chine (42 %), la Corée du Sud (33 %), la France (30 %) l’UE (29 %) et Israël (29 %).

Près de 75 % des salariés jugent nécessaire de réguler le développement de l’IA, 37 % « tout à fait nécessaire », 85 % des utilisateurs de l’IA sont également en faveur d’une régulation.

Les salariés expriment une préférence pour une régulation exercée par une agence internationale (30 %), 25 % penchent pour une régulation de l’état et pour 19 %, elle devrait être assumée par l’Europe. Cependant, l’AI Act suscite un accueil favorable : 57 % des salariés le considèrent comme une avancée positive, un chiffre qui atteint 75 % chez les utilisateurs d’IA.

Concernant les projets IA des entreprises, seule une minorité (10 %) place l’innovation au sommet des priorités, 36% des salariés interrogés, quelle que soit la taille de l’entreprise et le secteur d’activité, prônant un équilibre entre innovation, responsabilité et sécurité et 21 % estimant qu’il faut privilégier le respect des principes éthiques.

Parmi les risques identifiés, l’impact sur l’emploi arrive en tête (41 %), suivi des inquiétudes relatives à la confidentialité des données (33 %) et à une dépendance excessive à l’IA (31 %). Les salariés citent ensuite la non-conformité aux réglementations (24 %), le manque de transparence quant aux tâches réalisées par l’IA (23 %), l’amplification de stéréotypes liés à la présence de biais dans les algorithmes (17 %), les risques d’uniformisation du travail (17 %) et l’impact environnemental (11 %).

La définition de l’IA responsable proposée aux salariés interrogés était la suivante : “une intelligence artificielle responsable est conçue pour respecter des principes éthiques, garantir la transparence et minimiser les risques potentiels, y compris les biais dans ses algorithmes. Elle favorise l’inclusion sociale et la protection des données, tout en étant capable de choix explicables. De plus, elle vise à améliorer le bien-être humain sans causer de dommages sociaux, environnementaux ou de santé”.

Pour 63 % des salariés et 83 % des utilisateurs d’IA dans le cadre professionnel, le développement d’une telle IA est essentielle ou indispensable. Pour près de 8 salariés sur 10 une IA responsable doit s’attacher au respect de l’être humain, de sa santé, de son bien-être et de ses droits. Interrogés sur les domaines où la responsabilité de l’IA devait être appliquée en priorité, les sondés citent :

L’IA responsable n’est pas seulement perçue comme une nécessité éthique. Pour 44 % des salariés, elle améliore l’efficacité, favorise une prise de décision optimisée (39 %) et réduit la consommation de ressources (32 %).

Malgré l’importance accordée à l’IA responsable, 63 % des salariés ignorent les initiatives menées par leurs entreprises dans ce domaine. Seulement 9 % peuvent se référer à une charte éthique ou un interlocuteur spécialisé.

Pour accélérer cette acculturation à l’IA responsable, les salariés suggèrent qu’un certain nombre de freins soient levés, comme le manque de compétences internes, cité par 30 % des salariés, la complexité technique de l’IA (26 %), les coûts élevés de sa mise en œuvre (24 %), la résistance au changement (22 %) ou le manque d’engagement de la direction.

Christophe LIÉNARD, Président d’Impact AI, commente :

“Les conclusions de cette première édition de l’Observatoire de l’IA responsable montrent la grande sensibilité des Français aux notions d’IA responsable et d’IA éthique et vont donc nourrir les grands travaux que le collectif entend mener en 2025, avec l’impulsion de l’AI Action Summit de février : autour du travail, de la santé, de l’environnement et pour toujours plus de formation et d’appropriation de toutes et tous des outils d’IA responsable”.

En amont du Sommet mondial de l’IA de Paris, le Conseil économique, social et environnemental (CESE) a adopté hier à 99 voix pour, 22 abstentions et 10 voix contre, l’avis “Pour une IA au service de l’intérêt général”. Ce document propose un cadre d’acceptabilité inédit pour le déploiement de l’IA dans la société française. Élaboré par une commission temporaire composée de conseillers issus de la société civile organisée et de 10 citoyens tirés au sort, cet avis offre une contribution sur l’impact de l’IA dans des domaines clés tels que le travail, la santé, l’éducation et les services publics.

Troisième assemblée constitutionnelle de la République française, le CESE assure le lien entre les pouvoirs publics et les citoyens. Ses 175 membres, répartis en divers groupes de travail, sont désignés pour 5 ans par des syndicats, des organisations patronales, des associations ou des ONG. Il peut également associer à ses travaux des citoyens tirés au sort et organiser des conventions citoyennes ou des consultations en ligne.

Les travaux adoptés par le Bureau sont ensuite publiés au Journal Officiel et transmises au Gouvernement et au Parlement afin de les éclairer dans l’élaboration des politiques publiques.

Le CESE souligne l’importance de garantir que l’IA soit déployée de manière responsable, éthique et durable. Pour garantir que l’IA serve réellement l’intérêt général, il identifie quatre critères fondamentaux :

Le CESE propose 32 préconisations clés, parmi lesquelles :

L’IA doit être d’abord envisagée comme un outil au service de besoins essentiels (santé, éducation, accessibilité). Son impact sur les conditions de travail, qu’il ait des effets positifs (automatisation de tâches répétitives, optimisation de l’efficacité…) ou négatifs (sentiment de perte de compétence, surveillance excessive…), doit être mesuré et régulièrement discuté.

Le CESE préconise donc d’inclure l’IA dans le dialogue social et recommande la mise en place d’un accord national interprofessionnel (ANI) sur les modalités de déploiement de l’IA dans les entreprises. Cet accord, négocié par tous les partenaires sociaux, doit assurer un déploiement maîtrisé de l’IA, au service des travailleurs et en adéquation avec les besoins identifiés.

32% de la population française, soit 16 millions de personnes, se considère éloignée du numérique. Le CESE prône un plan national de formation au numérique et à l’IA, adapté à tous les âges. Les usages et les risques potentiels de l’IA devront par ailleurs être intégrés au plan national de formation du personnel éducatif, des médiateurs numériques, des travailleurs sociaux et des agents publics.

Pour que les citoyens puissent faire des choix éclairés quant au déploiement de l’IA, il est crucial de les sensibiliser à ses impacts environnementaux, tels que la consommation d’énergie, d’eau et de ressources pour les infrastructures d’IA, et de les former à un usage plus frugal de l’IA. Le CESE souligne la nécessité de prendre en compte les conflits potentiels liés à l’implantation de nouveaux centres de données, appelant à une communication transparente sur les conséquences associées et à une réelle considération des retours citoyens.

L’IA ne doit pas être imposée : les services publics doivent préserver une option humaine, pour garantir l’universalité de l’accès au service public et la liberté de choix de tous.

Selon le CESE, les biais intrinsèques des IA, liés aux jeux de données et aux choix des concepteurs, confèrent à ces technologies une dimension politique. Il appelle à garantir la transparence et l’explicabilité des décisions et des résultats produits par les IA. Il préconise également de renforcer les exigences de la réglementation européenne en matière de transparence des algorithmes et des données d’entraînement, de diversifier ces dernières pour limiter les biais, et de clarifier les règles de protection des données personnelles en conformité avec le RGPD.

LightOn, l’un des fleurons français de l’IA, pionnier de l’IA générative pour les entreprises, annonce le lancement de ModernBERT, une version modernisée et optimisée du célèbre modèle BERT. Fruit d’une collaboration avec le laboratoire de R&D Answer.AI, cette famille de modèles a été conçue pour répondre aux besoins des environnements professionnels français et européens.

BERT (Bidirectional Encoder Representations from Transformers) largement utilisé dans le domaine du traitement automatique du langage naturel (TALN), développé par des chercheurs de Google AI Language en 2018, est encore largement utilisé aujourd’hui. Les modèles dérivés comme ModernBERT continuent d’améliorer et d’optimiser les performances de BERT pour répondre aux besoins croissants des entreprises et des chercheurs.

Les deux modèles d’encodeur de la famille ModernBERT tirent parti des avancées réalisées pour les LLMs, des modèles principalement à décodeur, qui permettent d’améliorer l’efficacité, la rapidité et la capacité à gérer des tâches complexes comme la classification de texte. ModernBERT-base et ModernBERT-large, qui ont respectivement 149 millions et 395 millions de paramètres, proposent une longueur de séquence maximale de 8192 tokens, un net progrès par rapport à la limite de 512 tokens des versions antérieures de BER

ModernBERT se distingue par des améliorations notables en matière de performances et de flexibilité. Parmi ses caractéristiques clés :

ModernBERT est spécifiquement conçu pour répondre aux exigences des entreprises européennes en matière de gestion de données et de conformité réglementaire. Son architecture modulaire permet une intégration rapide aux outils métiers existants, en assurant la confidentialité des données, un aspect crucial pour des secteurs sensibles comme la finance, la santé ou encore la défense.

En intégrant ModernBERT dans les pipelines de « Retrieval Augmented Generation » (RAG), les entreprises peuvent combiner la recherche d’informations pertinentes avec des modèles génératifs, garantissant des réponses contextuelles et précises tout en optimisant les flux de travail internes.

Le jeudi 21 novembre dernier, Ynov, une école privée qui forme aux métiers du numérique, de la création et de l’innovation, a officiellement inauguré à Croix, l’extension de son campus métropolitain lillois, ouverte à la rentrée 2024.

Ynov est présent dans 13 métropoles avec 13 campus et près de 10 000 étudiants inscrits dans ses 64 diplômes (BTS, Bachelors, Mastères, reconnus par l’État) couvrant des secteurs tels que l’informatique, la cybersécurité, l’IA, le marketing digital, l’architecture d’intérieur, la création et le design digital ainsi que l’audiovisuel.

Le taux d’employabilité des diplômés, particulièrement élevé, atteste de l’efficacité de son modèle pédagogique. En sortie de Mastère, 92% d’entre eux trouvent un emploi dans les six mois, avec une rémunération moyenne de 36K€ par an. L’école propose également Connect Ynov Campus, une offre de formation 100% en ligne.

Le campus lillois a ouvert ses portes en 2022. L’inauguration de son extension à Croix, une ville située à une dizaine de kilomètres de Lille, a eu lieu en présence de Lionel Desage, président d’Ynov, et de près de 200 invités, dont des élus et des partenaires clés.

Les nouveaux locaux ont été pensés pour stimuler l’innovation et la créativité des étudiants. Sur le site de l’ancien siège social des 3 Suisses, entièrement rénové, cette extension de 3000 m² compte 12 salles de cours modernes, un studio de création 3D, deux studios de tournage professionnels et une cyberwaroom. Ces équipements soutiennent une pédagogie orientée vers l’agilité, l’entrepreneuriat et l’innovation, des valeurs au cœur de la mission de Ynov.

Le campus peut désormais accueillir plus de 620 étudiants, dont 230 en alternance. Son ambition est d’accueillir 1 000 étudiants d’ici 2027/2028, ce qui lui permettra de consolider son rôle clé dans le paysage éducatif et économique des Hauts-de-France.

En s’implantant dans la commune de Croix, Ynov contribue à la revitalisation du territoire et à la croissance de l’écosystème numérique régional. L’établissement entretient des partenariats solides avec plus de 160 entreprises, offrant ainsi aux étudiants un large éventail d’opportunités professionnelles et de stages.

Matthieu Bouton, Directeur Lille Ynov Campus, conclut :

“Ce campus est bien plus qu’un lieu d’apprentissage, il est un espace d’innovation qui accompagne le développement de l’écosystème numérique local. Notre ambition est de former une génération prête à relever les défis de demain, tout en faisant rayonner le territoire”.

L’IA, peut-elle améliorer le quotidien des médecins ? De nombreuses études attestent que oui. Confrontés à une surcharge de travail, qu’espèrent les pathologistes et oncologistes de l’IA ? Owkin, licorne franco-américaine spécialisée en biotechnologie, répond entre autres à ces questions dans le rapport “State of the Nation : Opportunities and Challenges for Digital Pathology and AI Solutions “.

Owkin a mené cette étude en partenariat avec le cabinet Censuswide auprès de 312 pathologistes et oncologues au Royaume-Uni, aux États-Unis et en France en juillet 2024. Alors que les pressions sur les systèmes de santé ne cessent d’augmenter, elle met en lumière les défis auxquels sont confrontés ces médecins : augmentation de charge de travail, complexité des diagnostics et épuisement professionnel. Elle souligne également le potentiel de l’IA dans le domaine de la santé : rationalisation des flux de travail, amélioration des soins aux patients, aide au diagnostic, traitement personnalisé adapté à chaque patient…

Meriem Sefta, responsable en chef des diagnostics chez Owkin, explique :

“Lorsque les médecins sont surchargés de travail, cela peut entraîner des erreurs de diagnostic, des retards dans les rapports et une réduction générale de la qualité des soins. Cela peut alors avoir un impact négatif sur les résultats des patients. La pathologie numérisée et l’IA sont prêtes à faire une réelle différence dans ce contexte, en allégeant le fardeau des pathologistes et en veillant à ce que les soins aux patients soient toujours aussi efficaces que possible”.

Selon Owkin, les conclusions de ce rapport mettent en évidence l’urgence d’agir face aux défis croissants auxquels sont confrontés les pathologistes. Il révèle en effet une réalité préoccupante : les pathologistes et oncologues sont confrontés à une charge de travail croissante, au stress et à l’épuisement professionnel, ce qui peut compromettre la qualité des soins.

Ils sont :

L’augmentation de l’incidence du cancer et la complexité croissante des diagnostics exacerbent ces pressions, alors que de nombreux pathologistes approchent de la retraite et qu’ils sont moins nombreux à entrer sur le marché du travail.

C’est également la santé des patients qui en souffre :

Selon les résultats de l’étude, 77 % des praticiens voient dans l’IA un moyen de réduire les délais d’attente pour les tests et de pallier les problèmes de personnel, 74 % d’entre eux pensent qu’elle peut accélérer les diagnostics oncologiques. Par ailleurs, la confiance dans les outils d’IA se renforce : 82 % des pathologistes les perçoivent positivement.

L’IA est capable d’automatiser les tâches répétitives, de prioriser les cas urgents et de fournir des analyses prédictives. Elle pourrait ainsi améliorer non seulement les flux de travail, mais aussi les résultats pour les patients. Cependant, les professionnels insistent sur un point crucial : l’IA doit compléter, et non remplacer, leur expertise.

Malgré ces perspectives optimistes, l’adoption de l’IA et des technologies numériques est freinée par plusieurs obstacles : le manque de ressources et d’infrastructures (43 %), les coûts élevés (23 %), et le financement insuffisant (23 %) ralentissent la transition.

Le rapport identifie des pistes pour accompagner cette transformation : la normalisation des protocoles d’imagerie et des flux de travail pour l’interopérabilité, l’accès élargi via des solutions cloud, et l’éducation des professionnels sur les capacités de l’IA sont essentiels. Mais au-delà des aspects techniques, c’est un changement culturel qui s’impose : les praticiens doivent être soutenus dans l’acceptation de ces nouveaux outils, notamment avec une modification des modes de remboursement. La perception des patients, déjà favorable selon 70 % des répondants, pourrait aussi accélérer cette adoption.

Owkin a organisé un webinaire le 9 décembre dernier afin d’analyser les résultats de l’enquête et de faire le point sur la numérisation et l’intégration des solutions d’IA dans les flux de travail des pathologistes. Si vous êtes intéressé-e, vous pouvez le retrouver ici.

Alors que ChatGPT vient de fêter son second anniversaire et compte aujourd’hui plus de 300 millions d’utilisateurs hebdomadaires, le rapport “Online Search After ChatGPT: The Impact of Generative AI”, réalisé par Semrush et Statista, explore comment l’IA redéfinit la recherche en ligne et le marketing numérique.

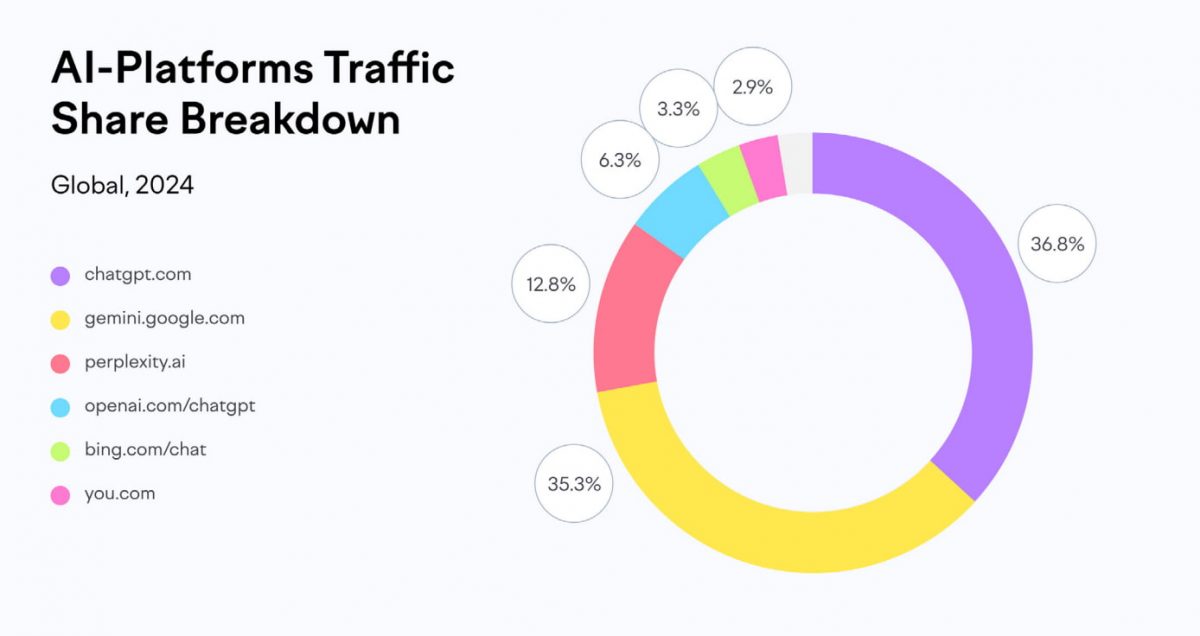

En l’espace de deux ans, la GenAI a bouleversé les habitudes des internautes. Ceux-ci utilisent aujourd’hui des outils d’IA comme ChatGPT ou Gemini de Google pour effectuer leurs recherches en ligne, témoignant d’une adoption rapide et évolutive. Ces deux plateformes dominent le marché, captant à elles seules 78 % du trafic mondial lié à la recherche par IA, selon les données de Semrush. Les troisième et quatrième modèles les plus populaires (Perplexity.et Bing de Microsoft), représentent quant à eux deux 16 % du trafic de recherche par IA.

Cette croissance s’accompagne d’une redéfinition des méthodes de recherche. Les utilisateurs délaissent progressivement les mots-clés au profit de requêtes conversationnelles, attendant des réponses précises et rapides. Cette évolution transforme la manière dont les contenus sont créés et optimisés, forçant les entreprises à réaligner leurs stratégies de référencement (SEO).

Les géants historiques comme Google et YouTube conservent une large domination grâce à leurs bases d’utilisateurs massives, respectivement 6 milliards et 3,5 milliards d’utilisateurs actifs. Cependant, la recherche par IA gagne du terrain tandis que les moteurs de recherche traditionnels, Google, Bing et Yahoo, sont confrontés à une baisse du trafic.

Si ChatGPT et Gemini occupent une place prépondérante, des alternatives émergent, comme Perplexity ou Brave Search. Les moteurs de recherche axés sur l’IA comme Brave Search et TikTok enregistrent des gains significatifs depuis 2022. En 2024, Brave Search, axé sur la confidentialité, a enregistré une croissance de 235 %.

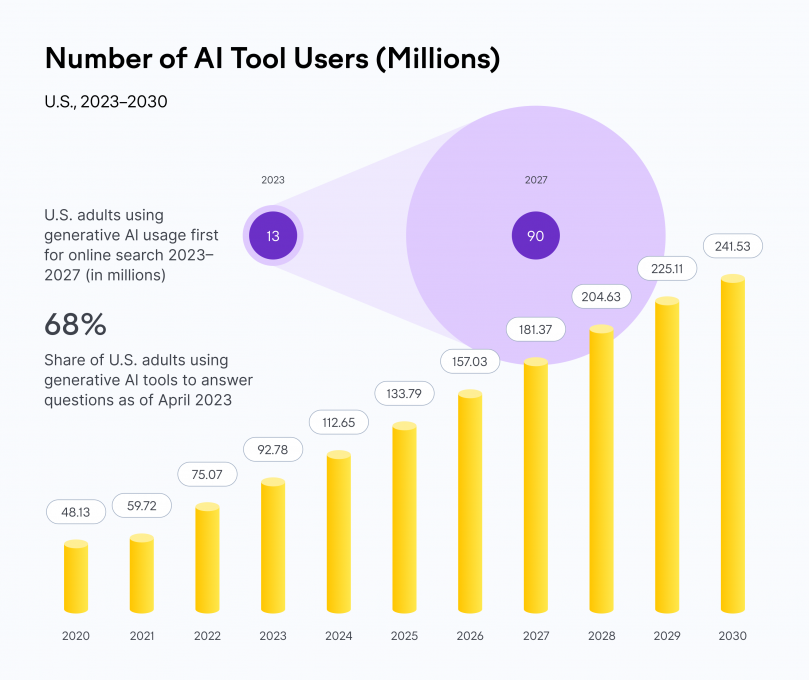

Selon le rapport, 13 millions d’adultes américains ont utilisé l’IA générative comme principal outil de recherche en ligne en 2023, un chiffre qui devrait atteindre plus de 90 millions d’ici 2027, soit près d’un tiers d’entre eux.

Les Etats-Unis sont d’ailleurs les principaux utilisateurs de ChatGPT, représentant 25 % du trafic mondial. Ils sont suivis de l’Inde avec 12,8 %, puis du Brésil et de la Chine avec respectivement 6,9 % et 4,9 %. Les principaux marchés européens comme l’Allemagne, le Royaume-Uni et la France figurent également dans le top 10.

Ces tendances régionales mettent en évidence l’importance d’élaborer des stratégies de contenu adaptées à des contextes culturels et linguistiques variés.

Malgré son adoption rapide, la recherche par IA générative suscite encore des interrogations. Plus de 60 % des utilisateurs actuels de la GenAI seraient enclins à le faire d’avantage si les modèles d’IA offraient plus de transparence et de sécurité. Pour répondre à ces attentes, les entreprises doivent garantir l’exactitude de leurs données et s’assurer que leurs contenus respectent les normes éthiques.

L’essor de la recherche par IA générative représente à la fois une opportunité et un défi pour les spécialistes du marketing numérique. Trois axes majeurs se dessinent :

Pour retrouver le rapport dans son intégralité, cliquer ici.

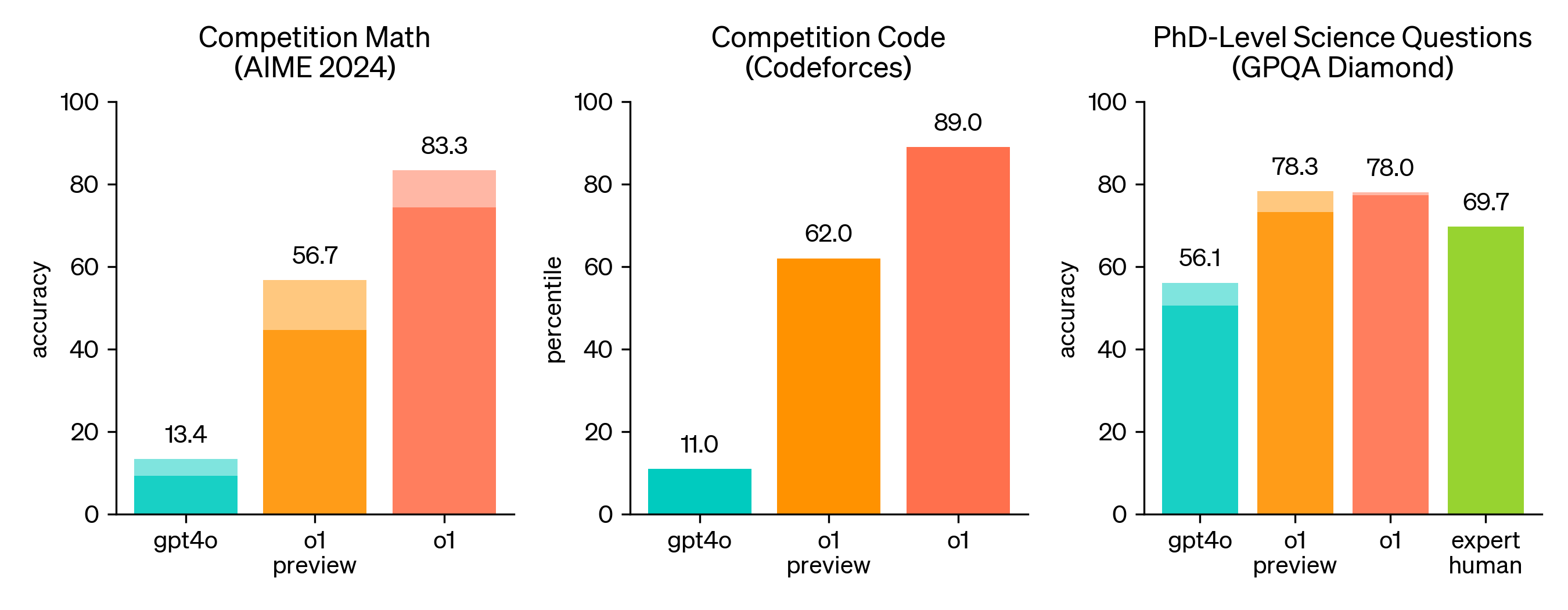

Alors que Meta prépare le lancement des premiers modèles Llama 4 pour le début de l’année prochaine, l’entreprise a dévoilé en fin de semaine dernière son dernier ajout à la famille Llama 3 : Llama 3.3 70B. Ce modèle, qui comme son nom l’indique compte 70 milliards de paramètres, est aussi performant que Llama 3 405B mais nécessite beaucoup moins de ressources.

LLama 3.3 70B a été annoncé par Meta sur X le 6 décembre dernier :

“Alors que nous continuons à explorer de nouvelles techniques de post-formation, nous lançons aujourd’hui Llama 3.3 – un nouveau modèle open source qui offre des performances et une qualité de pointe dans les cas d’utilisation basés sur du texte, tels que la génération de données synthétiques à une fraction du coût d’inférence”.

Il est distribué sous la “Llama 3.3 Community License Agreement”, qui permet l’utilisation, la reproduction, la distribution, la création d’œuvres dérivées et les modifications du modèle. Cependant, cette licence impose certaines conditions, comme l’obligation de fournir une copie de l’accord de licence avec toute distribution du modèle et d’afficher “Built with Llama” sur les produits dérivés. Les organisations comptant plus de 700 millions d’utilisateurs actifs mensuels devront quant à elles demander une licence commerciale.

S’il n’est pas open source au sens strict de l’OSAID, comme les modèles Llama 3.1 8B, 70B et 405 B, Llama 3.3 70B est un modèle “ouvert” exclusivement textuel. A leur instar, il est multilingue (anglais, allemand, français, italien, portugais, hindi, espagnol et thaïlandais), dispose d’une fenêtre contextuelle pouvant aller jusqu’à 128 000 tokens et de capacités de raisonnement renforcées.

Il a été pré-entraîné sur 15 000 milliards de tokens à partir de données accessibles au public avant d’être affiné sur plus de 25 millions d’exemples générés synthétiquement. Ses connaissances s’arrêtent en décembre 2023. Il utilise l’apprentissage par renforcement avec retour humain (RLHF) et le réglage fin supervisé (SFT), ce qui lui permet de générer des réponses sûres et utiles.

Llama 3.3 70B innove en utilisant la technique Grouped Query Attention (GQA) ce qui lui permet de traiter des tâches complexes de manière plus efficace tout en nécessitant moins de ressources informatiques.

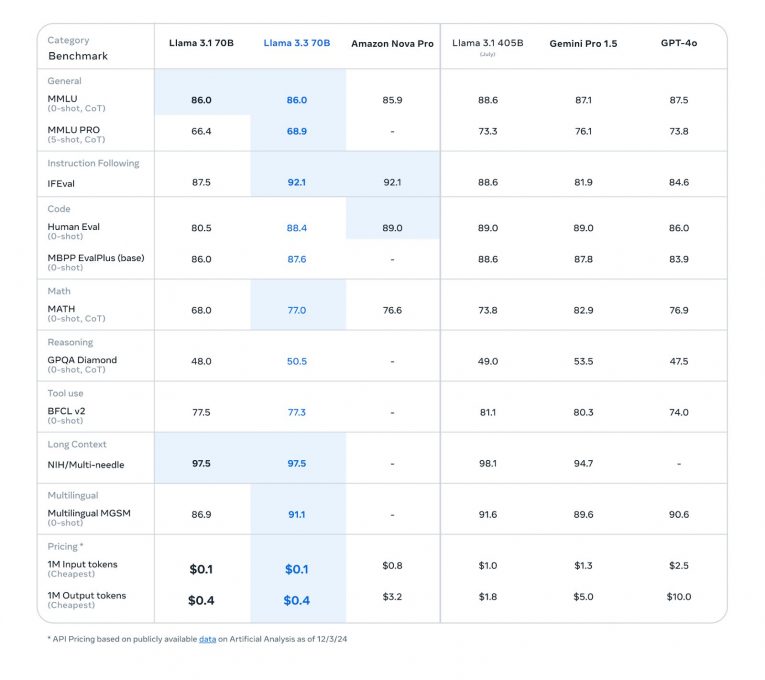

Meta a évalué les performances du modèle par rapport à celles de ses prédécesseurs Llama 3.1 70B et 405B et celles de ses concurrents Gemini 1.5 Pro de Google, GPT-4o d’OpenAI et Nova Pro d’Amazon.

Les scores obtenus par LLama 3.3 70B montrent qu’il est particulièrement adapté pour des cas d’utilisation nécessitant un bon suivi des instructions, une prise en charge multilingue efficace et le traitement de données volumineuses ou complexes :

Le modèle peut être téléchargé sur Meta, Hugging Face, GitHub.

Ce dimanche 1ᵉʳ décembre 2024, l’Afrique du Sud a officiellement pris la présidence du G20 pour un an, avec comme devise “Solidarité, Égalité et Durabilité”. Les travaux de 2025 porteront sur trois priorités définies par le pays : une croissance inclusive, la sécurité alimentaire et l’IA. L’UNESCO, l’Organisation des Nations Unies pour l’éducation, la science et la culture, apportera son expertise dans ce dernier domaine.

En 2024, sous la présidence du Brésil, l’UNESCO a acquis le statut de partenaire privilégié du G20. L’Organisation a participé à une quinzaine de groupes de travail dans le cadre de son mandat pour l’éducation, la science, la culture, l’information et la communication.

Elle voit son rôle s’élargir sous l’égide de l’Afrique du Sud, premier pays africain à assumer la présidence de ce forum créé en 1999 pour promouvoir la coopération économique mondiale. Son expertise sera en 2025 intégrée non seulement aux discussions des ministres des Affaires étrangères, mais aussi à celles des ministres des Finances, avec un focus sur l’IA.

Audrey Azoulay, Directrice générale de l’UNESCO, indique :

“Après une coopération fructueuse avec le G20 en 2024, à l’initiative du Brésil, l’UNESCO s’enorgueillit de voir son statut de partenaire privilégié s’élargir en 2025 sous la présidence de l’Afrique du Sud. Notre priorité commune sera le développement d’une intelligence artificielle éthique qui soutient les objectifs de développement durable des Nations Unies”.

En novembre 2021, les États membres de l’UNESCO ont adopté à l’unanimité le premier cadre éthique mondial pour l’IA présenté par Audrey Azoulay lors de la Conférence générale de l’organisation. Celle-ci accompagne actuellement une soixantaine de pays dans la régulation et l’application de l’IA afin de garantir que cette technologie, souvent perçue comme disruptive, soit mise au service du bien commun.

Avec 70 % de sa population âgée de moins de 30 ans, l’Afrique se positionne comme un territoire clé pour exploiter le potentiel de l’IA. Selon l’Union africaine, l’IA pourrait générer entre 110 et 220 milliards de dollars par an pour les économies africaines, tout en stimulant l’innovation et en créant des emplois. Utilisée judicieusement, elle pourrait également optimiser les services publics dans des secteurs comme l’éducation et la santé, tout en aidant les pays africains à mieux s’adapter aux défis du changement climatique. Cependant, cet avenir prometteur reste conditionné par la résolution de défis structurels : aujourd’hui, seuls 40 % des Africains ont accès à Internet haut débit, un taux qui chute à 10 % dans les pays à faible revenu.

Pour répondre à ces enjeux, l’Union africaine a récemment adopté une stratégie continentale dédiée à l’IA que l’UNESCO accompagne à travers des programmes de formation destinés aux décideurs publics et aux administrations.

C’est dans ce contexte que l’organisation soutiendra le groupe spécial sur l’intelligence artificielle et l’innovation pour le développement durable mis en place par la présidence sud-africaine du G20.

Plusieurs mois après avoir demandé une pause dans le domaine de l’IA, le PDG de Tesla, SpaceX et X (ex-Twitter), Elon Musk, annonçait l’an passé la création de xAI. Peu de temps après, il dévoilait le premier produit de la start-up : l’IA générative Grok, qu’il souhaite positionner devant ChatGPT. Pour cela, il lui faut encore plus de puissance de calcul, il cherche donc à sécuriser un approvisionnement constant de GPUs, mettant la pression sur les chaînes d’approvisionnement de NVIDIA.

L’engouement des entreprises pour la GenAI a entraîné une demande massive des GPUs H100 de NVIDIA en 2023, qui annonçait alors des délais de livraison pouvant atteindre jusqu’à 52 semaines. Les puces de NVIDIA sont en effet les plus utilisées que ce soit pour les datacenters, les supercalculateurs, l’entraînement ou l’inférence des LLMs. Cette année, la société a considérablement augmenté sa production pour tenter de répondre à la demande du marché mais, selon des informations du Wall Street Journal, les demandes d’Elon Musk imposeraient ou auraient imposé une tension particulière sur ses chaînes d’approvisionnement.

Il faut reconnaître qu’Elon Musk dans son ambition de surpasser ses concurrents dans le domaine de la GenAI, a mis les bouchées doubles avec la construction de son supercalculateur Colossus, une réalisation qualifiée de surhumaine par Jensen Huang, le PDG de NVIDIA, en raison de la rapidité et de l’efficacité avec lesquelles le projet a été mené à bien. Il déclarait alors :

“Pour autant que je sache, il n’y a qu’une seule personne au monde qui puisse faire quelque chose comme ça en si peu de temps. Elon est unique dans sa compréhension de l’ingénierie, des grands systèmes, de la gestion des ressources – c’est tout simplement incroyable”.

Selon Elon Musk, le supercalculateur, construit en 122 jours à Memphis, dans le Tennessee, comptait 100 000 GPU H100 en septembre dernier et devait voir sa capacité de calcul doubler avec 50 000 nouveaux H100 et autant de H200 avant la fin de l’année. Colossus est en fait le plus grand cluster de calcul d’IA au monde.

La start-up en a les moyens puisqu’elle a levé 11 milliards de dollars cette année. En mai, elle a annoncé un tour de financement de 6 milliards de dollars avec la participation d’investisseurs de premier plan, notamment Valor Equity Partners, Andreessen Horowitz, Sequoia Capital, qui ont tous trois répondu présents pour une nouvelle levée de fonds de 5 milliards de dollars.

Les modèles text-to-audio ont fait parler d’eux avant que les modèles text-to-image ne leur volent la vedette. Les recherches pour améliorer les premiers se poursuivent, NVIDIA vient ainsi de dévoiler son “couteau suisse du son” : Fugatto (Foundational Generative Audio Transformer Opus 1). Ce modèle d’IA génère ou transforme des combinaisons de musique, de voix et de sons à partir de texte et d’audio.

Entraîné sur des millions d’échantillons audio, Fugatto est un modèle de fondation qui s’appuie sur les travaux antérieurs de ses créateurs dans des domaines tels que la modélisation de la parole, le vocodage audio et la compréhension audio. Il est le fruit d’un an de travail de cette équipe de chercheurs internationaux, ce qui a d’ailleurs permis de renforcer ses capacités multilingues. La version complète utilise 2,5 milliards de paramètres et a été entraînée sur une banque de systèmes NVIDIA DGX contenant 32 GPU NVIDIA H100 Tensor Core.

Fugatto peut non seulement générer des sons à partir de descriptions textuelles, mais aussi transformer des pistes existantes en ajoutant ou supprimant des éléments, ou encore en modifiant des caractéristiques vocales comme l’accent ou l’émotion. Il peut même permettre aux gens de produire des sons jamais entendus auparavant, comme une trompette qui aboie ou un saxophone qui miaule…

En effet, Fugatto ne se limite pas aux usages conventionnels de l’audio. Grâce à des fonctionnalités comme l’interpolation temporelle, le modèle peut générer des paysages sonores évolutifs. Par exemple, il peut créer un orage se transformant en une aube lumineuse, avec des chants d’oiseaux qui prennent progressivement le relais du tonnerre.

Le modèle utilise une technique appelée ComposableART pour combiner plusieurs instructions vues séparément pendant l’entraînement. Un utilisateur pourrait ainsi demander une voix triste avec un accent français, tout en ajustant précisément l’intensité de ces attributs. Cette capacité donne aux créateurs un contrôle artistique sans précédent, selon Rohan Badlani, chercheur en IA chez NVIDIA : ” Les résultats me donnaient l’impression d’être un artiste, même si je suis informaticien”.

Fugatto se distingue par sa capacité à répondre à des besoins variés, dans des secteurs aussi divers que la musique, le marketing, l’éducation ou encore le jeu vidéo. Les producteurs pourront expérimenter rapidement différents styles, ajouter ou supprimer des instruments, et même générer des effets sonores inédits. Comme le souligne Ido Zmishlany, producteur multi-platine :

“L’histoire de la musique est aussi une histoire de la technologie. La guitare électrique a donné au monde le rock and roll. Quand le sampler est arrivé, le hip-hop est né. Avec l’IA, nous écrivons le prochain chapitre de la musique. Nous avons un nouvel instrument, un nouvel outil pour faire de la musique – et c’est super excitant”.

Les agences de publicité auront la possibilité d’adapter leurs campagnes en appliquant divers accents et émotions aux voix off, les développeurs de jeux vidéo de créer des ressources audio dynamiques qui s’adaptent à l’action en temps réel. Les outils d’apprentissage des langues pourraient, quant à eux, être enrichis par des voix spécifiques, comme celle d’un ami ou d’un parent.

Kineis, acteur spatial français, annonce que ce lundi 25 novembre, à 4h55 (heure de Paris), le lanceur Electron de Rocket Lab a réussi la mise en orbite de 5 nouveaux satellites de sa constellation dédiée aux marchés mondiaux de l’Internet des Objets (IoT) et au secteur maritime, l’AIS (Automatic Identification System). Avec ce troisième lancement, baptisé « Ice AIS Baby », la start-up toulousaine se rapproche de son objectif : 15 nanosatellites sur les 25 prévus sont désormais déployés en orbite basse (LEO).

Kineis a été fondée en 2018 par le CNES (Centre National d’Etudes Spatiales) et sa filiale CLS (Collecte Localisation Satellites) pour opérer le système Argos. Ce système mondial de localisation et de collecte de données géo-positionnées par satellite a été créé en 1978 à l’initiative du CNES, de la NASA et de l’agence américaine d’observation océanique et atmosphérique (NOAA).

En 2020, Kineis a levé 100 millions d’euros pour financer le développement et le déploiement des 25 nanosatellites et 20 stations terrestres qui vont constituer sa constellation dont l’objectif est de démultiplier les capacités de suivi du système Argos.

Après avoir mis en orbite cinq premiers satellites en juin, puis cinq autres en septembre, depuis la base de lancement néo-zélandaise de Rocket Lab, située dans la péninsule de Māhia, le lanceur Electron vient donc de réaliser avec succès le troisième lancement. Le prochain devrait avoir lieu en décembre et le dernier, début 2025.

Alexandre Tisserant, Président de Kinéis, a salué cette étape :

“Les équipes Kinéis démontrent une fois de plus leurs capacités techniques

d’opérateur satellitaire avec la prise en charge de ces 5 nouveaux satellites

dans une cadence soutenue de lancements. Cet exploit n’aurait pu avoir lieu

sans la précision d’Electron de Rocket Lab pour placer nos satellites sur leurs

positionnements planifiés. Avec 15 satellites désormais en orbite, nous nous

rapprochons du déploiement complet de notre constellation dédiée à l’IoT

pour transmettre de la data en quasi-temps réel, en n’importe quel point du

globe. Félicitations à toutes nos équipes qui réalisent un travail incroyable,

et rappelons-le, une première européenne !”.

Initialement dédiée à l’IOT, Kinéis s’adresse depuis peu à un second marché tout aussi stratégique, celui de la surveillance du trafic maritime.

L’AIS satellitaire est un système maritime d’identification automatique des navires qui fonctionne par radiofréquences VHF (très haute fréquence). Il permet aux navires équipés de transpondeurs et aux systèmes de surveillance de connaître l’identité, la position, la direction et le statut des navires en mer.

Les données AIS sont utilisées pour la gestion du trafic maritime, la détection des comportements suspects, l’optimisation logistique, le renforcement de la défense et de la sécurité, la protection environnementale et l’analyse des données. Traditionnellement limitée à une portée de 100 km autour des antennes terrestres, l’AIS voit ainsi son efficacité multipliée grâce aux satellites Kinéis.

La technologie S-AIS de Kinéis, une antenne multibrins, constitue une avancée majeure. Par rapport aux satellites mono-brin classiques. L’antenne AIS Kinéis assure une qualité supérieure de réception puisque le signal du navire est reçu par chacun des 6 brins métalliques indépendants de l’antenne.

Celle-ci permet ainsi de capter jusqu’à 80 % des signaux dans des zones densément peuplées de navires. Cette performance, couplée à des algorithmes de détection sophistiqués (intégrant l’effet Doppler), garantit la fiabilité des données, même face aux tentatives de falsification de positionnement ou de « spoofing ».

En s’appuyant sur une technologie 100 % française, Kinéis revendique son rôle d’acteur souverain face à une compétition internationale dominée par des entreprises américaines ou asiatiques. La start-up ambitionne de traiter quotidiennement des millions de messages AIS, offrant une vision détaillée et fiable du trafic maritime mondial.

Alexandre Tisserant conclut :

“Nous sommes également enthousiastes concernant notre seconde mission, l’AIS. Dans un marché en pleine consolidation, Kinéis s’impose comme un acteur européen souverain combinant expertise technologique et indépendance stratégique. Grâce à notre nouvelle offre AIS, les acteurs maritimes bénéficient d’une visibilité renforcée sur leurs flottes et d’une fiabilité accrue des données”.

Le 28 novembre 2024, la Gendarmerie Nationale organise au Beffroi de Montrouge, Paris, une nouvelle édition des Rencontres AGIR (Accompagnement pour la Gendarmerie en Innovation et Recherche), un événement incontournable pour explorer les synergies entre innovation technologique, intelligence artificielle et sécurité publique. Cet événement stratégique, inscrit dans le cadre du plan GEND 20-24, vise à renforcer la collaboration entre les acteurs publics, privés et académiques pour répondre aux défis contemporains et futurs de la sécurité.

Les Rencontres AGIR, initiées par la Gendarmerie nationale, visent à partager les besoins opérationnels pour permettre aux industriels de concevoir des solutions adaptées. Bien plus qu’un simple échange, cet événement a déjà généré plus de 2M€ de marchés avec des entreprises rencontrées lors des éditions précédentes. La 4ᵉ édition a pour objectifs de rassembler la communauté de l’innovation des administrations publiques, des entreprises et du monde de la recherche, tout en accélérant la capacité d’action des acteurs d’État. Un hackathon low tech, coorganisé avec l’Agence Innovation Défense et le programme Centurion, impliquera étudiants et futurs ingénieurs pour imaginer les solutions de demain.

Cette année, les rencontres se dérouleront ce 28 novembre au Beffroi de Montrouge et bénéficie du soutien de partenaires institutionnels comme le ministère de l’Intérieur, ainsi que d’acteurs privés. « Ces rencontres incarnent la vision d’une gendarmerie tournée vers l’avenir, cherchant à conjuguer innovation et éthique pour relever les défis de demain », souligne le Général d’Armée Christian Rodriguez, directeur général de la Gendarmerie Nationale.

L’événement est aussi l’occasion de favoriser des échanges entre start-ups, grandes entreprises et institutions publiques via des rencontres BtoB. Ces rendez-vous personnalisés permettent de renforcer un réseau d’acteurs engagés dans l’innovation au service de la sécurité.

Cette édition 2024 mettra bien évidemment en avant l’impact de l’IA dans le domaine de la sécurité. Qu’il s’agisse de la détection proactive des menaces, de la gestion des données ou de l’aide à la prise de décision, l’IA redéfinit les pratiques opérationnelles. Les participants aux Rencontres pourront donc assister à des tables rondes réunissant des experts de la Gendarmerie et de l’industrie pour aborder les implications éthiques et opérationnelles de l’IA ainsi qu’à des sessions dédiées aux applications concrètes de l’IA, comme la reconnaissance faciale, la cybersécurité et les outils prédictifs dans la prévention des crimes.

Retrouvez le programme complet des Rencontres Agir sur le site Internet de l’événement.

Alors que les entreprises tentent de concilier performance économique et responsabilité environnementale, elles voient en l’IA un allié potentiel. Cependant, IBM a récemment publié le rapport “State of Sustainability Readiness Report 2024″, qui révèle un paradoxe dans les stratégies des entreprises : malgré une intention claire de renforcer les investissements dans l’IA et les technologies de l’information pour des pratiques durables, les actions concrètes tardent à suivre.

Le rapport State of Sustainability Readiness 2024 a été réalisé de manière indépendante par Morning Consult, sponsorisé, analysé et publié par IBM. Des entretiens ont été menés entre avril et mai 2024 auprès de 2 790 dirigeants et décideurs dans 15 secteurs d’activité et 9 pays. Le rapport comprend également des études de cas qui mettent en évidence l’intersection du développement durable et de la technologie.

Plus de la moitié des personnes interrogées considèrent l’investissement dans la technologie pour le développement durable comme une opportunité de croissance, et non seulement comme un moyen de réduire les coûts.

Le rapport indique que 88 % des dirigeants envisagent d’augmenter leurs investissements dans les technologies de l’information en faveur du développement durable d’ici l’année prochaine. Pourtant, un décalage important persiste entre l’ambition et la mise en œuvre. Si 90 % des dirigeants reconnaissent le potentiel de l’IA pour atteindre les objectifs de durabilité, plus de la moitié des entreprises (56 %) ne l’utilisent toujours pas activement dans ce domaine. Un retard dû principalement aux contraintes budgétaires.

Les résultats montrent que seulement 48 % des entreprises financent leurs investissements dans le développement durable via des budgets de fonctionnement réguliers. Ce pourcentage souligne que, dans de nombreux cas, l’engagement envers la durabilité reste sporadique et dépend de projets ponctuels, plutôt que d’une stratégie continue et intégrée.

Malgré son potentiel en matière de développement durable, l’IA pose elle aussi un défi environnemental. L’entraînement et l’utilisation de modèles d’IA consomment d’importantes quantités d’énergie, ce qui pousse les entreprises à envisager des solutions pour limiter leur impact, telles que l’optimisation des centres de données, l’investissement dans des processeurs à haut rendement énergétique et la collaboration open source. Ces stratégies peuvent non seulement diminuer l’empreinte écologique de l’IA, mais aussi améliorer leur efficacité opérationnelle et leur rentabilité.

Cependant, les organisations font face à un autre enjeu : trouver les talents adéquats en IA. Selon le rapport, dans le contexte actuel de pénurie de compétences, retenir les travailleurs expérimentés est l’un des trois principaux défis pour les dirigeants en matière de développement durable.

Le rapport souligne également un décalage de perception entre les cadres supérieurs et leurs collaborateurs quant aux attentes en matière de développement durable. Tandis que 67 % des cadres supérieurs estiment que leur organisation est proactive en matière de résilience climatique, seulement 56 % des décideurs de niveau inférieur partagent cette vision.

Cette disparité concerne des sujets clés tels que les risques financiers liés au changement climatique, les risques liés aux infrastructures physiques vulnérables aux phénomènes climatiques, les risques liés à la chaîne d’approvisionnement et aux dépendances critiques.

Un autre défi majeur identifié est la difficulté à mesurer les progrès en matière de durabilité. Bien que les entreprises surveillent des indicateurs comme la consommation d’énergie renouvelable, la consommation totale d’énergie et le recyclage, il leur est difficile de collecter et de structurer les données nécessaires pour des rapports précis et cohérents. Le rapport souligne que 50 % des dirigeants estiment que leurs données pour les indicateurs clés de performance (KPI) de durabilité ne sont pas suffisamment matures, ce qui rend le reporting et la prise de décision plus complexes.

IBM propose plusieurs pistes pour aider les entreprises à combler l’écart entre ambition et action. Parmi celles-ci, l’utilisation d’outils d’IA pour identifier les opportunités de réduction de carbone et une meilleure collecte des données pour réduire l’écart de perception en interne.

Teledyne FLIR, filiale de Teledyne Technologies Incorporated, acteur majeur du développement de solutions d’imagerie infrarouge, de systèmes intelligents et de détection, annonce l’ajout d’une nouvelle solution à sa famille de logiciels Teledyne FLIR Prism : Prism AIMMGen.

Prism AIMMGen est un service de génération de modèles d’IA exempt d’ITAR (International Traffic in Arms Regulations) qui permet la création automatisée de modèles d’IA et d’apprentissage automatique à l’aide de données générées synthétiquement. Il permet ainsi aux intégrateurs de systèmes qui développent des produits d’IA/ML pour des applications commerciales, de première intervention ou de défense de réaliser d’importantes économies en termes de coûts et de délais.

Le développement de modèles IA/ML nécessite traditionnellement une collecte et un étiquetage manuels des données, des tâches chronophages et coûteuses, particulièrement dans des contextes où les objets à détecter sont rares ou difficiles à capturer dans des scénarios réels, comme les cibles militaires. Prism AIMMGen surmonte ces obstacles en générant des millions d’exemples d’objets synthétiques, prêts pour le ML, dans des conditions variées et sur différents spectres, notamment la lumière visible et l’infrarouge. Ce processus réduit de façon drastique les délais et les coûts d’ingénierie, permettant de produire des modèles de haute qualité en quelques jours plutôt qu’en plusieurs semaines. Son infrastructure interne de MLOps garantit que les données sont sécurisées et que les modèles peuvent être développés, déployés et maintenus efficacement.

Dan Walker, Vice-président de Teledyne FLIR, explique :

“Avec le rythme et la sophistication que connaît le développement de systèmes, il est essentiel d’exploiter des données synthétiques intelligentes pour former les modèles d’IA les meilleurs de leur catégorie. AIMMGen accélère la mise sur le marché des développeurs tout en garantissant à leurs produits d’IA respectifs d’être prêts à faire face à tous les scénarios possibles dans pratiquement toutes les conditions environnementales”.

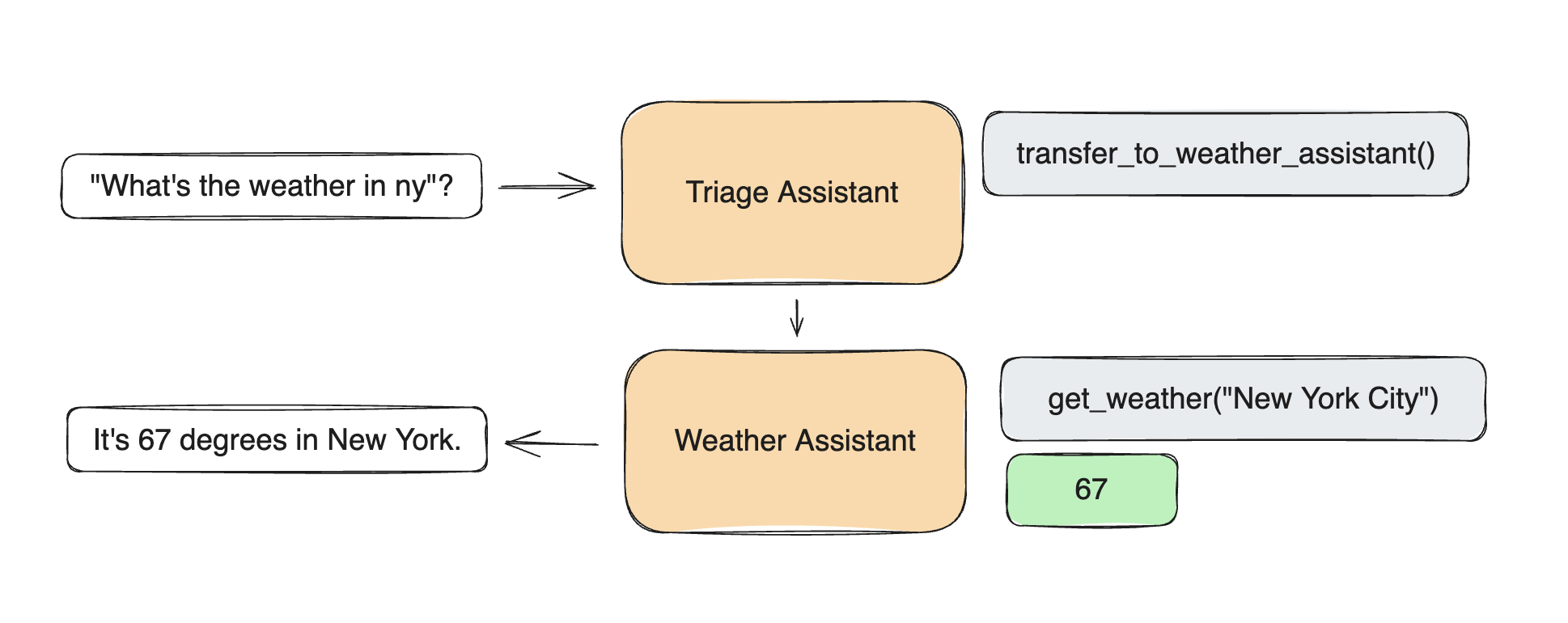

OpenAI a récemment dévoilé Swarm, un framework expérimental open source conçu pour orchestrer des systèmes multi-agents. Il fournit aux développeurs un schéma pour créer des réseaux d’agents d’IA interconnectés qui peuvent communiquer et collaborer afin de gérer des tâches complexes de manière autonome.

Swarm est une illustration de la façon dont les concepts de “routines”, des séquences d’actions prédéfinies que les agents suivent pour accomplir des tâches spécifiques, et de transferts, qui permettent à un agent de déléguer une tâche à un autre agent, peuvent être utilisés pour orchestrer plusieurs agents de manière simple et contrôlable.

Le framework repose sur l’idée que plusieurs agents, chacun avec des capacités uniques, peuvent améliorer la qualité et la rapidité des réponses ou actions dans un environnement dynamique. Par exemple, un agent peut se spécialiser dans la compréhension des instructions, tandis qu’un autre pourrait exceller dans l’analyse des données…

Swarm est construit autour de deux abstractions primitives :

Les agents dans Swarm peuvent accéder à un contexte partagé, leur permettant de se tenir informés des actions précédentes ou des données disponibles et ainsi collaborer plus efficacement en ayant une vue d’ensemble des opérations en cours.

Swarm propose déjà plusieurs exemples pratiques dans sa documentation, comme un scénario de service client, où un premier agent gère la question initiale d’un utilisateur et, si la requête devient plus technique, transfère la conversation à un autre agent spécialisé dans la vente ou le remboursement.

OpenAI le présente comme une ressource éducative pour les développeurs curieux d’en savoir plus sur l’orchestration multi-agents. Contrairement à l’API Assistants d’OpenAI, davantage conçue pour des flux de travail entièrement hébergés, Swarm s’exécute principalement sur le client, réduisant ainsi les besoins en infrastructure côté serveur et donnant aux développeurs le contrôle et la visibilité sur les interactions des agents. Son interface est similaire à celle de l’API de complétion de chat d’OpenAI, chaque interaction est exécutée individuellement, sans conserver un historique persistant.

OpenAI l’a rendu public sous la licence MIT, qui offre une grande flexibilité aux développeurs tout en offrant une protection minimale à ses concepteurs, rappelant que :

“Swarm est actuellement un framework d’échantillonnage expérimental destiné à explorer les interfaces ergonomiques pour les systèmes multi-agents. Il n’est pas destiné à être utilisé en production et ne bénéficie donc d’aucun soutien officiel. (Cela signifie également que nous n’examinerons pas les RP ou les problèmes !)

L’objectif principal de Swarm est de présenter les modèles de transfert et de routines explorés dans le livre de recettes Agents d’orchestration : transferts et routines. Il ne s’agit pas d’une bibliothèque autonome, mais principalement à des fins éducatives”.

Des développeurs utilisent déjà le framework dans le cadre de leur projet “Hierarchical Autonomous Agent Swarms (HAAS) visant à créer un écosystème d’agents d’IA autonomes et éthiquement gouvernés.

Alors que les applications commerciales potentielles de Swarm sont nombreuses (support client, analyses de marché, stratégies marketing…), le niveau d’automatisation introduit par les systèmes multi-agents soulèvent des préoccupations quant à leur impact sur l’emploi et le rôle de l’humain dans la prise de décision.

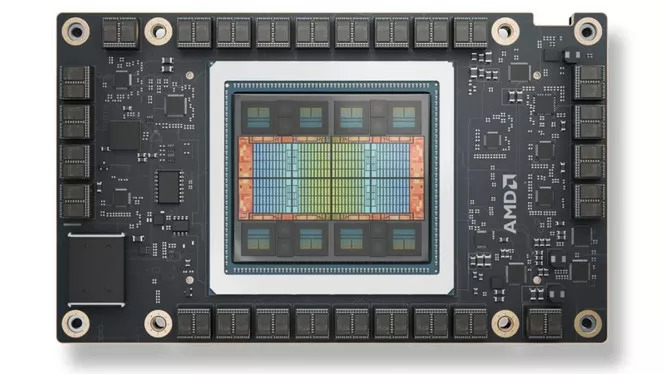

Lors de l’événement Advancing AI 2024, le 10 octobre dernier, Lisa SU a dévoilé les dernières solutions d’AMD conçues pour répondre aux besoins de l’IA à grande échelle dans les entreprises, les centres de données et le cloud. Parmi ces innovations, la 5ème génération de processeurs AMD EPYC, les accélérateurs AMD Instinct MI325X, les processeurs AMD Ryzen AI PRO série 300, ainsi que des solutions réseau de nouvelle génération.

En juin 2023, Lisa Su, PDG d’AMD, dévoilait le GPU Instinct MI300X, conçu pour l’IA générative et le HPC. Selon elle, les AMD Instinct MI325X établissent une nouvelle norme en matière de performances et d’efficacité pour l’entraînement et l’inférence des modèles d’IA générative et les centres de données Gen AI.

Le MI325X utilise la même architecture CDNA 3 que son prédécesseur. Pour la mémoire, AMD opte, comme NVIDIA avant lui avec le H200, pour la HBM3e, une mémoire 50 % plus rapide que la HBM3. Sa capacité étendue à 256 Go de HBM3e supporte un débit de 6,0 To/s, ce qui représente, selon AMD, 1,8 fois plus de capacité et 1,3 fois plus de bande passante que le H200. L’AMD Instinct MI325X offrirait également des performances théoriques en calcul FP16 et FP8 supérieures de 1,3 fois à celles de son concurrent.

Cette mémoire et ce calcul de pointe peuvent fournir, selon la société, jusqu’à 1,3 fois les performances d’inférence sur Mistral 7B à FP16, 1,2 fois les performances d’inférence sur Llama 3.1 70B à FP8, et 1,4 fois les performances d’inférence sur Mixtral 8x7B à FP16, du H200.

Les accélérateurs AMD Instinct MI325X devraient être mis en production ce trimestre et disponibles sur “le système d’un large éventail de fournisseurs de plateformes, notamment Dell Technologies, Eviden, Gigabyte, Hewlett Packard Enterprise, Lenovo, Supermicro et d’autres à partir du 1er trimestre 2025”.

AMD a d’autre part dévoilé en avant-première de nouveaux détails sur la prochaine génération d’accélérateurs AMD Instinct série MI350, qui devraient être disponibles au second trimestre 2025. Basés sur l’architecture AMD CDNA 4 et équipés de jusqu’à 288 Go de mémoire HBM3E, ces accélérateurs offriront une amélioration des performances d’inférence jusqu’à 35 fois supérieure par rapport à leurs prédécesseurs basés sur l’architecture AMD CDNA 3.

AMD a également déclaré avoir fait des progrès significatifs dans le développement des accélérateurs AMD Instinct MI400 Series basés sur l’architecture AMD CDNA Next, dont la disponibilité est prévue en 2026.

Conçue pour répondre aux exigences croissantes de l’IA et des charges de travail critiques de l’entreprise, la gamme AMD EPYC série 9005 utilise une conception hybride à puces multiples et des cœurs ‘Zen 5’ et ‘Zen 5c’. Elle comprend 29 processeurs différents, variant en termes de nombre de cœurs, de fréquences, de cache et de consommation électrique.

Ils intègrent des fonctionnalités avancées comme la prise en charge de la mémoire DDR5, des canaux PCIe Gen 5, ainsi que des optimisations pour les charges de travail liées à l’IA et au machine learning. Ils offrent également une haute densité de cœurs (jusqu’à 192 cœurs) et une efficacité énergétique améliorée, ce qui les rend idéaux pour les environnements virtualisés et les applications en cloud.

Selon AMD, il est possible de remplacer 100 anciens serveurs à deux sockets équipés de processeurs Intel Xeon 8280 de 28 cœurs par environ 14 nouveaux serveurs à deux sockets équipés de processeurs AMD EPYC 9965 qui comptent 192 cœurs.

La société affirme :

« Avec des chemins de données de 512 bits dans le cœur, des optimisations du pipeline d’instructions et des unités supplémentaires pour les opérations entières et en virgule flottante, le processeur peut exécuter une large gamme de charges de travail IA sur une infrastructure uniquement basée sur CPU, sans nécessiter d’accélération GPU ».

AMD a également présenté les processeurs Ryzen AI PRO série 300, destinés aux PC d’entreprise, intégrant les architectures Zen 5 et AMD XDNA 2, qui équipent les premiers ordinateurs portables Microsoft Copilot+.

L’entreprise a également élargi son portefeuille de réseaux haute performance pour répondre à l’évolution des exigences de mise en réseau système pour l’infrastructure d’IA avec le réseau frontal AMD Pensando Salina DPU. L’AMD Pensando Pollara 400, première carte réseau compatible avec l’Ultra Ethernet Consortium, conçue pour optimiser le transfert de données au sein des réseaux d’IA back-end pour la communication GPU à GPU, réduit la complexité du réglage des performances et contribue à améliorer le délai de production.

AMD continue également d’améliorer sa pile logicielle ROCm : ROCm 6.2 prend désormais en charge des fonctionnalités d’IA critiques telles que le type de données FP8, Flash Attention 3, Kernel Fusion, doublant les performances d’inférence et d’entraînement des LLM sur les accélérateurs AMD Instinct. Aujourd’hui, plus d’un million de modèles IA fonctionnent sur l’architecture AMD, avec une compatibilité sans faille pour les modèles les plus populaires, dont ChatGPT d’OpenAI et Llama de Meta ou les modèles open source de la plateforme Hugging Face.

Lors de l’événement, AMD s’est entouré de partenaires technologiques de premier plan tels que Dell, Google Cloud, HPE, Lenovo, Meta, Microsoft, Oracle Cloud Infrastructure, ainsi que des leaders de l’IA comme Databricks, OpenAI, Cohere, Essential AI, Fireworks AI, Luma AI, et Reka AI pour présenter ses solutions .

Google Cloud et Oracle Cloud Infrastructure ont quant à eux détaillé comment ils exploitent les processeurs EPYC et les accélérateurs Instinct pour développer des capacités de calcul intensif et d’IA générative, tandis que Microsoft a souligné sa collaboration avec AMD pour améliorer les performances de ses infrastructures Azure et GPT grâce aux futurs accélérateurs Instinct MI350.

Lisa Su, PDG d’AMD, affirme :

« Le centre de données et l’IA représentent des opportunités de croissance importantes pour AMD, et nous construisons une forte dynamique pour nos processeurs EPYC et AMD Instinct auprès d’un nombre croissant de clients.

Avec nos nouveaux processeurs EPYC, nos GPU AMD Instinct et nos DPU Pensendo, nous fournissons un calcul de pointe pour alimenter les charges de travail les plus importantes et les plus exigeantes de nos clients. À l’avenir, nous prévoyons que le marché des accélérateurs d’IA pour centres de données atteindra 500 milliards de dollars d’ici 2028. Nous nous engageons à fournir une innovation ouverte à grande échelle grâce à nos solutions étendues de silicium, de logiciels, de réseau et de cluster ».

La création de démonstrateurs faisant usage d’une IA frugale dans des secteurs-clés pour atteindre les objectifs climatiques, tels que les villes durables, les bâtiments intelligents, la mobilité et l’agriculture de précision, est au cœur de la seconde phase de la Stratégie nationale en intelligence artificielle (SNIA) à l’horizon 2025. Le projet IA Eco-Pilot porté par Advizeo, expert en Energy Management, la Métropole du Grand Paris et Tilt, société spécialisée dans la gestion de la flexibilité énergétique, figure parmi les lauréats de la deuxième vague de l’AAP DIAT consacré à ces démonstrateurs.

Piloté par le Secrétariat général pour l’investissement et opéré par la Banque des Territoires, l’AAP DIAT a la particularité de réunir deux stratégies d’accélération : “Ville durable et bâtiments innovants” et “IA”. Son objectif est de soutenir des projets structurants qui démontrent l’efficacité de technologies basées sur l’IA et la science des données, faisant usage d’une IA frugale en énergie et/ou en données, en les validant dans des environnements réels.

L’AAP DIAT s’adresse aux collectivités territoriales ou à leur regroupement (syndicat, GIP) et aux établissements publics locaux. Ceux-ci avaient la possibilité de former un consortium avec des acteurs publics ou privés, chargés de la conception, de la réalisation, et de la gestion de tout ou partie des composantes du projet.

La Métropole du Grand Paris s’est donc associée à Advizeo et Tilt pour le projet IA Eco-Pilot dont l’objectif est d’automatiser la gestion et le suivi énergétique des bâtiments à distance. Il permettra ainsi aux collectivités de la Métropole de réduire substantiellement la consommation énergétique des bâtiments, notamment en intégrant des mécanismes de flexibilité électrique.

Le projet sera divisé en deux briques d’IA, l’une conçue pour aider les gestionnaires d’énergie à surveiller et optimiser la consommation énergétique des bâtiments, la seconde pour permettre aux bâtiments de s’autoréguler.

La première s’appliquera à un parc de plus de 7000 bâtiments répartis sur 54 collectivités. L’IA va préconiser des réglages sur les équipements et des actions de rénovation énergétique, adaptés à la typologie des bâtiments et à leur usage, facilitant ainsi la prise de décision des gestionnaires d’énergie ainsi que l’atteinte des objectifs du Dispositif Éco-Énergie Tertiaire (DEET) qui impose une réduction progressive de la consommation d’énergie dans les bâtiments à usage tertiaire afin de lutter contre le changement climatique.

La seconde brique d’IA du projet sera expérimentée sur un groupe plus restreint de douze bâtiments répartis dans six collectivités pilotes. Cette phase se concentrera sur l’autorégulation des équipements CVC (chauffage, ventilation, climatisation), à l’aide d’un contrôle prédictif prenant en compte des variables telles que la météo, l’usage et les caractéristiques des bâtiments. L’intégration de la flexibilité électrique permettra d’ajuster les usages énergétiques en fonction de la demande sur le réseau, offrant ainsi une gestion plus souple et optimisée.

Les collectivités territoriales jouent un rôle clé dans la transition énergétique et écologique, car elles sont directement responsables d’environ 15 % des émissions de gaz à effet de serre à travers leurs infrastructures et leurs services (bâtiments publics, gestion des déchets, transports, etc.). En utilisant des solutions telles qu’IA Eco-Pilot, elles pourront non seulement mieux respecter les nouvelles réglementations, mais aussi contribuer activement à la réduction des émissions de CO2 à l’échelle nationale.

Si les tests sont concluants, ce démonstrateur pourrait être déployé à plus grande échelle dans les années à venir, ouvrant la voie à une gestion énergétique optimisée dans les territoires, en ligne avec les objectifs de France 2030.

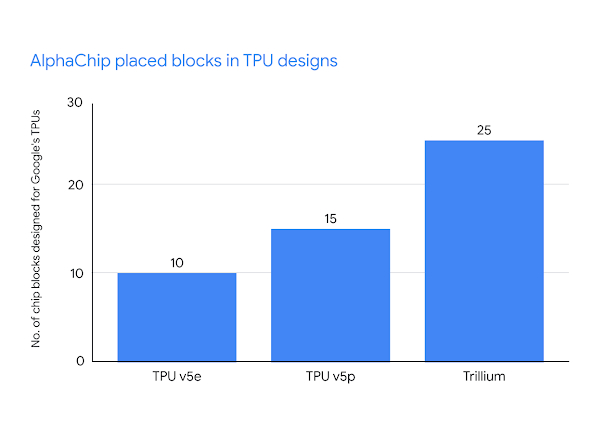

L’évolution rapide de l’IA a ouvert la voie à des avancées impressionnantes dans le domaine de la conception des puces électroniques, l’approche développée par Google DeepMind en est un exemple concret. Lancée en 2020, désormais baptisée AlphaChip, elle utilise l’apprentissage par renforcement pour optimiser la disposition des composants des puces, réduisant le temps de conception de quelques mois à seulement quelques heures. DeepMind a partagé la semaine dernière sur son blog des détails supplémentaires sur ce framework open source.

AlphaChip aborde la conception des puces comme un jeu. À partir d’une grille vide, l’IA place les composants des circuits un par un, tout en respectant les contraintes de conception complexes telles que les connexions entre les composants et l’optimisation de l’espace. À chaque disposition générée, le modèle apprend et s’améliore, ce qui permet de produire des puces de plus en plus performantes. L’utilisation d’un réseau neuronal spécialisé, un graphe basé sur les bords, aide AlphaChip à comprendre les relations entre les différents blocs de puces, améliorant ainsi la qualité et la rapidité des conceptions.

Selon Deepmind, “ses dispositions sont utilisées dans les puces du monde entier, des centres de données aux téléphones mobiles”.

Depuis sa publication en 2020, il a été utilisé pour concevoir plusieurs générations des unités de traitement tensoriel (TPU), introduites en 2016 par Google Cloud pour accélérer les tâches d’IA, qui font fonctionner aujourd’hui les LLM de Google comme Gemini.

AlphaChip a non seulement optimisé la disposition des composants des TPU, rendant chaque génération plus performante que la précédente, mais a également fourni à chacune d’elle, une plus grande partie de l’ensemble de l’étage, accélérant le cycle de conception.

Crédit image : Google. Graphique à barres montrant le nombre de blocs de puces conçus par AlphaChip sur trois générations d’unités de traitement tensoriel (TPU) de Google : v5e, v5p et Trillium.

Crédit image : Google. Graphique à barres montrant le nombre de blocs de puces conçus par AlphaChip sur trois générations d’unités de traitement tensoriel (TPU) de Google : v5e, v5p et Trillium.Des entreprises comme MediaTek utilisent également AlphaChip pour concevoir des puces comme la série Dimensity 5G, utilisée dans les smartphones de pointe, ce qui lui a permis d’améliorer à la fois les performances et l’efficacité énergétique de ses puces.

Aujourd’hui, AlphaChip optimise non seulement la disposition des puces, mais aussi d’autres étapes du cycle de conception, comme la synthèse logique et l’optimisation des timings. Il pourrait dans le futur transformer radicalement la conception des puces pour des appareils aussi variés que les smartphones, les capteurs agricoles ou encore les équipements médicaux, en améliorant chaque étape du cycle.

DeepMind conclut :

“Les futures versions d’AlphaChip sont en cours de développement et nous sommes impatients de travailler avec la communauté pour continuer à révolutionner ce domaine et créer un avenir dans lequel les puces sont encore plus rapides, moins chères et plus économes en énergie”.

L’Assistance Publique-Hôpitaux de Paris (AP-HP), premier centre hospitalier universitaire d’Europe, et Owkin, licorne franco-américaine spécialisée en biotechnologie, annoncent une reconduction pour 5 ans de leur partenariat. Ce renouvellement stratégique vise à renforcer l’utilisation de l’IA et des données de santé pour la découverte de nouvelles thérapies, en particulier dans les domaines de l’oncologie, de l’immunologie et de la cardiologie, ainsi qu’à améliorer la prise en charge des patients.

Cofondée en 2016 par Thomas Clozel, chercheur clinicien et ancien professeur adjoint en hématologie clinique, et Gilles Wainrib, docteur en IA appliquée à la biologie, Owkin s’est donnée pour mission d’utiliser l’IA afin de découvrir et de développer de meilleurs traitements pour les besoins médicaux non satisfaits, à commencer par la lutte contre le cancer.

Spécialisée dans l’IA et dans l’apprentissage fédéré appliqué à la recherche médicale, elle collabore avec de nombreux centres hospitaliers, dont l’AP-HP.

Depuis le début de leur collaboration en 2019, l’AP-HP et Owkin ont réalisé des avancées majeures dans la recherche médicale, avec plus de vingt projets de recherche, dont plusieurs ont conduit à des publications scientifiques.

L’hôpital Bicêtre de l’AP-HP, pilote en pathologie numérique, a fait figure de pionnier en testant Dx RlapsRisk BC, une solution d’Owkin, développée en collaboration avec l’Institut Gustave Roussy, qui a reçu en 2022 la certification CE-IVD (CE Marking for In Vitro Diagnostic).

RlapsRisk BC est une solution de pronostic basée sur l’IA conçue pour prédire la probabilité pour une personne atteinte d’un cancer du sein précoce de rechuter après le traitement, permettant ainsi aux oncologues de déterminer quelles patientes à haut risque peuvent bénéficier de thérapies ciblées et quelles patientes à faible risque peuvent potentiellement éviter la chimiothérapie. Le projet pilote, mené par la Pr Catherine Guettier, a permis de fournir des retours d’expérience à Owkin pour le développement de sa solution.

Dans le cadre de leur premier partenariat, AP-HP et Owkin ont également développé PACpAInt, un modèle de deep learning permettant de prédire les sous-types génomiques de l’adénocarcinome pancréatique, la tumeur la plus fréquente chez les patients atteints du cancer du pancréas, un cancer dont le taux de survie est l’un des plus faibles, mais évolue positivement ces dernières années grâce à la recherche médicale, un dépistage précoce et des thérapies ciblées.

Cet outil, qui a été développé en utilisant les ressources histologiques et moléculaires uniques de quatre hôpitaux du réseau AP-HP (Amboise Paré, Beaujon, Pitié Salpétrière, Saint Antoine), a fait l’objet d’une publication dans Nature Communications, en juin 2023.

L’AP-HP collabore également avec Owkin et Sorbonne Université dans le cadre du projet RHU AI-Triomph pour optimiser les essais cliniques en oncologie grâce à l’IA et une approche multimodale. Ce projet, dirigé par la Pr Magali Svrcek et le Pr Jean-Baptiste Bachet, se concentre sur les adénocarcinomes canalaires du pancréas et de l’œsophage, ainsi que sur les cancers de la thyroïde réfractaires à l’iode radioactif. L’objectif est de développer un système d’IA pour améliorer les traitements personnalisés, optimiser les essais cliniques et créer un “cancer intelligence hub” associé à l’AP-HP.

Le renouvellement de ce partenariat permettra d’étendre l’utilisation de l’IA à d’autres domaines médicaux, tout en continuant de s’appuyer sur l’entrepôt de données de santé (EDS) de l’AP-HP, qui rassemble les informations de 14 millions de patients. Ces données précieuses, combinées aux capacités d’IA avancées d’Owkin, ouvrent la voie à des innovations de rupture dans la recherche et le développement de nouvelles thérapies.

Nicolas Revel, directeur général de l’AP-HP, commente :

“Le renouvellement du partenariat entre Owkin et l’AP-HP est la reconnaissance partagée du succès du partenariat conclu il y a cinq ans. Il permet aux équipes hospitalières de mener des projets collaboratifs d’excellence dans le domaine de l’IA, en s’appuyant notamment sur l’exploitation de l’entrepôt de données de santé de l’AP-HP. La poursuite de cette collaboration vise à approfondir les avancées technologiques, à étendre les domaines d’application clinique et à augmenter le nombre de projets portés conjointement. La collaboration entre l’AP-HP et Owkin s’inscrit, à ce titre, en cohérence avec la politique de recherche partenariale de l’AP-HP, labellisée Institut Carnot”.

Thomas Clozel, PDG d’Owkin, ajoute :

“Le renouvellement de cette collaboration marque une étape clé dans l’évolution de nos solutions d’IA et témoigne de la confiance que l’AP-HP, institution de référence, accorde à nos innovations. Grâce à l’IA et au potentiel d’innovation de l’AP-HP, nous entendons accroître nos partenariats industriels et développer de nouvelles thérapies et de nouveaux outils diagnostics au service des patients. En partenariat avec l’AP-HP, nous intégrons l’expertise des cliniciens et chercheurs à chaque phase du développement de nos technologies, toujours au service des patients. Cette synergie renforce notre engagement à concevoir des solutions robustes et performantes, enrichies par l’apport inestimable de l’AP-HP, comme les données multimodales des patients”.

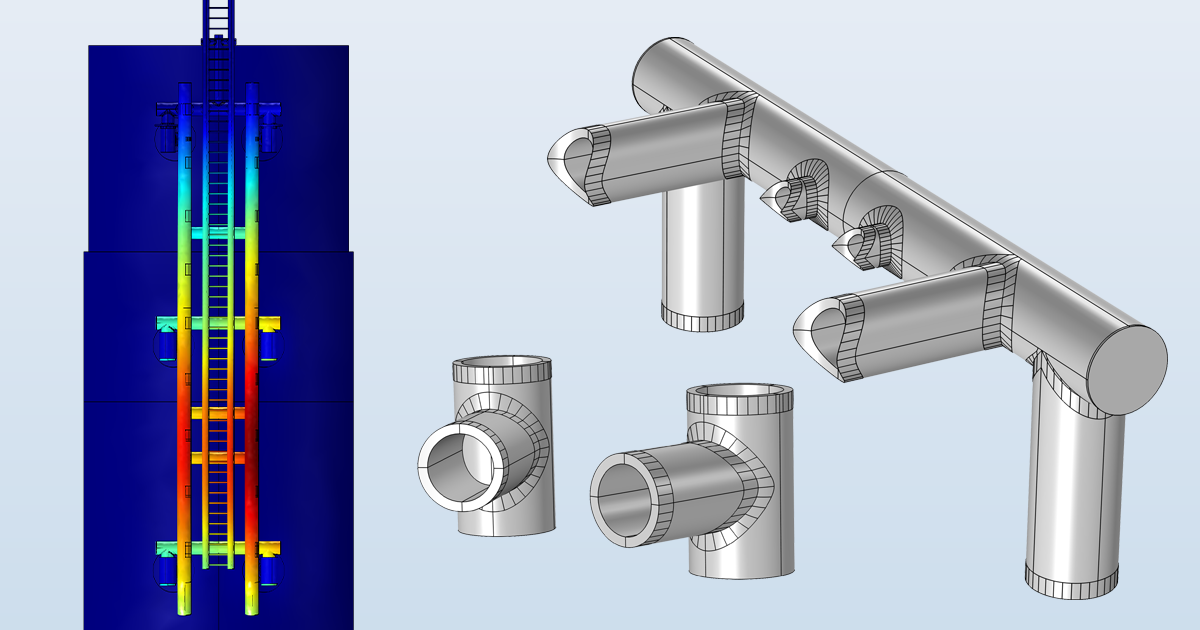

L’éditeur de logiciels Dassault Systems annonce avoir signé le Pacte sur l’IA, une initiative de la Commission européenne visant à encourager les entreprises à utiliser l’IA de manière éthique et responsable. Il rejoint ainsi la centaine d’entreprises qui se sont engagées volontairement à commencer à appliquer les principes de l’AI Act qui est entré en vigueur le 1 août dernier, mais ne sera pas pleinement applicable avant deux ans.

Plus de cent multinationales et PME européennes de divers secteurs, dont l’informatique, les télécommunications, les soins de santé, les banques, l’automobile et l’aéronautique, ont d’ores et déjà signé ce pacte. Parmi les signataires figurent Amazon, IBM, Google, Microsoft, Open AI.

Le pacte sur l’IA n’est pas contraignant, elles se sont engagées volontairement à adopter une stratégie de gouvernance portant sur l’utilisation de l’IA au sein de leur organisation, à créer un registre des systèmes d’IA dignes de confiance qu’elles déploient dans les secteurs à haut risque, et à former leurs employés à l’utilisation responsable de cette technologie.

Plus de la moitié des signataires ont pris des engagements supplémentaires, incluant des mesures telles que la surveillance humaine des systèmes d’IA, la réduction des risques, ainsi que l’étiquetage clair et transparent de certains types de contenus générés par l’IA, comme les vidéos truquées ultra-réalistes.

En signant ce pacte, Dassault Systèmes démontre son engagement à jouer un rôle proactif dans la manière dont l’IA est utilisée pour stimuler l’innovation dans l’industrie au bénéfice des citoyens, des patients et des consommateurs.

Pascal Daloz, son directeur général, affirme :

“Depuis 40 ans, nous travaillons avec nos clients pour créer une représentation scientifique du monde qui combine intelligence artificielle, modélisation et simulation dans le cadre d’expériences de jumeaux virtuels. Cette collaboration a permis des avancées majeures dans le domaine de l’innovation industrielle durable tout en protégeant l’atout concurrentiel le plus puissant dont disposent nos clients : la propriété intellectuelle.”

Ajoutant :

“En rejoignant le Pacte sur l’IA, nous nous engageons à jouer un rôle de catalyseur dans l’utilisation responsable de l’intelligence artificielle dans l’optique d’ouvrir des opportunités d’innovation dans l’économie générative. En tant que partenaire de confiance d’entreprises qui affichent un niveau d’engagement tout aussi élevé, nous serons le fer de lance d’un effort collectif visant à garantir que l’utilisation de l’IA en Europe profitera aux citoyens, aux patients et aux consommateurs.”

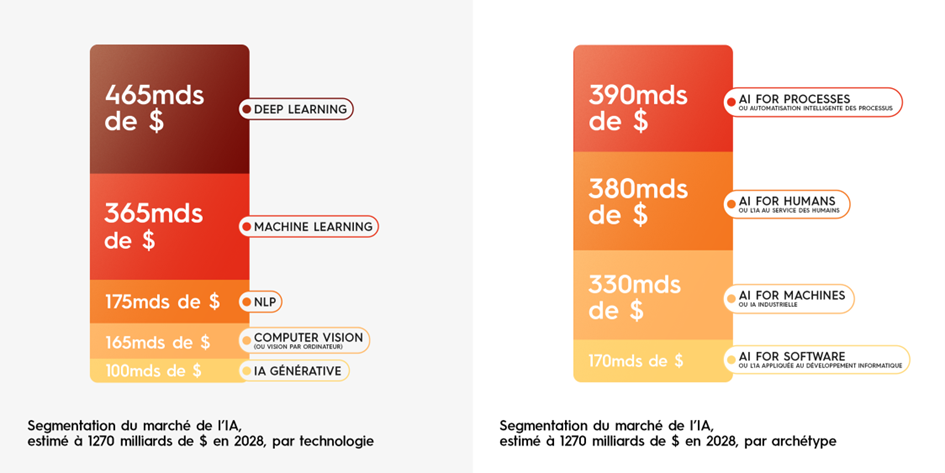

Alors que l’IA redéfinit les paradigmes d’entreprise, Sopra Steria Next, le cabinet de conseil du groupe Sopra Steria, présente une nouvelle étude qui restructure les approches du marché de l’IA. Anticipant un doublement de la taille du marché mondial d’ici 2028, cette étude propose une méthode innovante basée sur l’usage, plutôt que sur la technologie seule, pour aider les dirigeants à mieux piloter leur stratégie opérationnelle et leurs investissements.

Traditionnellement, l’analyse du marché de l’IA s’est concentrée sur les aspects technologiques. Cependant, Sopra Steria Next, ayant constaté que cette approche n’était pas toujours pertinente pour la prise de décision des dirigeants d’entreprise, leur propose une grille d’analyse innovante, catégorisant l’IA en 4 grands types d’application concrète, ou “archétypes” : AI for Machine, AI for Process, AI for Human et AI for Software.