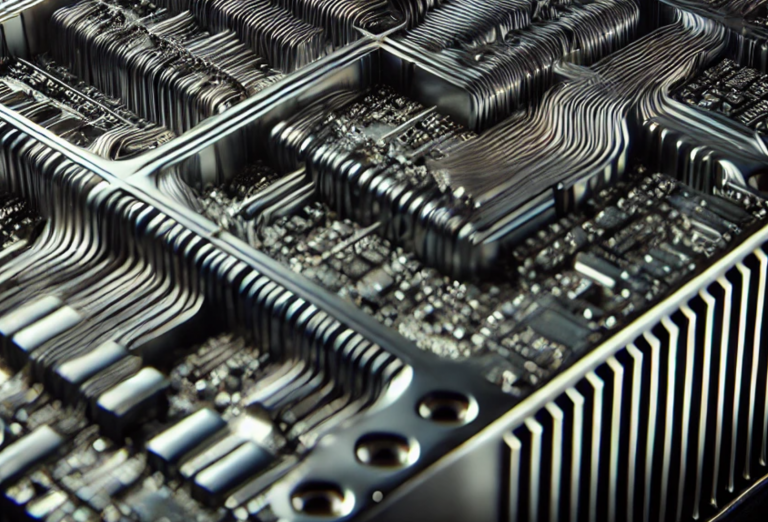

InstaDeep, l’un des leaders mondiaux de l’IA décisionnelle, a annoncé hier le lancement de Kyber, un supercalculateur de nouvelle génération conçu pour répondre aux besoins croissants en calcul haute performance (HPC). Installée dans le data center Equinix de Saint-Denis, cette infrastructure, qui représente un investissement de plusieurs millions d’euros, décuple les capacités de calcul d’InstaDeep. Avec une capacité avoisinant 0,5 exaFLOP en FP16, Kyber s’inscrit parmi les 100 clusters IA les plus puissants au monde et figure dans le top 20 des clusters équipés de GPU NVIDIA H100.

Une infrastructure de pointe pour gérer des défis complexes

Conçu pour traiter des calculs extrêmement complexes, Kyber permettra de relever des défis critiques dans des domaines tels que la bio-informatique, les sciences de la vie, l’optimisation industrielle et la recherche avancée en IA. En associant cette puissance exceptionnelle à ses algorithmes innovants, InstaDeep ambitionne de transformer la prise de décision à grande échelle et la modélisation de systèmes complexes.

Karim Beguir, CEO et cofondateur d’InstaDeep, assure :

“Kyber représente une avancée transformative pour InstaDeep. Nous avons désormais la capacité d’accélérer les percées en IA et de concrétiser nos objectifs d’innovation au bénéfice de nos clients. Cet investissement souligne aussi l’importance clé de la France pour InstaDeep. Notre bureau de Paris, qui compte plus de 130 ingénieurs et chercheurs en IA, joue un rôle clé dans le développement de nos capacités dans la région. Héberger Kyber dans un centre de données français confirme notre engagement à stimuler l’innovation et la croissance en Europe.”

La France, un choix stratégique et souverain

La localisation de Kyber en région parisienne reflète une double ambition : optimiser les coûts énergétiques tout en garantissant la souveraineté des données. En construisant et en gérant ce cluster en interne, InstaDeep conserve une indépendance totale sur son infrastructure, lui permettant d’adapter les logiciels aux besoins spécifiques des utilisateurs tout en maîtrisant les coûts.

Nacef Labidi, Responsable de l’Infrastructure chez InstaDeep, souligne :

“Dès le départ, InstaDeep a pris la décision stratégique de construire et de gérer son propre cluster de supercalcul. Cette approche, rendue possible par notre expertise en calcul haute performance (HPC), garantit notre indépendance en matière d’accès à une puissance de calcul essentielle pour les workflows IA.”

Un rôle clé pour l’innovation en Europe

L’investissement dans Kyber illustre l’engagement d’InstaDeep en faveur de la recherche et de l’innovation en France et en Europe. En combinant des chercheurs, des bases de données robustes et une puissance de calcul sans précédent, InstaDeep se positionne comme un acteur clé des transformations industrielles et scientifiques. L’entreprise ambitionne également d’utiliser ses avancées pour répondre à des défis mondiaux, notamment en matière de durabilité et de résilience climatique.

Depuis sa création, il y a dix ans, InstaDeep a mis ses technologies au service de solutions à fort impact, telles que la plateforme InstaGeo, un cadre open source d’apprentissage automatique géospatial, qui sera notamment utilisé par les participants du GeoAI Hack qu’il coorganise avec datacraft la semaine prochaine. Avec Kyber, l’entreprise franchit un nouveau cap dans son ambition de repousser les limites de l’IA pour des industries à fort impact, tout en renforçant la souveraineté technologique européenne et en consolidant sa position de leader sur le marché de l’IA décisionnelle au côté des grands acteurs américains.