Vue normale

-

IA

-

AMD, Google, Qualcomm… Dans les puces pour l’intelligence artificielle, la concurrence à Nvidia émerge (lentement)

Plus de 80% de parts de marché sur les puces pour l’IA, et même 94% pour les seules GPU (puces graphiques) selon le cabinet d’analyse Jon...

-

Intelligence artificielle

-

IA : Humain, la start-up d'Etat saoudienne qui fricote avec AMD, AWS et Nvidia

Cette semaine, le président américain Donald Trump était en tournée pour caresser dans le sens du poil l'Arabie Saoudite. Il n'est évidemment...

IA : Humain, la start-up d'Etat saoudienne qui fricote avec AMD, AWS et Nvidia

-

Intelligence artificielle

-

Microsoft lance un ordinateur et une tablette Surface d'entrée de gamme avec des outils d'IA

Voilà deux nouveaux arrivants sur le marché des tablettes et des ordinateurs portables qui pourraient doper les ventes de Microsoft. Le mardi 6...

Microsoft lance un ordinateur et une tablette Surface d'entrée de gamme avec des outils d'IA

-

LEBIGDATA.FR

-

Microsoft va vous permettre d’utiliser l’IA DeepSeek sur votre laptop ! Voici comment

Saviez-vous que Microsoft collabore avec DeepSeek ? Cette alliance rend l’intelligence artificielle plus accessible, même sur votre ordinateur portable. Microsoft annonce officiellement son soutien au modèle DeepSeek via sa plateforme cloud Azure et son outil GitHub. Une initiative qui dépasse les limites du cloud traditionnel. Cette collaboration intervient quelques semaines seulement après une action légale engagée contre l’entreprise chinoise. Microsoft adapte DeepSeek à ses technolog

Microsoft va vous permettre d’utiliser l’IA DeepSeek sur votre laptop ! Voici comment

Saviez-vous que Microsoft collabore avec DeepSeek ? Cette alliance rend l’intelligence artificielle plus accessible, même sur votre ordinateur portable.

Microsoft annonce officiellement son soutien au modèle DeepSeek via sa plateforme cloud Azure et son outil GitHub. Une initiative qui dépasse les limites du cloud traditionnel. Cette collaboration intervient quelques semaines seulement après une action légale engagée contre l’entreprise chinoise.

Microsoft adapte DeepSeek à ses technologies

Grâce à cette collaboration, exécuter le modèle DeepSeek R1 directement sur un PC Windows 11 Copilot+ est désormais possible. Pour ce faire, ces machines doivent répondre à des critères techniques spécifiques : au moins 256 Go de stockage, 16 Go de RAM et une NPU capable de délivrer 40 TOPS. Ces exigences garantissent une performance optimale tout en restant opérationnelles pour beaucoup.

Pour toucher un public encore plus large, Microsoft prépare plusieurs versions du modèle. Les premières ciblent les appareils Qualcomm Snapdragon X, puis les PC Intel Lunar Lake, avant d’étendre la compatibilité aux processeurs AMD Ryzen AI 9.

Un enrichissement concret pour les développeurs

Dans sa démarche, Microsoft ajoute également des modèles clés à son AI Toolkit. Parmi eux figurent le DeepSeek-R1-Distill-Qwen-1.5B, ainsi que des variantes de 7 milliards et 14 milliards de paramètres. Ces outils offrent aux créateurs une flexibilité accrue pour concevoir leurs projets sans se noyer dans la complexité technique. Cependant, certains PC équipés de NPUs plus anciennes ne pourront pas exécuter ces modèles localement, selon Windows Center.

Microsoft diversifie ses sources technologiques grâce à DeepSeek

Cette collaboration entre Microsoft et DeepSeek s’inscrit aussi dans une volonté de réduire la dépendance vis-à-vis d’OpenAI. En intégrant davantage de modèles tiers, comme celui de DeepSeek, Microsoft diversifie ses options pour alimenter son produit phare, Microsoft 365 Copilot. Cette approche répond aux besoins croissants des utilisateurs tout en minimisant les risques liés à une seule source technologique.

Des questions juridiques planent autour de DeepSeek

Malgré cet enthousiasme, des défis subsistent. Selon Reuters, certains experts suspectent DeepSeek d’avoir utilisé des pratiques illégales pour entraîner ses modèles. Par exemple, il est possible que l’entreprise ait recours à la distillation, une méthode où un modèle apprend auprès d’un autre. Ce processus pourrait poser problème dans un contexte où la propriété intellectuelle est surveillée de près.

Un responsable de la Maison-Blanche a également évoqué ces inquiétudes, affirmant qu’il était « possible que DeepSeek ait volé des droits intellectuels aux États-Unis ». En parallèle, le fait que DeepSeek héberge ses serveurs en Chine pourrait refroidir certains utilisateurs américains.

Cet article Microsoft va vous permettre d’utiliser l’IA DeepSeek sur votre laptop ! Voici comment a été publié sur LEBIGDATA.FR.

-

Intelligence artificielle

-

CES 2025 : PC IA, ordinateur déroulant, console Legion Go S… Les principales annonces de Lenovo

À l'occasion du CES 2025, qui se tient jusqu'au 10 janvier à Las Vegas, le constructeur chinois d'électronique Lenovo a dévoilé de nombreux...

CES 2025 : PC IA, ordinateur déroulant, console Legion Go S… Les principales annonces de Lenovo

-

ActuIA

-

Mistral AI et Qualcomm collaborent pour intégrer les Ministraux aux appareils en périphérie

Lors de son évènement annuel Snapdragon Summit, Qualcomm Technologies a annoncé une collaboration stratégique avec Mistral AI, visant à apporter les derniers modèles de pointe présentés il y a deux semaines par la licorne : Ministral 3B et Ministral 8B, directement sur les appareils alimentés par les plateformes Snapdragon. Exécuter l’IA directement sur l’appareil offre des bénéfices importants : une meilleure confidentialité, une latence réduite, une fiabilité accrue, des économies de coûts, et

Mistral AI et Qualcomm collaborent pour intégrer les Ministraux aux appareils en périphérie

Lors de son évènement annuel Snapdragon Summit, Qualcomm Technologies a annoncé une collaboration stratégique avec Mistral AI, visant à apporter les derniers modèles de pointe présentés il y a deux semaines par la licorne : Ministral 3B et Ministral 8B, directement sur les appareils alimentés par les plateformes Snapdragon.

Exécuter l’IA directement sur l’appareil offre des bénéfices importants : une meilleure confidentialité, une latence réduite, une fiabilité accrue, des économies de coûts, et une plus grande efficacité énergétique.

Les Ministraux, conçus pour être exécutés sur des appareils périphériques, tels que les smartphones et les ordinateurs portables, ou les systèmes embarqués des véhicules, offrent des performances inédites dans la catégorie des modèles IA de moins de 10 milliards de paramètres.

Intégration sur les plateformes Snapdragon

Ce partenariat stratégique permettra à Ministral 3B et Ministral 8B d’opérer sur les plateformes présentées par Qualcomm lors de l’évènement : Snapdragon 8 Elite, pour les appareils mobiles, Snapdragon Cockpit Elite, destinée aux systèmes d’infodivertissement embarqués dans les véhicules et Snapdragon Ride Elite, conçue pour les systèmes de conduite autonome et les systèmes avancés d’assistance à la conduite (ADAS). Les deux modèles seront également intégrés à la plateforme de calcul Snapdragon X Elite, destinée aux ordinateurs portables et tablettes, dotée de capacités d’IA avancée.

Durga Malladi, vice-présidente principale et directrice générale de la technologie, de la planification et des solutions de périphérie chez Qualcomm, souligne :

“Les Ministral 3B et Ministral 8B de Mistral AI permettront aux fabricants d’appareils, aux fournisseurs de logiciels et aux fournisseurs de services numériques d’offrir des expériences innovantes, telles que des assistants d’IA et d’autres applications qui comprennent les désirs et les besoins des utilisateurs, grâce à l’immédiateté, à la fiabilité et à la confidentialité accrue de l’IA sur l’appareil”.

Les modèles de Mistral AI seront accessibles via le Qualcomm AI Hub, une plateforme conçue pour centraliser et faciliter l’accès aux outils et modèles d’IA destinés aux développeurs, leur permettant de créer des solutions IA de bout en bout pour des applications mobiles, informatiques, automobiles et IoT.

Deux modèles de Mistral AI, Mistral 7B v0.3 et Mistral 3B, optimisés pour Qualcomm, y sont déjà disponibles. Cette nouvelle collaboration permettra à Ministral 3B et Ministral 8B de les rejoindre prochainement.

Arthur Mensch, cofondateur et PDG de Mistral AI, commente :

“Cette collaboration avec Qualcomm Technologies est une étape importante pour Mistral AI, démontrant la capacité de nos nouveaux modèles à fonctionner localement sur des appareils alimentés par des plates-formes Snapdragon, ce qui se traduit par un traitement local plus rapide qui peut aider à réduire les coûts et les demandes d’énergie”.

Il conclut :

“Ensemble, nous démocratisons l’accès à l’IA avancée, en permettant aux développeurs et aux utilisateurs du monde entier de découvrir le plein potentiel de nos modèles directement sur leurs appareils”.

-

Intelligence artificielle

-

IA générative : Qualcomm s'allie à Mistral AI pour embarquer ses LLM dans les smartphones, PC et voitures

Profitant de sa conférence Snapdragon Summit qui se tient cette semaine à Hawaï, Qualcomm a annoncé la signature d'un partenariat avec Mistral...

IA générative : Qualcomm s'allie à Mistral AI pour embarquer ses LLM dans les smartphones, PC et voitures

-

Intelligence artificielle

-

Qualcomm accélère dans l'automobile connectée avec deux nouvelles plateformes

Qualcomm a annoncé le 22 octobre deux nouvelles générations de plateformes pour sa gamme de solutions dédiées à l'automobile connectée "Digital...

Qualcomm accélère dans l'automobile connectée avec deux nouvelles plateformes

-

Intelligence artificielle

-

Avec le Snapdragon 8 Elite, Qualcomm veut surpasser les performances de l'iPhone

À l’occasion de sa conférence annuelle, qui se tient à Hawaï, Qualcomm lève le voile ce 21 octobre sur sa dernière puce pour smartphones...

Avec le Snapdragon 8 Elite, Qualcomm veut surpasser les performances de l'iPhone

-

LEBIGDATA.FR

-

Meta lance Llama 3.2, sa 1ère IA multimodale… mais on a une mauvaise nouvelle

Llama 3.2 peut traiter à la fois des images et du texte. Elle a pour ambition de rivaliser avec les modèles des géants de la technologie d’intelligence artificielle comme OpenAI et Anthropic. Après un peu plus de deux mois de la sortie de la première version du Llama 3.2, Meta lance un nouveau grand modèle d’IA avec une importante mise à jour. En effet, cette entreprise vient de lancer son premier modèle open source capable de traiter du texte et des images. Découvrez ici les détails sur cett

Meta lance Llama 3.2, sa 1ère IA multimodale… mais on a une mauvaise nouvelle

Llama 3.2 peut traiter à la fois des images et du texte. Elle a pour ambition de rivaliser avec les modèles des géants de la technologie d’intelligence artificielle comme OpenAI et Anthropic.

Après un peu plus de deux mois de la sortie de la première version du Llama 3.2, Meta lance un nouveau grand modèle d’IA avec une importante mise à jour. En effet, cette entreprise vient de lancer son premier modèle open source capable de traiter du texte et des images. Découvrez ici les détails sur cette IA révolutionnaire de Meta.

Llama 3.2, la première IA multimodale de Meta

« Il s’agit de notre premier modèle multimodal open source », a exprimé Mark Zuckerberg, PDG de Meta, lors de son discours d’ouverture. « Il va permettre de nombreuses applications qui nécessitent une compréhension visuelle. »

Rappelons que Google et OpenAI possèdent aussi des modèles d’IA multimodaux qu’elles ont lancés l’année dernière. Apparemment, Meta rattrape son retard avec le lancement de Llama 3.2. Malgré ce retard, Meta semble vouloir apporter de nombreuses nouveautés avec ce nouveau modèle.

À l’instar de son prédécesseur, cette nouvelle version de Llama possède une longueur de contexte de 128 000 jetons. Plus précisément, les utilisateurs pourront saisir de nombreux textes, l’équivalent d’une échelle de centaines de pages d’un manuel.

Par ailleurs, Llama 3.2 propose désormais des modèles plus précis grâce à des paramètres plus élevés. De plus, ils sont capables de gérer des tâches plus complexes. En outre, ce qui différencie ce modèle est la prise en charge de la vision alors que Meta travaille toujours sur le développement des capacités d’IA sur du matériel comme ses lunettes Ray-Ban Meta.

Un rival de taille de Claude et de GPT-4o ?

Depuis le lancement de Llama 3.1, Meta atteste que le modèle a réussi à effectuer une croissance de 10X. « Llama continue de s’améliorer rapidement », affirme Zuckerberg. « Il offre de plus en plus de fonctionnalités. »

Llama 3.2, par ailleurs est doté de deux modèles de vision (avec 11 milliards de paramètres et 90 milliards de paramètres) ainsi que deux modèles légers entièrement textuels (avec 1 milliards de paramètres et 3 milliards de paramètres).

Les plus grands modèles peuvent prendre en charge les cas d’utilisation d’images. Ils peuvent aussi comprendre les graphiques et les diagrammes. Par ailleurs, ils sont capables de sous-titrer des images et de reconnaître des objets à partir des descriptions en langage naturel. Enfin, ils peuvent enlever des détails des images pour concevoir des légendes.

Meta releases its first open AI model that can process images: Illustration by Alex Castro / The Verge

— The AI Tech Startups Roundup (@thedailyAi_) September 25, 2024

Just two months after releasing its last big AI model, Meta is back with a major update: its first open-source model capable of… https://t.co/Rdl0vc3hH9 #ai #ainews

Les petits modèles sont développés pour fonctionner sur Qualcomm, MediaTek et d’autres matériels Arm. D’ailleurs, Meta s’attend à ce qu’on les utilise sur mobile. Ces modèles légers peuvent être utilisés lors de la création des applications argentiques personnalisées dans un cadre privé.

Meta affirme que ce nouveau modèle est compétitif avec Claude 3 Haiku d’Anthropic et GPT4o-mini d’OpenAI en ce qui concerne la reconnaissance d’images. Il peut aussi rivaliser avec ces IA sur d’autres tâches de compréhension visuelle.

En parallèle, Llama 3.2 dépasse Gemma et Phi 3.5-mini dans certains domaines comme le suivi des instructions, le résumé, la réécriture des invites ou encore l’utilisation d’outils.

Pour accéder aux modèles Llama3.2, il faut les télécharger via llama.com et Hugging Face ou encore les plateformes associées de Meta. Notons également que malheureusement, ce modèle n’est pas encore disponible en Europe.

Cet article Meta lance Llama 3.2, sa 1ère IA multimodale… mais on a une mauvaise nouvelle a été publié sur LEBIGDATA.FR.

-

Intelligence artificielle

-

Snapdragon X Elite, Lunar Lake, RTX AI Laptops… Les principales annonces du Computex 2024

“La renaissance du PC” : au Computex 2024, qui a lieu cette semaine à Taipei (Taïwan), Qualcomm voit les choses en grand. Son PDG et fondateur,...

Snapdragon X Elite, Lunar Lake, RTX AI Laptops… Les principales annonces du Computex 2024

-

LEBIGDATA.FR

-

AMD dévoile les processeurs Ryzen AI 300, taillés pour l’IA : Quel intérêt pour votre PC ?

C'est pour améliorer votre expérience de l'intelligence que les puces Ryzen AI 300 ont été conçues. Ces nouveaux processeurs rivaliseront avec les Snapdragon X Elite. AMD a profité du salon COMPUTEX pour dévoiler sa nouvelle génération de processeurs pour ordinateurs portables. Les puces de la gamme Ryzen AI 300 intègrent une architecture de cœurs inédite, un NPU amélioré et une partie graphique plus performante. La marque américaine annonce également une compatibilité Copilot+. COMP

AMD dévoile les processeurs Ryzen AI 300, taillés pour l’IA : Quel intérêt pour votre PC ?

C'est pour améliorer votre expérience de l'intelligence que les puces Ryzen AI 300 ont été conçues. Ces nouveaux processeurs rivaliseront avec les Snapdragon X Elite.

AMD a profité du salon COMPUTEX pour dévoiler sa nouvelle génération de processeurs pour ordinateurs portables. Les puces de la gamme Ryzen AI 300 intègrent une architecture de cœurs inédite, un NPU amélioré et une partie graphique plus performante. La marque américaine annonce également une compatibilité Copilot+.

COMPUTEX Taipei fait partie des événements les plus attendus dans le monde de la tech. Le salon a lieu chaque année au Taipei Nangang Exhibition Center à Taïwan.

L'édition 2024 a ouvert ses portes mardi, et celles-ci se refermeront vendredi prochain. Elle va mettre l'accent les dernières tendances en matière de technologies d'intelligence artificielle.

Le lancement de l'événement se fait avec des keynotes organisés pendant les deux ou trois jours avant l'ouverture. AMD a fait sa présentation, dimanche, lors de ces keynotes.

We are excited to work with @HP to bring new levels of performance and AI capabilities to HP systems with AMD Ryzen AI 300 Series processors.

— AMD (@AMD) June 3, 2024

AMD CEO Dr. @LisaSu and @EnriqueJLores, HP President and CEO, discussed how we're co-engineering solutions at Computex 2024. pic.twitter.com/hodXCahVEg

Des processeurs taillés pour les charges d'intelligence artificielle

Cette nouvelle gamme est la promesse de performances améliorées. Elle offre une meilleure gestion de l'intelligence artificielle et des graphismes pour les PC portables.

Ces performances améliorées reposent sur la nouvelle architecture de cœurs Zen 5. Celle-ci apporte un gain de 15 % sur la puissance de traitement, par rapport au Zen 4.

Par ailleurs, les puces Ryzen AI 300 intègrent le nouveau neural processing unit XDNA 2. Ce NPU permet de gérer plus efficacement les tâches liées à l'intelligence artificielle.

Les nouveaux processeurs utilisent le RDNA 3.5 comme nouveau composant graphique. Celui-ci offre des performances graphiques augmentées pour une expérience visuelle plus fluide.

Les deux puces Ryzen AI 300 prévues pour juillet

AMD a ainsi prévu deux processeurs pour lancer son nouveau catalogue Ryzen AI 300. Ceux-ci sont : AI 9 HX 370 et AI 9 365.

La puce Ryzen AI 9 HX 370

- 12 cœurs CPU (4 cœurs Zen 5 + 8 cœurs Zen 5c)

- Fréquence maximale de 5,1 GHz

- iGPU Radeon 890M avec 16 unités de calcul RDNA 3.5

La puce Ryzen AI 9 365

- 10 cœurs CPU (4 cœurs Zen 5 + 6 cœurs Zen 5c)

- Fréquence maximale de 5 GHz

- iGPU Radeon 880M avec 12 unités de calcul RDNA 3.5

Précisons que l'architecture XDNA 2 offre aux deux processeurs 50 TOPS de puissance de traitement. Ils peuvent donc gérer localement des modèles d'IA complexes. De plus, les deux puces sont 10 TOPS au-dessus du seuil minimal de la certification Copilot+ PC.

Concurrents sérieux des Snapdragon X Elite ?

AMD n'hésite pas à comparer ses nouvelles puces aux Snapdragon X Elite de Qualcomm. Rappelons que ces derniers équipent les appareils de la collection Copilot+ PCs.

En termes de puissance de traitement, les processeurs Ryzen sont effectivement supérieurs. Les puces Snapdragon sont 5 TOPS moins performantes.

Par ailleurs, les nouveaux modèles Ryzen sont 5 % plus réactifs d'après le test monocœur de GeekBench. De plus, le benchmark Office de Procyon indique une productivité supérieure de de 10 % pour les produits AMD.

Cinebench 24 donne les puces Ryzen 30 % plus performantes. Et enfin, 3DMark les juge 60 % plus efficaces que les processeurs de Qualcomm pour les jeux.

D'autre part, les premiers appareils équipés des Ryzen AI 300 arriveront fin juillet. Ce seront principalement des ordinateurs portables Lenovo, HP, Acer, Dell, MSI et Asus.

Alors, vous serez plutôt Snapdragon X Elite ou Ryzen AI 300 ?

Cet article AMD dévoile les processeurs Ryzen AI 300, taillés pour l’IA : Quel intérêt pour votre PC ? a été publié sur LEBIGDATA.FR.

-

LEBIGDATA.FR

-

Meta lance l’IA Llama 3 ! Découvrez sa puissance, et le secret pour l’utiliser en France !

Meta hausse le ton dans la guerre de l'IA ! La firme de Mark Zuckerberg lance enfin Llama 3, sa nouvelle IA open source qui s'assoit à la table de OpenAI GPT-4 Turbo, Anthropic Claude 3 Opus et Google Gemini Ultra selon les premiers tests ! Découvrez tout ce qu'il faut savoir sur ce puissant LLM, et sur son chatbot Meta.ai ! Il y a quelques jours, Meta et OpenAI annonçaient chacun de leur côté le lancement imminent de leurs nouvelles IA, beaucoup plus puissantes et capables de raisonner. C

Meta lance l’IA Llama 3 ! Découvrez sa puissance, et le secret pour l’utiliser en France !

Meta hausse le ton dans la guerre de l'IA ! La firme de Mark Zuckerberg lance enfin Llama 3, sa nouvelle IA open source qui s'assoit à la table de OpenAI GPT-4 Turbo, Anthropic Claude 3 Opus et Google Gemini Ultra selon les premiers tests ! Découvrez tout ce qu'il faut savoir sur ce puissant LLM, et sur son chatbot Meta.ai !

Il y a quelques jours, Meta et OpenAI annonçaient chacun de leur côté le lancement imminent de leurs nouvelles IA, beaucoup plus puissantes et capables de raisonner.

C'est désormais chose faite pour l'entreprise de Zuckerberg : la nouvelle IA Llama 3 vient d'être lancée, un peu moins d'un an après la V2 sortie en juillet 2023.

Plus précisément, Llama 3 est une famille de modèles et les deux premiers sont disponibles. On ignore pour l'instant la date de lancement des autres…

Introducing Meta Llama 3: the most capable openly available LLM to date.

— AI at Meta (@AIatMeta) April 18, 2024

Today we're releasing 8B & 70B models that deliver on new capabilities such as improved reasoning and set a new state-of-the-art for models of their sizes.

Today's release includes the first two Llama 3… pic.twitter.com/Q80lVTeS7m

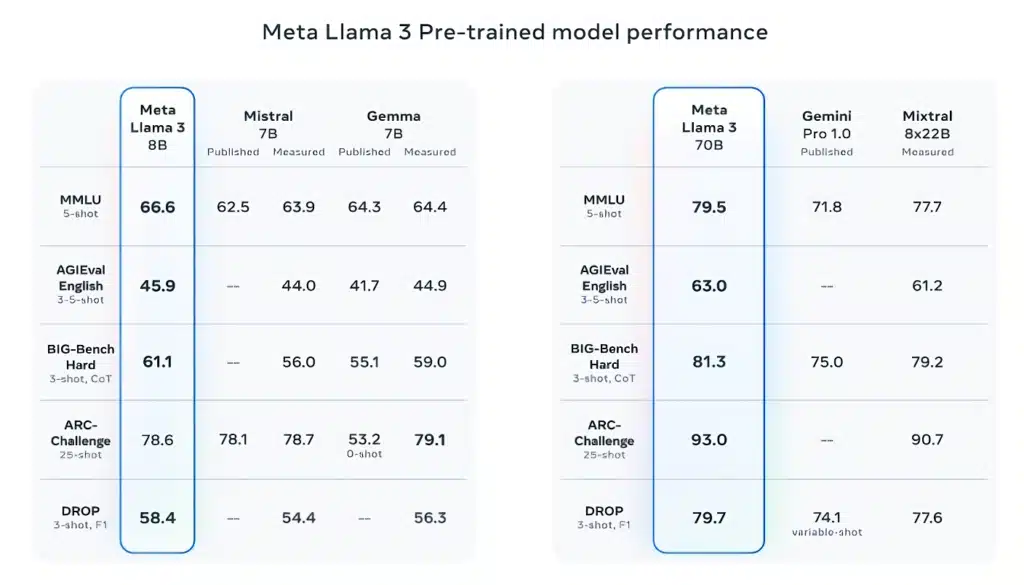

Le premier est Llama 3 8B, avec 8 milliards de paramètres, et Llama 3 70B, avec 70 milliards de paramètres. En comparaison avec Llama 2 8B et Llama 2 70B, Meta promet un bond dans les performances malgré le même nombre de paramètres.

Pour rappel, la quantité de paramètres d'un modèle IA détermine ses performances pour une tâche spécifique comme l'analyse ou la génération de texte.

Afin d'atteindre un tel niveau, la firme a entraîné ses nouveaux modèles sur deux clusters de 24 000 GPU construits spécialement pour l'occasion.

Et toujours d'après Meta, cette troisième génération ne se contente pas de surpasser la deuxième : elle rivalise avec les meilleures IA génératives disponibles à l'heure actuelle.

Que vaut Llama 3 face à Claude 3, GPT-4 et Gemini ?

Pour le prouver, elle souligne ses scores sur plusieurs benchmarks populaires comme MMLU pour mesurer la connaissance, ARC pour l'acquisition de compétences, et DROP pour le raisonnement sur du texte.

Ainsi, Llama 3 8B dépasse déjà d'autres modèles ouverts comme l'IA française Mistral 7B ou le Gemma 7B de Google sur au moins neuf benchmarks : MMLU, ARC, DROP, GPQA pour la science, HumanEval pour le code, GSM-8K et MATH pour les maths, AGIEval ou encore BIG-Bench Hard pour le sens commun.

Toutefois, il convient de noter que Mistral 7B et Gemma 7B datent déjà de la fin 2023. Néanmoins, Llama 3 70B quant à lui rivalise avec les meilleures IA comme Gemini 1.5 Pro : la dernière version de l'IA de Google.

Elle la surpasse même sur MMLU, HumanEval et GSM-8K. Et même si elle ne dépasse pas Claude 3 Opus, le meilleur modèle d'Anthropic, elle bat son petit frère Claude 3 Sonnet sur MMLU, GPQA, HumanEval, GSM8K et MATH.

Outre ces benchmarks, Meta a aussi développé ses propres tests pour différents cas d'usage comme le codage, l'écriture créative, ou encore le raisonnement.

Comme on peut s'en douter, Llama 3 70B surpasse Mistral Medium, OpenAI GPT-3.5 et Claude Sonnet sur ces tests…

Impressive results from Llama 3! pic.twitter.com/X85Wz3iol2

— Yann Dubois (@yanndubs) April 19, 2024

Un dataset d'entraînement 7 fois plus large que Llama 2 !

Dans le détail, Meta affirme que Llama 3 est plus facile à diriger que les précédentes versions, moins enclin à refuser de répondre, et plus précis sur les questions d'histoire ou de science.

Ceci s'explique notamment par son dataset beaucoup plus large avec 15 billions de tokens, soit environ 750 milliards de mots. C'est sept fois plus que le jeu de données de Llama 2.

Une question se pose toutefois : d'où proviennent ces données ? Meta se contente d'indiquer qu'il s'agit de sources publiquement disponibles, et qu'elles incluent quatre fois plus de code que celles de Llama 2 et 5% de données dans 30 langages autres que l'anglais.

Feeling the gap between the Llama-3-8B and Llama-3-70B models by @AIatMeta? Not sure how to use your extra vRAM? Look no further!

— Maziyar PANAHI (@MaziyarPanahi) April 19, 2024

I am excited to introduce three new Llama-3 models in 11B, 13B, and 16B sizes!

Find all 3 models on @huggingface pic.twitter.com/4UuGmCnfOu

Le but ? Améliorer ses performances dans les autres langues comme le français ! La firme a aussi utilisé des données synthétiques, générées par l'IA, pour créer des documents plus longs afin d'entraîner Llama 3 dessus.

Il n'est pas étonnant que Meta préfère garder une part de mystère sur les données d'entraînement, car il s'agit du nerf de la guerre de l'IA.

Toutefois, il peut aussi s'agir d'une façon de cacher l'utilisation de données protégées par les droits d'auteur. Une récente enquête a révélé que Meta s'est servi de e-books soumis au copyright pour entraîner ses précédentes IA et rattraper la concurrence…

Une pratique malheureusement très répandue dans l'industrie, profitant du manque de transparence des IA qui empêche de prouver avec quelles données elles ont été nourries.

Une IA moins toxique et raciste que ses concurrentes ?

La toxicité et les biais discriminatoires sont aussi deux problèmes récurrents chez les modèles d'IA générative.

Toutefois, Meta affirme avoir créé de nouveaux pipelines de filtrage de données pour booster la qualité des données d'entraînement de ses modèles.

L'entreprise a aussi mis à jour ses outils de sécurité Llama Guard et CybersecEval, dans le but d'empêcher l'utilisation à mauvais escient et les générations de contenu indésirable. Ceci s'applique à Llama 3, et aux autres modèles.

Un tout nouvel outil, Code Shield, va aussi permettre de détecter le code qui pourrait introduire des vulnérabilités de sécurité. Il faudra toutefois patienter pour découvrir si les hackers et cybercriminels parviennent à contourner ces barrières de sécurité…

Bientôt une version encore plus puissante !

En ce moment même, Meta entraîne des modèles Llama 3 avec plus de 400 milliards de paramètres. Ils seront capables de discuter dans une multitude de langages, de prendre davantage de données et de comprendre les images ou les autres modalités.

Ainsi, cette future IA sera au même niveau que d'autres modèles open source comme Hugging Face Idefics2.

À l'avenir, Meta se fixe pour objectif de faire de Llama 3 une IA polyglotte et multimodale, avec une fenêtre de contexte plus longue, et de continuer à améliorer ses performances sur le raisonnement et le codage…

Comment utiliser Llama 3 en France dès aujourd'hui ?

Les modèles Llama 3 sont disponibles en téléchargement, et servent aussi de moteur au chatbot Meta AI qu'on retrouve sur Facebook, Instagram, WhatsApp et Messenger.

Il sera bientôt aussi proposé sous forme gérée sur différentes plateformes cloud dont AWS, Databricks, Google Cloud, Hugging Face, Kaggle, IBM WatsonX, Microsoft Azure, Nvidia NIM et Snowflake.

En outre, de futures versions optimisées pour le hardware AMD, AWS, Dell, Intel, Nvidia et Qualcomm seront prochainement disponibles.

Même si Meta vante l'ouverture de cette IA, notons qu'il est interdit de l'utiliser pour entraîner d'autres modèles d'IA générative. De plus, les développeurs d'applications avec plus de 700 millions d'utilisateurs mensuels doivent demander une licence spéciale à la firme américaine.

Pour la première fois, le chatbot basé sur Llama a aussi son propre site web, dans la lignée de ChatGPT, Mistral Le Chat ou Google Gemini. Il s'agit du site web meta.ai, qui permet de dialoguer directement avec l'IA.

Toutefois, pour le moment, ce site web n'est accessible que depuis les États-Unis. Si vous vous rendez sur le site meta.ai, un message vous indiquera qu'il n'est pas disponible dans votre pays.

Rassurez-vous ! Contrairement à Claude 3 qui vérifie votre véritable localisation, Meta.ai peut être très facilement trompé… à l'aide d'un simple VPN !

Consultez notre classement des meilleurs VPN en suivant ce lien, choisissez celui qui vous plaît, et utilisez-le pour simuler une connexion depuis les États-Unis.

Vous pouvez dès lors vous rendre sur le site web Meta.ai, et commencer à l'utiliser en tant qu'invité ou en vous connectant avec votre compte Facebook.

Dès lors, vous pouvez entrer votre prompt textuel comme sur ChatGPT, ou utiliser l'onglet « Imagine » pour créer des images comme avec MidJourney !

Alors, que pensez-vous de cette nouvelle IA ? Trouvez-vous qu'elle est meilleure que ChatGPT ? Partagez votre avis en commentaire !

Cet article Meta lance l’IA Llama 3 ! Découvrez sa puissance, et le secret pour l’utiliser en France ! a été publié sur LEBIGDATA.FR.

-

LEBIGDATA.FR

-

Vous avez raté Nvidia ? Voici l’action IA sur laquelle miser (selon les experts)

Investir dans une action IA est une des méthodes les plus efficaces pour devenir riche avec la haute technologie. Il y a quelques mois, les spécialistes misaient sur Nvidia. Mais il y a actuellement une entreprise émergente pour dupliquer vos profits. Nvidia a toujours été une référence dans le secteur de l'IA. Cette entreprise fournit les puces des grands modèles de langages comme GPT. Certes, Nvidia domine une partie du marché. Logiquement, ses actions gonflent en bourse. Toutefois, il exis

Vous avez raté Nvidia ? Voici l’action IA sur laquelle miser (selon les experts)

Investir dans une action IA est une des méthodes les plus efficaces pour devenir riche avec la haute technologie. Il y a quelques mois, les spécialistes misaient sur Nvidia. Mais il y a actuellement une entreprise émergente pour dupliquer vos profits.

Nvidia a toujours été une référence dans le secteur de l'IA. Cette entreprise fournit les puces des grands modèles de langages comme GPT. Certes, Nvidia domine une partie du marché. Logiquement, ses actions gonflent en bourse. Toutefois, il existe d'autres entreprises capables de donner des bénéfices similaires. Miser sur une action IA de ces multinationales permet alors de surfer sur la rentabilité de cette activité. Tout savoir.

Les performances de Nvidia dans le domaine de l'IA

Actuellement, Nvidia domine 90 % du marché des puces IA. L'entreprise prévoit de dépasser les 304 milliards de dollars de chiffre d'affaires d'ici 2030. Forcément, l'action IA de cette firme va continuer à gonfler sur le long terme.

Les spécialistes ont analysé la performance de la société. Selon leurs enquêtes, les actions de Nvidia se négocient à des valeurs élevées. Cette tendance se base sur l'émergence extraordinaire des puces IA.

Logiquement, plusieurs investisseurs vont se ruer vers cette action IA. Si vous voulez vous lancer, privilégiez d'abord les autres entreprises. Oui, il existe des firmes capables de donner des bénéfices considérables.

Et si vous misez sur l'action IA de Qualcomm ?

Les géants de l'intelligence artificielle ont conquis les smartphones. OpenAI, Google, et Microsoft ont tous des applications sur Android et iOS. Cependant, ces IA n'atteindront pas leur performance optimale sans des puces.

Qualcomm mise alors sur sa puce Snapdragon 8 Gen 3. Cette dernière est indispensable pour les modèles d'IA génératifs. Mais l'entreprise ne s'arrête pas là. Elle a amélioré son CPU de référence. Plusieurs smartphones seront équipés du Snapdragon 8 S Gen 3 d'ici peu.

Qualcomm va aussi s'aventurer sur le marché des PC. Le géant des puces a lancé les CPU Snapdragon X Elite. Ces modèles seront disponibles pour le grand public d'ici quelques mois. Bien sûr, ces composants ont été fabriqués spécialement pour l'IA.

Selon l'analyse des experts, cette entreprise domine déjà 23 % du marché des puces IA. En 2024, Qualcomm a encore connu une hausse de 16 % comparé à l'année dernière. D'ici 2027, la valeur de cette multinationale pourrait augmenter de 83 %. Investir dans une action IA de Qualcomm va rapporter gros, surtout sur le long terme.

Cet article Vous avez raté Nvidia ? Voici l’action IA sur laquelle miser (selon les experts) a été publié sur LEBIGDATA.FR.

-

Intelligence artificielle

-

Qualcomm lève le voile sur sa puce Snapdragon 8S Gen 3 faite pour l'IA

Qualcomm a annoncé le lancement de son dernier processeur, le Snapdragon 8s Gen 3, qui vient enrichir son offre haut de gamme. Avec, le fondeur...

Qualcomm lève le voile sur sa puce Snapdragon 8S Gen 3 faite pour l'IA

-

LEBIGDATA.FR

-

Les smartphones atteignent de nouveaux sommets avec le Snapdragon 8s Gen 3

Qualcomm Technologies, Inc. lance la plateforme Snapdragon 8s Gen 3. Cette avancée marque une révolution pour les smartphones Android haut de gamme. Cette nouvelle plateforme apporte des fonctionnalités premium, comme l'IA générative, à plus d'utilisateurs. Un pionnier dans l'IA et le divertissement mobile Cette nouvelle plateforme intègre des fonctionnalités d'IA générative de pointe qui permet une utilisation plus intuitive et personnalisée des smartphones. Les utilisateurs peuvent bé

Les smartphones atteignent de nouveaux sommets avec le Snapdragon 8s Gen 3

Qualcomm Technologies, Inc. lance la plateforme Snapdragon 8s Gen 3. Cette avancée marque une révolution pour les smartphones Android haut de gamme. Cette nouvelle plateforme apporte des fonctionnalités premium, comme l'IA générative, à plus d'utilisateurs.

Un pionnier dans l'IA et le divertissement mobile

Cette nouvelle plateforme intègre des fonctionnalités d'IA générative de pointe qui permet une utilisation plus intuitive et personnalisée des smartphones. Les utilisateurs peuvent bénéficier d'une expérience de photographie améliorée grâce à un ISP à détection permanente, et d'une qualité de jeu inégalée.

La connectivité révolutionnaire et le son haute définition sans perte font également partie des caractéristiques remarquables de cette nouvelle plateforme.

L'adoption par les leaders du secteur

Le Snapdragon 8s Gen 3 ne se contente pas de promettre une révolution technologique. Il a déjà obtenu le soutien de fabricants majeurs de smartphones comme Honor, iQOO, realme, Redmi et Xiaomi.

Cette collaboration entre Qualcomm et les principaux OEM garantit que les consommateurs auront accès à des appareils innovants dans les mois à venir.

Impact sur l'expérience utilisateur

Selon Chris Patrick, vice-président senior et directeur général des téléphones mobiles chez Qualcomm Technologies, Inc., le Snapdragon 8s Gen 3 est conçu pour enrichir l'expérience utilisateur quotidienne. Avec des capacités d'IA générative embarquée et des fonctionnalités photographiques avancées, cette plateforme est destinée à stimuler la créativité et la productivité des utilisateurs. Cela leur permettra de profiter pleinement des dernières innovations technologiques.

Premier pas avec Xiaomi

Dans le cadre de cette innovation, Xiaomi, un acteur clé du marché mondial, s'associe à Qualcomm pour lancer le premier smartphone alimenté par le Snapdragon 8s Gen 3.

William Lu, de Xiaomi, exprime son enthousiasme à l'idée de fournir aux clients une expérience premium et personnalisée. Il a déclaré : « Cette nouvelle plateforme mobile nous permettra d'offrir à nos clients une expérience premium personnalisée, grâce à l'intelligence artificielle générative. »

Répercussions sur l'industrie mobile

Le Snapdragon 8s Gen 3 est positionné pour redéfinir les standards de l'industrie mobile. En rendant les fonctionnalités premium plus accessibles, Qualcomm démocratise l'expérience haut de gamme pour un plus grand nombre d'utilisateurs.

Ce mouvement pourrait inciter d'autres acteurs de l'industrie à suivre le pas. Cela va entraîner une vague d'innovations et d'améliorations dans les appareils de milieu et haut de gamme.

Vers un futur connecté et intuitif

Le Snapdragon 8s Gen 3 de Qualcomm représente un pas en avant vers un avenir où la technologie mobile est à la fois plus accessible et plus avancée. Cette innovation invite les utilisateurs à suivre les développements sur le site officiel de Qualcomm pour plus d'informations.

Article basé sur un communiqué de presse reçu par la rédaction.

Cet article Les smartphones atteignent de nouveaux sommets avec le Snapdragon 8s Gen 3 a été publié sur LEBIGDATA.FR.

-

Intelligence artificielle

-

[MWC 2024] Honor présente le MagicBook 16 Pro, son PC dopé à l'IA

Honor a profité du MWC qui se tient à Barcelone du 26 au 29 février pour dévoiler son tout nouvel ordinateur portable doté de l'IA, le...

[MWC 2024] Honor présente le MagicBook 16 Pro, son PC dopé à l'IA

-

Intelligence artificielle

-

[MWC 2024] Le Magic 6 Pro d'Honor arrive en France

Dernier né de la gamme Magic, le Honor Magic 6 Pro est la star du stand du constructeur chinois au Mobile World Congress, qui se tient à...

[MWC 2024] Le Magic 6 Pro d'Honor arrive en France

-

Intelligence artificielle

-

[MWC 2024] Qualcomm veut faciliter l'exécution de modèles d'IA générative sur smartphone

Tout le monde cherche à surfer sur la vague de l'intelligence artificielle générative au Mobile World Congress 2024, et Qualcomm n'échappe pas...

[MWC 2024] Qualcomm veut faciliter l'exécution de modèles d'IA générative sur smartphone

-

Intelligence artificielle

-

[MWC 2024] Deutsche Telekom dévoile un prototype de smartphone alimenté par l'IA et sans app

Est-ce la fin des applications ? Si la tendance est plutôt à la multiplication des applications en tout genre sur smartphone, Deutsche Telekom...

[MWC 2024] Deutsche Telekom dévoile un prototype de smartphone alimenté par l'IA et sans app

-

Intelligence artificielle

-

Qualcomm enregistre une forte croissance sur le segment automobile

Qualcomm a fait part de sa bonne santé financière à l'occasion de la publication des résultats financiers pour le premier trimestre de son...

Qualcomm enregistre une forte croissance sur le segment automobile

-

IA

-

Tiré par l’IA et l’automobile, le marché des semi-conducteurs devrait rebondir de 13% en 2024

Après un passage à vide en 2023, le marché des semi-conducteurs devrait retrouver des couleurs en 2024. La demande accrue en intelligence...