J’ai porté les Meta Ray-Ban toute une journée : voici ce qui m’a surpris et irrité

Les courses ne seront plus jamais les mêmes grâce aux Meta Ray-Ban alimentées par l’IA.

J’ai testé ces lunettes intelligentes lors d’une sortie shopping typique chez Target et dans mon épicerie locale. Disons simplement que l’expérience a été tout sauf ordinaire. Ces lunettes transforment des tâches banales en expériences connectées et optimisées.

Les Meta Ray-Ban associent un design classique à des fonctionnalités de pointe. À première vue, elles ressemblent à des lunettes classiques. Pour moi, elles étaient légèrement surdimensionnées, car les modèles ne sont disponibles qu’en tailles standard et grande. J’ai opté pour la version transparente, parfaite pour un usage en intérieur. L’IA intégrée a montré sa valeur dès mes premières courses.

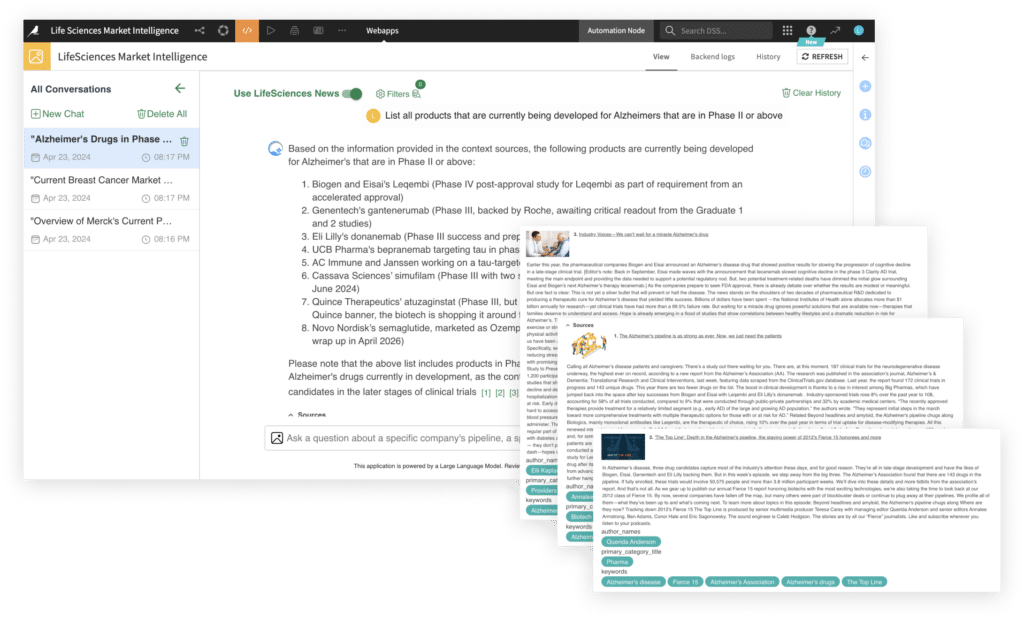

En tant que parent, gérer ma liste de courses est un grand défi. Avec ces lunettes, j’ai pu prendre des notes en mains libres grâce aux commandes vocales. Plus besoin de sortir mon téléphone pour vérifier un message. Quand ma femme m’a rappelé d’acheter des sacs poubelles, j’ai pu me concentrer sur mes achats sans interruption. Cette facilité d’utilisation a vraiment changé ma façon de faire les courses.

Acheter en toute intelligence

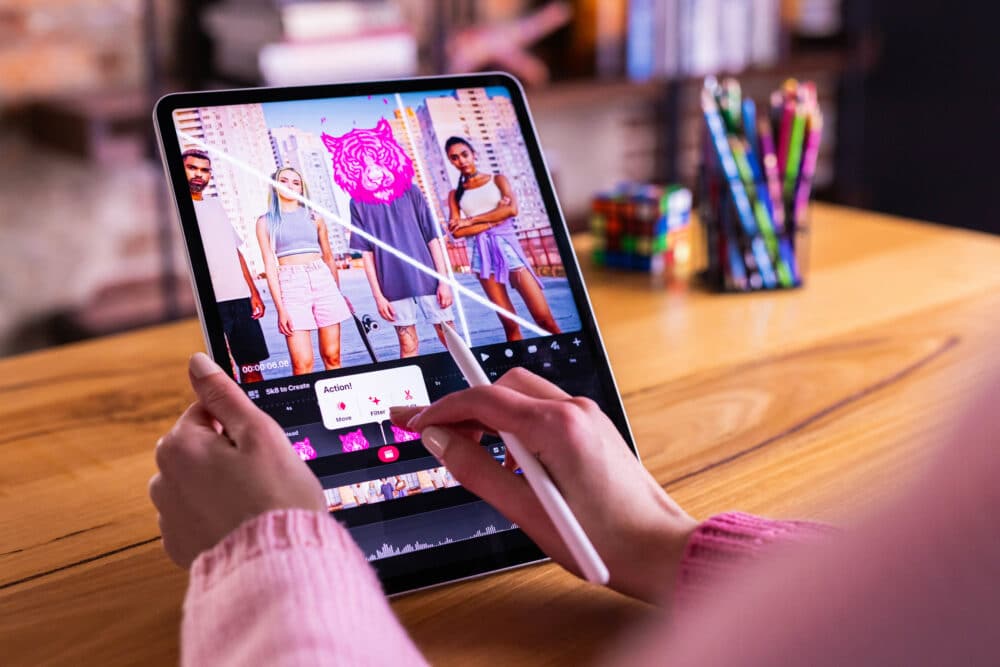

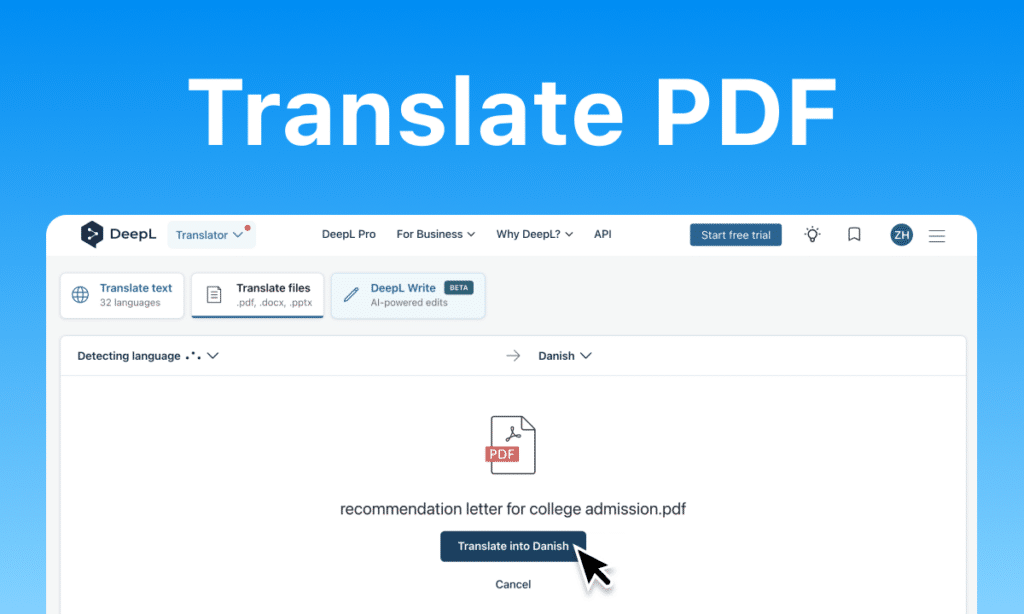

Chez Target, célèbre pour ses tentations d’achats impulsifs, j’ai utilisé les lunettes pour prendre des photos des produits. Au lieu de remplir mon panier sur un coup de tête, j’ai capturé des images pour les revoir plus tard. Meta AI m’a même aidée à comparer des produits en temps réel. À un moment donné, j’ai demandé si des sacs de congélation spécifiques étaient nécessaires ou si des alternatives suffiraient. L’IA m’a répondu sans que j’aie à sortir mon téléphone.

Les lunettes permettent aussi de passer des appels sans effort. J’ai appelé ma femme pour lui montrer un produit en direct. La clarté de la vidéo était impressionnante et discuter sans tenir un téléphone semblait étrangement naturel. Certes, j’ai reçu quelques regards curieux, mais aujourd’hui, discuter via des écouteurs ou des lunettes intelligentes n’est plus si inhabituel.

Pour tester la fonction de diffusion en direct, j’ai partagé une visite du rayon décoration saisonnière sur Instagram. Le streaming en direct s’est déroulé sans accroc. Cette fonctionnalité mains libres m’a permis d’interagir avec mes abonnés tout en continuant mes courses. Même si je ne fais pas souvent de direct, la simplicité des Meta Ray-Ban pourrait bien me convaincre de le faire plus souvent.

Points faibles à prendre en compte

Malgré leur côté pratique, les lunettes présentent quelques défauts. L’autonomie de la batterie est limitée, surtout avec une utilisation intensive. Environ 2 heures d’utilisation suffisent pour épuiser la batterie, ce qui n’est pas idéal pour les longues sorties. De plus, la reconnaissance vocale peut avoir du mal en milieu bruyant, comme les files d’attente bondées. Enfin, les lunettes nécessitent une connexion Wi-Fi pour fonctionner pleinement. Heureusement, des points d’accès Wi-Fi sont disponibles dans de nombreux magasins.

Cet article J’ai porté les Meta Ray-Ban toute une journée : voici ce qui m’a surpris et irrité a été publié sur LEBIGDATA.FR.