Manque d’aides : l’IA peine à décoller dans les PME françaises

Les PME françaises veulent plus d’IA européenne mais peinent à trouver des financements. Un paradoxe qui illustre un besoin urgent d’accompagnement.

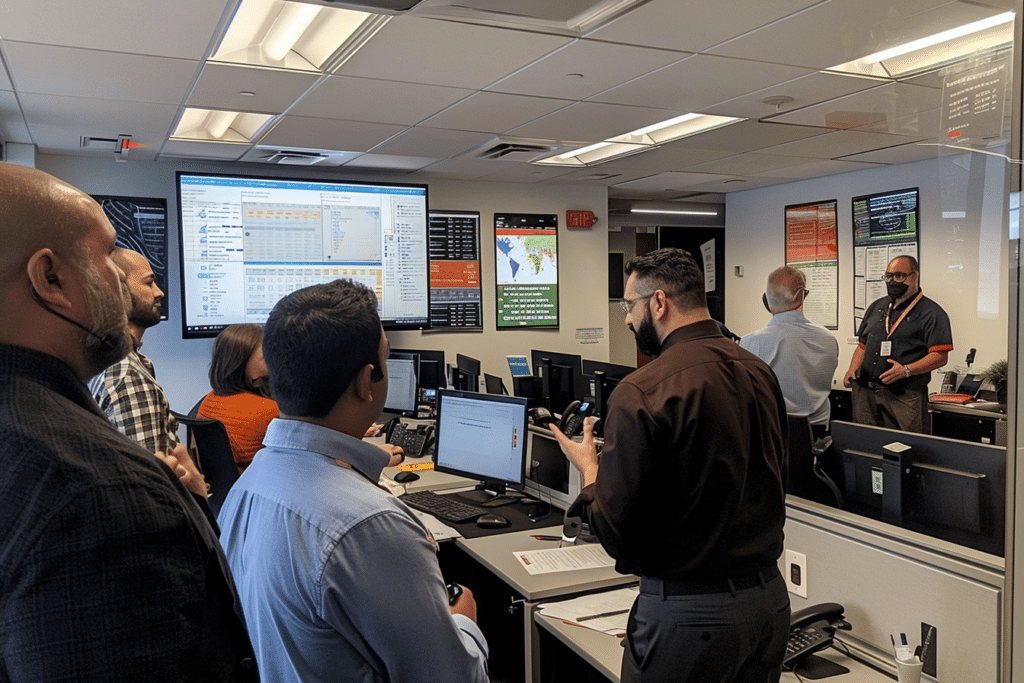

Mi-juin 2025, lors de VivaTech, l’intelligence artificielle a encore occupé le devant de la scène. Mais cette année, la souveraineté numérique a dominé les échanges. Selon une enquête OnePoll pour reichelt elektronik, 76 % des PME françaises souhaitent que l’Europe développe ses propres outils d’IA compétitifs. Pourtant, si 72 % d’entre elles utilisent déjà l’IA ou comptent l’adopter, peu osent solliciter des financements.

Une forte attente d’outils européens et conformes aux normes

Les résultats de l’étude mettent en lumière une volonté claire des dirigeants de PME : s’appuyer sur un écosystème européen capable de rivaliser avec les géants américains et chinois. Plus d’un tiers des décideurs (37 %) plébiscitent même des solutions IA « favorisées car conformes aux normes européennes de protection des données ».

Ce positionnement fait écho aux débats qui ont traversé VivaTech ! Face aux rivalités géopolitiques et à la fragmentation des marchés, la demande de souveraineté technologique s’impose comme un thème central. Derrière cette aspiration se cache aussi une logique de confiance : les PME considèrent que la conformité aux standards européens en matière de data renforce la sécurité et l’acceptabilité des outils déployés.

Des financements encore trop peu sollicités

Si l’usage de l’IA progresse rapidement, le coût d’investissement reste un frein majeur : 22 % des dirigeants interrogés le placent en première barrière. Pourtant, les dispositifs de soutien existent à plusieurs niveaux. Au niveau européen, seules 27 % des PME ont déposé une demande de financement, et à peine 17 % ont obtenu une aide via Horizon Europe ou Digital Europe. Côté national, 22 % ont candidaté au programme IA Booster France 2030, avec un taux d’obtention de 18 %.

Quant au concours i-Lab, il n’a attiré que 19 % des entreprises. Même constat au niveau régional : 28 % ont sollicité une aide, 21 % en ont bénéficié. Des initiatives comme le dispositif CAP’TN en Centre-Val de Loire, qui propose jusqu’à 200 000 € de soutien, restent trop méconnues. Ce faible recours illustre un paradoxe : les financements sont là, mais l’information et l’accompagnement ne suivent pas.

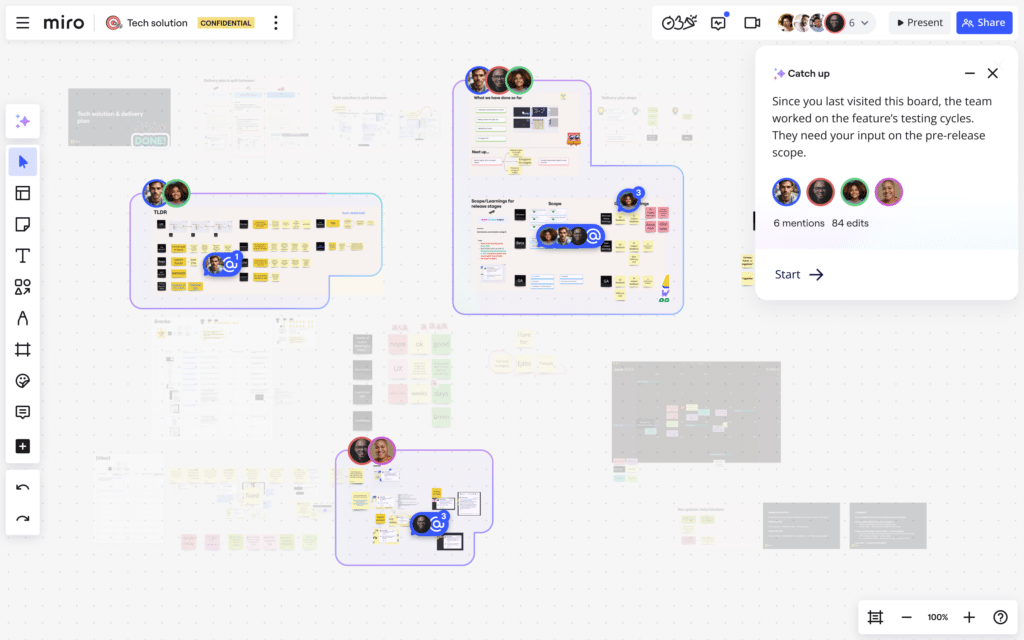

Le besoin d’accompagnement, une priorité exprimée

Derrière ces chiffres, une réalité saute aux yeux : les PME ne manquent pas seulement de fonds, mais de soutien pour franchir le pas. Près de la moitié (46 %) réclament un accès facilité à des conseils spécialisés, 40 % souhaitent un meilleur accès aux dispositifs de financement et 38 % demandent une simplification administrative. « L’IA représente une opportunité pour les PMEs en quête d’innovation et pour faire face à la concurrence mondiale. Mais freinées par les coûts, l’accès aux financements français eto européens est déterminant pour elles », souligne Christian Reinwald, Head of Product Management & Marketing chez reichelt elektronik.

Il ajoute : « Si aujourd’hui, la tech ne représente que 10 % du budget de l’UE, dans les années à venir l’augmentation des financements consacrés à ce domaine permettront d’accompagner les entreprises et PMEs à renforcer leur place sur l’échiquier international ». On l’aura compris ! L’IA est désormais un enjeu stratégique qui ne se résume pas à la technologie, mais implique des choix politiques et économiques décisifs.

Article basé sur un communiqué de presse reçu par la rédaction.

Cet article Manque d’aides : l’IA peine à décoller dans les PME françaises a été publié sur LEBIGDATA.FR.