IgniteTech MyPersona réinvente le clonage numérique corporate

Comment la solution IgniteTech MyPersona redéfinit-elle l’interaction humaine via les clones numériques ? La synchronisation entre l’image et la voix propose des perspectives inédites pour la productivité. Lançons nous dans une exploration technique de cette innovation majeure en matière d’intelligence artificielle.

Avant de plonger dans le vif du sujet, je vous invite à vous abonner à notre chaîne YouTube pour davantage de découvertes sur les dernières technologies d’avatar.

Qu’est-ce que d’IgniteTech MyPersona ?

Solution développée par IgniteTech, MyPersona se focaliser sur la duplication humaine. L’outil basé sur un algorithme de pointe génère un clone numérique capable de reproduire le langage et la voix. Cette technologie utilise des enregistrements de vidéo réelle pour créer un avatar interactif.

L’apparence visuelle du double reste fidèle à l’original physique. Le système assure une communication fluide dans plusieurs langues étrangères. Chaque utilisateur fournit des échantillons sonores pour calibrer la synthèse vocale. L’intelligence artificielle derrière cette prouesse technologique traite ces données afin d’assurer un réalisme optimal.

Cette approche technique favorise une immersion totale lors des échanges numériques. L’architecture logicielle supporte une résolution d’image très élevée pour un rendu net. Les capteurs biométriques enregistrent les micro-expressions du visage humain avec précision. Le logiciel traite ainsi ces mouvements pour animer le visage de l’avatar virtuel.

Le rendu final évite l’effet de vallée perturbatrice grâce à des calculs complexes. Les serveurs de calcul haute performance gèrent la génération des images en temps réel. Cette puissance de traitement assure donc une réactivité immédiate lors des appels vidéo. L’entité virtuelle de IgniteTech MyPersona s’adapte aux spécificités culturelles de chaque interlocuteur.

Technologies de clonage derrière IgniteTech MyPersona

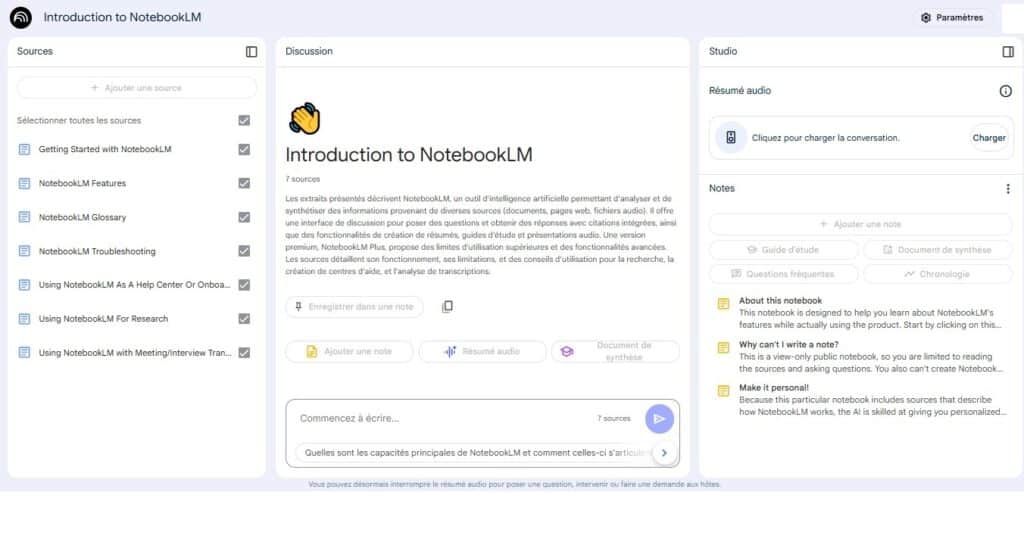

Le processus repose sur un clonage multimodal qui traite simultanément l’image et le son. Le logiciel utilise l’apprentissage dynamique pour enrichir ses capacités de réponse. Si l’avatar ignore une information précise alors il sollicite l’expert humain immédiatement. Le clone intègre ensuite cette nouvelle donnée dans sa mémoire permanente.

Cette méthode assure une mise à jour constante des connaissances de l’entité virtuelle. L’architecture supporte l’importation de documents massifs et de bases de données privées. Les interfaces de programmation connectent l’outil aux flux d’informations externes en temps réel. Cette connectivité renforce la précision des réponses apportées aux interlocuteurs.

Le moteur de traitement analyse les structures sémantiques pour adapter le discours. Les réseaux de neurones profonds imitent la structure de pensée de l’utilisateur original. Le système mémorise les préférences de communication pour personnaliser chaque échange futur. Les données de formation restent chiffrées pour protéger le patrimoine intellectuel de l’entreprise.

Le clone apprend à identifier les intentions derrière les questions posées. Cette compréhension contextuelle améliore la pertinence des conseils fournis par l’intelligence artificielle. Les mises à jour logicielles régulières augmentent la capacité d’analyse de la plateforme. L’apprentissage de l’IA se déroule en arrière-plan sans interrompre les activités quotidiennes.

Modes d’interaction et continuité des échanges

Les capacités conversationnelles couvrent 160 langues avec une précision linguistique élevée. Une fonction nommée Live Joining ou jonction en direct autorise une intervention humaine immédiate. Le propriétaire du clone rejoint la discussion en cours si le sujet l’exige. Cette transition entre l’intelligence artificielle et l’humain s’effectue sans aucune rupture.

La fluidité des échanges découle d’une actualisation permanente des serveurs centraux. Le système maintient une cohérence narrative sur des sessions de longue durée. Chaque interaction alimente le profil de l’utilisateur pour affiner les futures répliques. Les algorithmes de traitement naturel du langage assurent une compréhension textuelle fine.

La latence réduite favorise des dialogues naturels et spontanés. Le logiciel ajuste le ton de la voix selon le contexte de la discussion. L’avatar perçoit les nuances émotionnelles dans la voix de son interlocuteur. Cette sensibilité technique rend les échanges plus humains et moins mécaniques.

Les usagers configurent d’abord des horaires de disponibilité pour leurs doubles numériques. Le système gère les files d’attente lors de demandes simultanées de plusieurs clients. Chaque session de discussion génère un compte rendu écrit pour l’expert humain. Cette traçabilité facilite le suivi des dossiers par les équipes opérationnelles.

Usages professionnels, notamment dans la formation continue

Les entreprises déploient ce service pour les départements des ressources humaines ou de la finance. L’outil gère aussi le support technique pour résoudre les problèmes clients courants. Cette délégation libère les experts qualifiés des tâches répétitives et chronophages. Le domaine de l’éducation profite de cette multiplication de la présence du formateur.

Un enseignant diffuse son savoir auprès de milliers d’étudiants de manière simultanée. La disponibilité permanente de l’avatar favorise une formation continue efficace et personnalisée. Les structures professionnelles optimisent ainsi leur coût de fonctionnement interne. Chaque clone numérique exécute des présentations complexes avec une régularité parfaite.

Cette technologie transforme la transmission du savoir au sein des organisations modernes. Les employés accèdent à une assistance technique 24 heures sur 24. Le système répond aux questions administratives simples sans mobiliser le personnel fixe. Les modules de formation s’adaptent au rythme de progression de chaque élève.

L’avatar virtuel anime par ailleurs des sessions de recrutement pour effectuer un premier tri. Les candidats interagissent avec une entité capable de présenter la culture d’entreprise. Cette automatisation améliore l’efficacité des processus de sélection pour les grands groupes. Le clone assure une équité de traitement entre tous les postulants.

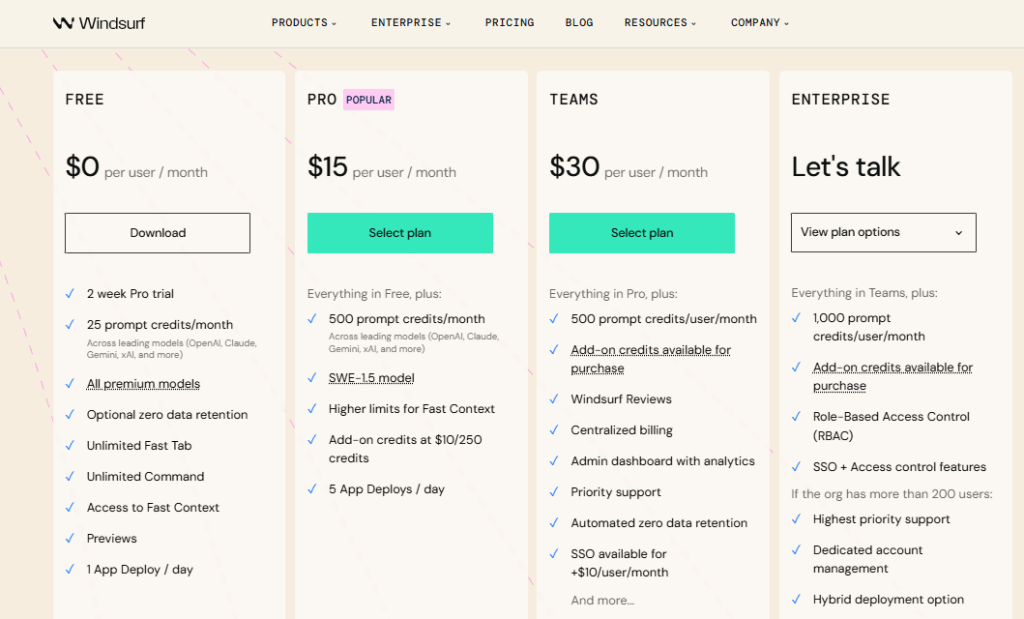

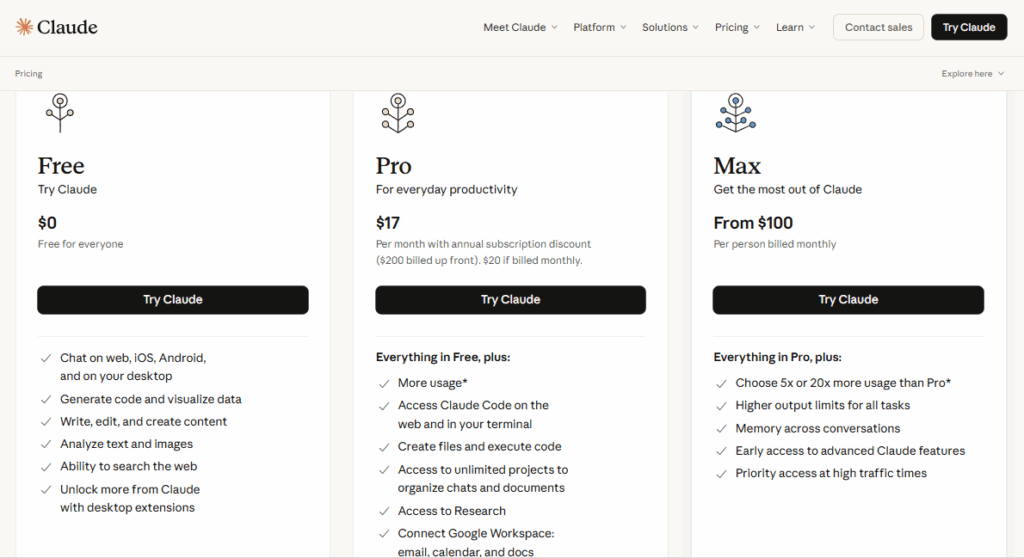

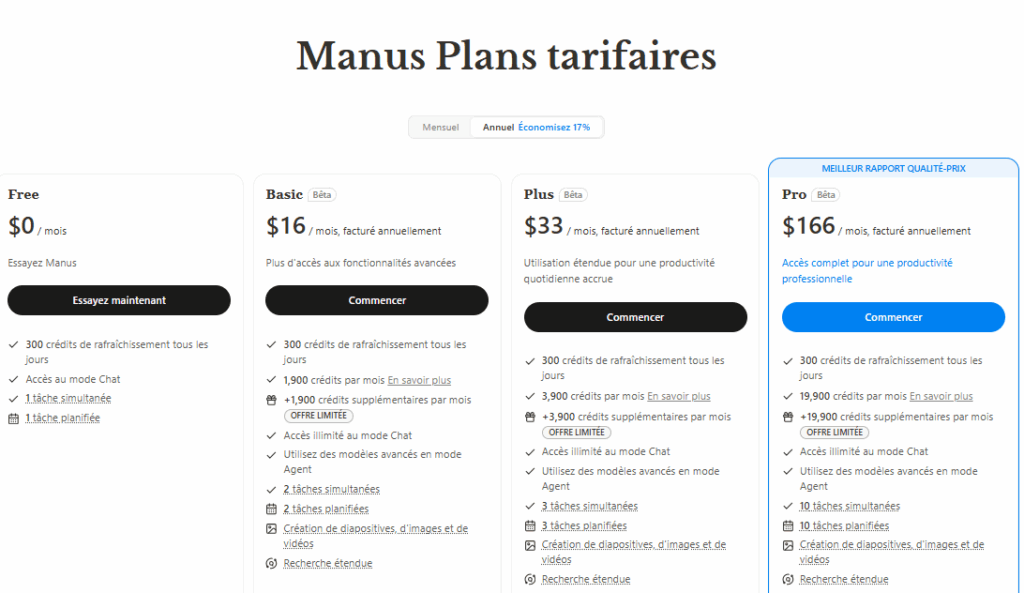

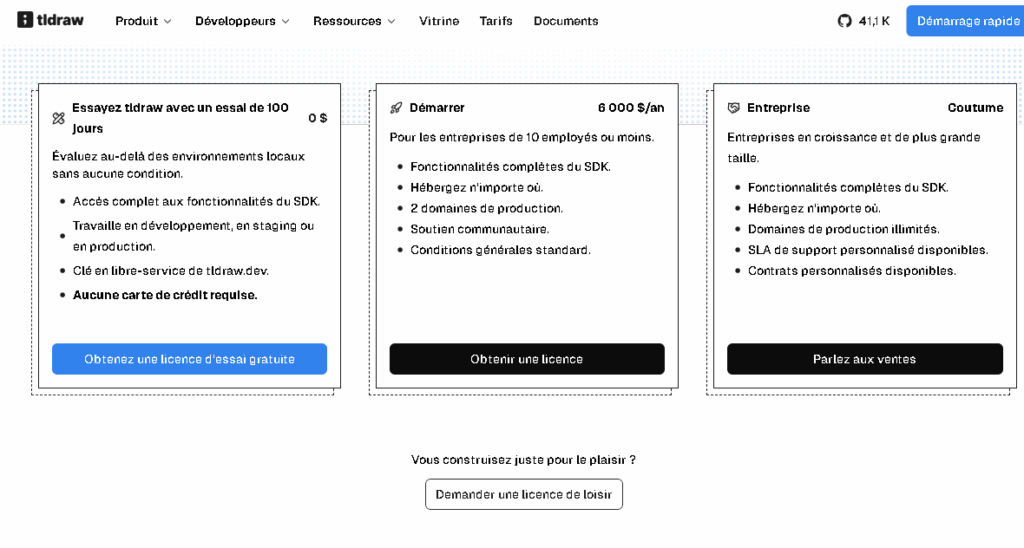

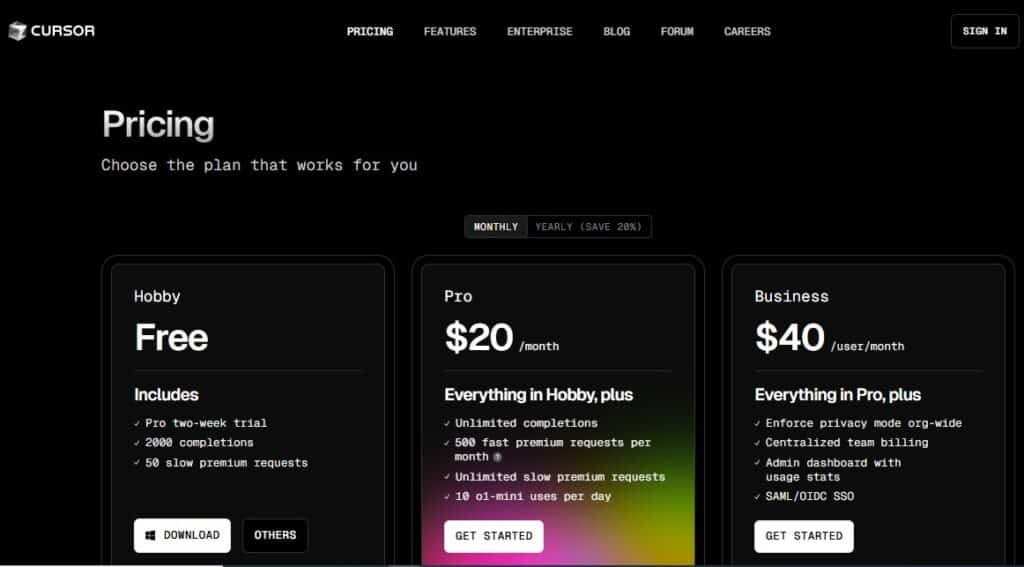

Modèle économique et disponibilité en 2026

La distribution de IgniteTech MyPersona repose notamment sur un modèle de licences logicielles pour les professionnels. Le fournisseur propose un essai gratuit de 14 jours pour tester la création d’un double. Cette période de test valide ainsi la pertinence du clone avant un déploiement massif. Le service s’adresse exclusivement aux organisations et exclut le grand public.

Les tarifs s’ajustent selon le volume de données traitées et le nombre d’avatars. Cette stratégie commerciale privilégie la qualité des interactions dans un cadre strictement corporatif. L’infrastructure héberge les clones sur des serveurs sécurisés pour garantir la confidentialité. Les clients gèrent leurs abonnements via un tableau de bord centralisé et intuitif.

Le coût inclut le support technique ainsi que les mises à jour technologiques régulières. Les entreprises choisissent entre plusieurs niveaux de services selon leurs besoins en calcul. Les options de personnalisation avancées demandent un investissement supplémentaire pour les grands comptes. Cette flexibilité tarifaire favorise l’adoption du logiciel par les moyennes entreprises.

Le déploiement s’effectue sur le nuage informatique pour faciliter l’accès mondial. Les protocoles de sécurité répondent aux normes internationales de protection des données sensibles. Chaque contrat de service définit les limites de responsabilité de l’intelligence artificielle. Cette clarté juridique rassure les directions informatiques lors de l’intégration.

Positionnement face aux alternatives de clonage IA

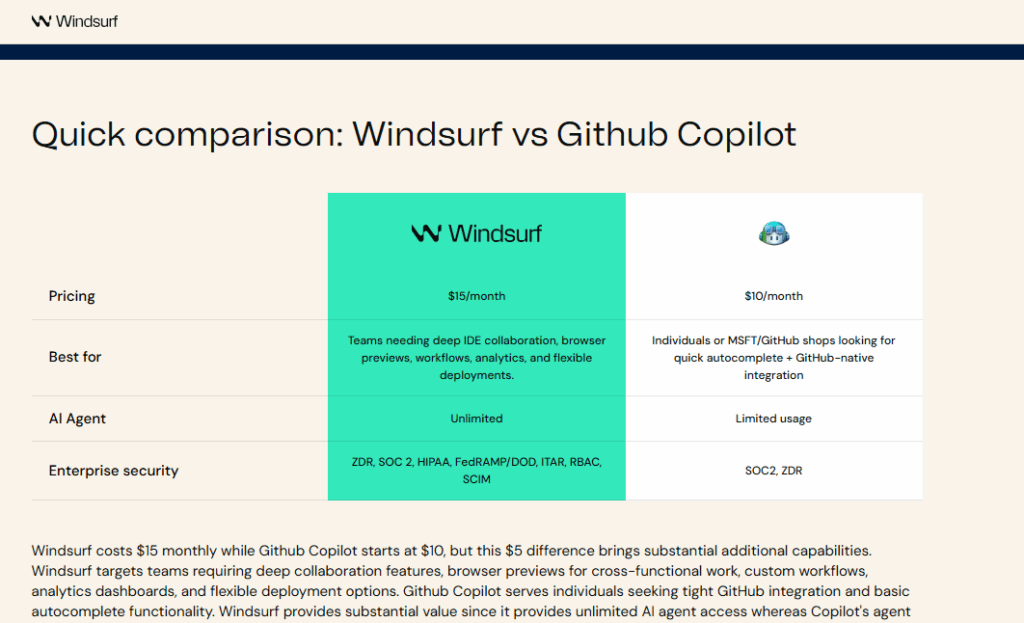

Le marché propose déjà des solutions comme HeyGen AI pour la production de vidéos marketing. La plateforme Synthesia se spécialise dans la création de présentateurs virtuels pour les tutoriels. De son côté la société January AI oriente ses efforts vers la santé prédictive. Ces entreprises diffèrent par leur spécialisation métier respective.

Le produit de IgniteTech MyPersona privilégie la productivité brute et la gestion de la connaissance. Cette distinction technique place l’outil au centre des flux de travail numériques. L’avatar devient un collaborateur actif plutôt qu’un simple support de communication visuelle. La polyvalence du système assure une intégration facile dans les logiciels existants.

La capacité d’apprentissage dynamique constitue un avantage concurrentiel majeur pour la marque. Les autres outils restent habituellement limités à des scripts préétablis et figés. Le clone numérique de cette plateforme évolue avec les connaissances de son propriétaire humain. Cette caractéristique technique justifie son positionnement haut de gamme dans le secteur.

Les analystes observent une convergence des technologies de synthèse vocale et visuelle. Le choix d’une solution dépend désormais de la capacité de traitement des données. Le système se distingue par sa gestion fluide des échanges en direct. Cette performance technique attire les clients à la recherche d’une excellence opérationnelle.

Questions fréquentes sur Ignite Tech MyPersona

Quel équipement technique est nécessaire pour l’enregistrement initial des données ?

Une caméra haute définition standard et un microphone de bonne qualité suffisent pour capturer les échantillons. Aucun équipement de studio professionnel n’est ainsi requis pour l’importation des données vidéo et audio de base.

Quel est le délai moyen de création d’un clone une fois les fichiers soumis ?

Le processus de traitement informatique, incluant la calibration biométrique et l’entraînement initial du modèle d’IA, prend généralement entre 24 et 48 heures avant que l’avatar ne soit opérationnel.

Peut-on modifier l’environnement visuel ou les vêtements de l’avatar après sa génération ?

Actuellement, non. L’aspect visuel reste strictement fidèle à la vidéo source utilisée lors de la création pour garantir un réalisme maximal et éviter des incohérences graphiques.

Est-il possible de créer un avatar « collectif » représentant une marque au lieu d’une personne unique ?

La technologie est spécifiquement conçue pour la duplication individuelle. Elle vise notamment à maintenir l’authenticité d’une interaction humaine spécifique et ne propose pas de créer des mascottes génériques.

Au-delà de la parole, le clone peut-il effectuer des actions concrètes dans d’autres logiciels ?

Oui, via des intégrations API avancées, le clone peut en effet déclencher des workflows spécifiques, comme planifier une réunion directement dans le calendrier de l’utilisateur ou mettre à jour une fiche CRM.

Qu’advient-il des données biométriques si une entreprise résilie son abonnement ?

Conformément aux normes strictes de protection des données, toutes les informations personnelles et les modèles d’apprentissage sont ainsi supprimés définitivement des serveurs après la fin du contrat.

Le système impose-t-il des restrictions sur les types de conseils donnés par le clone ?

Des garde-fous éthiques sont intégrés pour empêcher l’IA de prodiguer des conseils sensibles, notamment dans les domaines financier, juridique ou médical, s’ils sortent du cadre de connaissances validé par l’expert humain.

Cet article IgniteTech MyPersona réinvente le clonage numérique corporate a été publié sur LEBIGDATA.FR.