Sais-tu le dire ?

Bienvenue sur IA-Pulse Weekend. Cette édition porte le numéro 158. En vous abonnant, vous recevez tous les samedis matin, l’essentiel de ce qu’il s’est passé cette semaine autour de l’IA : un coup de gueule édito, une sélection de 3 actualités avec pour chacune un résumé rapide à lire, plus 1 article de fond pour ouvrir l’esprit et réfléchir et 1 podcast à écouter. Gérez votre abonnement.

⏱️Temps de lecture de cette newsletter par une unité carbone : 10 mins

Il y a 3 ans, le 15 avril 2023, j’envoyais le premier numéro de cette newsletter du weekend à 9 personnes. Vous êtes ce matin 5484 abonnés, et chaque weekend cette newsletter est lue en moyenne par 4000 à 5000 personnes, en comptant celles et ceux qui arrivent directement sur la page web hébergée par Substack. En 3 ans, IA-Pulse a évolué. En plus de cette édition gratuite - et qui le restera - du weekend, il y a des hors-série avec des contenus longs et plus fouillés qui sont depuis quelques mois accessibles avec un abonnement, les archives de plus de 2 mois sont aussi réservées aux abonnées payants, et quelques épisodes de podcasts et des articles plus pratiques. Merci à toutes et à tous pour vos différents soutiens sous différentes formes, et merci de suivre cette petite aventure.

Le titre de la première édition du weekend en avril 2023 était : “La semaine des agents”. Je parlais d’AUTO-GPT, BabyAGI, JARVIS, Smallville… Déjà on voyait la vie et l’avenir à travers les “agents”. C’est une constante dans notre monde de “l’IA” - en passant, il y aurait à redire et à disserter sur ce que nous mettons derrière ces “appellations” IA et agents - : on surestime toujours de trop les effets à court terme, et on sous-estime énormément les effets à long terme - fameuse loi attribuée à Roy Amara.

Trois années plus tard ces outils “agentiques” qui ne fonctionnaient absolument pas en dehors des labos, ou alors très très très mal et de manière à décourager quiconque, y compris celles et ceux qui ont connu les ordinateurs des années 80 et leurs supports de stockage sur cassettes audio, ont actuellement des descendants qui commencent à être efficaces. Ils “agissent” en ligne ou en local sur nos machines. Le “Browser-based agent”, le “Computer Use” et le “Cowork” sont des concepts qui envahissent les marchés créés par les acteurs de la Silicon Valley et leurs équivalents chinois. Et la technologie qui permet ça, c’est celle des LLM. Les LLM sont devenus des couches d’orchestration interprétative. Ils servent à orchestrer l’accès à des outils de plus en plus nombreux et divers.

Les LLM sont des interfaces linguistiques homme-machine et machine-machine. Tout au long de ces dernières années, celles et ceux que j’ai eu le plaisir de rencontrer lors de formations, de conférences, d’événements ou lors d’accompagnements sur la longueur dans les organisations, m’ont souvent entendu dire qu’il ne fallait pas, ou “pas que”, regarder et utiliser les LLM comme de simples algorithmes à générer du texte. Ils sont plus que ça. Le langage est devenu l’interface universelle d’accès aux fonctions et aux outils, et les LLM en sont le médiateur. On peut voir tout ce mouvement technique comme une reconfiguration de la chaîne de décision entre intention et action.

Avant - oui c’est une phrase de vieux que je commence ici -, depuis l’intégration des interfaces graphiques, l’utilisateur manipulait ces interfaces pour atteindre des fonctions. Maintenant, ce même utilisateur exprime par le langage une intentionnalité d’action, plus encore une intentionnalité de but, et le système piloté par un LLM décide quelle(s) fonction(s) appeler, et dans quel ordre, pour effectuer cette action ou atteindre ce but.

Et dans cette histoire, l’utilisateur, c’est toi.

Toi, ton rôle est simple. Tu as juste à dire ce que tu veux. Exprimer où tu veux aller, ce que tu souhaites obtenir ou non, voire ce que tu ressens ou non. Mais en fait, dire et verbaliser correctement ton intentionnalité, c’est ça le plus difficile pour toi quand tu parles à une machine. Pourtant tu y es habitué, non ? Car c’est souvent encore bien plus difficile d’exprimer ton intentionnalité, ce que tu as dans ta tête et parfois dans ton cœur ou tes tripes, face à un de tes semblables carbonés. Alors que c’est un jeu que tu devrais maitriser parfaitement. Tu y joues en permanence depuis que tu as acquis le langage.

Cette semaine la partie de cette newsletter gérée par l’IA, les 3 clusters d’articles, a été générée par Claude Sonnet 4.6 + skill pour les résumés des sources, ainsi que la génération des clusters et des titres. Comme d’habitude j’ai fait quelques modifications, mais j’ai aussi laissé quelques tournures typiques des modèles de langage. Et bien entendu, mes commentaires éventuels sont en italique dans ces résumés. Le texte de “l’article qui fait réfléchir” est issu de Claude Opus 4.7. L’image d’illustration ci-dessous a été générée par Midjourney

📰 Les 3 infos de la semaine

⏱️ Stanford dresse le bilan d'une IA qui progresse plus vite que ses garde-fous

L’édition 2026 du rapport annuel de Stanford sur l’IA de 400 pages, sorti cette semaine, documente ce que vous suspectiez : ça ne ralentit pas. Sur SWE-bench, les scores des meilleurs modèles sont passés de 60 % à près de 100 % en un an. Sur Humanity’s Last Exam les meilleurs modèles dépassent 50 %, contre 8,8 % un an plus tôt. Stanford note que les benchmarks censés mesurer ce progrès ont des taux d’erreur allant jusqu’à 42 %, et que les grands labs ont cessé de publier les paramètres de leurs modèles. On mesure donc quelque chose avec des outils cassés, en aveugle.

La compétition États-Unis / Chine se resserre : les premiers dominent le nombre de modèles et la puissance de calcul (5 427 data centers), la seconde mène sur les publications scientifiques, les brevets et la robotique industrielle : 295 000 robots installés en 2024, contre 34 200 aux États-Unis.

Les chiffres d’infrastructure donnent le vertige : 29,6 gigawatts pour faire tourner les data centers d’IA mondiaux, soit l’équivalent de la consommation de pointe de l’État de New York. L’entraînement de Grok 4 seul : entre 72 000 et 140 000 tonnes de CO₂. Investissement mondial en 2025 : 581 milliards de dollars, le double de 2024.

Sur l’emploi, le fossé experts/public est vertigineux : 73 % des spécialistes voient un impact positif sur le travail, contre 23 % du public. L’emploi des développeurs de 22 à 25 ans a reculé de 20 % depuis 2022. La confiance dans la régulation reste faible : 31 % des Américains font confiance à leur gouvernement pour encadrer l’IA, le score le plus bas des pays sondés. On les comprend.

Pourquoi est-ce important ? Ce rapport annuel est un rappel : ça va vite. Certainement trop vite pour les humains que nous sommes.

Pour aller plus loin : Stanford, MIT Technology Review, IEEE Spectrum

👌 Codex : de l'assistant de code à la super app

OpenAI a mis à jour Codex cette semaine. La plateforme revendique 3 millions de développeurs hebdomadaires, et la nouveauté principale est le computer use en arrière-plan : sur macOS, Codex peut désormais voir, cliquer et taper dans n’importe quelle application de l’ordinateur, sans interrompre l’utilisateur. Plusieurs agents travaillent en parallèle sur la même machine. Pour Windows, c’est prévu “bientôt”.

Au programme : un navigateur intégré pour prévisualiser et annoter des interfaces web, la génération d’images via gpt-image-1.5, et plus de 90 nouveaux plugins connectant Codex à GitLab, Atlassian, Microsoft Suite, Slack ou Google Calendar. L’agent peut scanner plusieurs applications en une requête et vous produire une liste de priorités pour la journée. C’est vendu comme un gain de productivité. C’est aussi une façon de rester dans Codex le plus longtemps possible.

Deux fonctions de persistance s’ajoutent à l’ensemble : une mémoire, actuellement en preview, qui retient préférences et corrections entre sessions, et les “Heartbeat Automations”, qui permettent à Codex de planifier des tâches futures et de s’activer automatiquement pour les exécuter. Cette évolution s’inscrit dans une stratégie ouvertement assumée par OpenAI : construire une “super app” en élargissant progressivement les capacités de Codex.

Pourquoi est-ce important ? C’est exactement ce qu’Anthropic fait avec son application. OpenAI et Anthropic sont vraiment inséparables. Un vrai couple infernal… non ?

Pour aller plus loin : VentureBeat,The Verge, TechCrunch, Ars Technica, OpenAI

🎨 Anthropic offre à votre chef de produit à n’importe qui un outil de design avec Claude Design et Opus 4.7

Anthropic a lancé Claude Design le 17 avril – outil de création de prototypes interactifs, présentations et supports visuels à partir d’une description en langage naturel, disponible en preview pour les abonnés payants. Le même jour, le directeur produit d’Anthropic a démissionné du conseil d’administration de Figma. Coïncidence certainement.

L’outil est alimenté par Claude Opus 4.7, également lancé ce même jour, avec des capacités visuelles sensiblement améliorées. En phase d’initialisation, Claude Design lit la base de code et les fichiers de design d’une équipe pour construire un système de design – typographie, couleurs, composants – appliqué automatiquement à chaque nouveau projet. Un design finalisé peut être transmis à Claude Code en une instruction, formant une chaîne continue de l’idée au code de production. Les exports vers Canva, PDF, PPTX ou HTML permettent de s’intégrer dans des workflows existants.

Les retours des premiers utilisateurs sont positifs. Anthropic cible explicitement les fondateurs d’entreprises, chefs de produit et responsables marketing qui n’ont jamais ouvert Figma. Figma détient 80 à 90 % du marché de la conception UI/UX. Les deux sociétés minimisent la tension. Le marché a, lui, bien lu un signal.

Pourquoi est-ce important ? Rendre la création de prototypes et de designs de tous les ordres accessible aux non-designers, c’est le but de plusieurs acteurs en ce moment. Adobe vient de faire aussi un pas dans ce sens en intégrant la possibilité de donner des instructions en langage naturel à ses outils - voir plus juste ci-dessous.

Pour aller plus loin : VentureBeat, TechCrunch, Anthropic

🚀 7 lectures en plus

Adobe embraces conversational AI editing, marking a ‘fundamental shift’ in creative work (The Verge)

Gemini can now pull from Google Photos to generate personalized images (The Verge)

Google now lets you explore the web side-by-side with AI Mode (TechCrunch)

🚨 43% of AI-generated code changes need debugging in production, survey finds (VentureBeat)

Google develops its own desktop Agent to compete with Cowork (TestingCatalog)

The Hidden Costs of AI Shopping Payments (The Information)

How robots learn: A brief, contemporary history (MIT Technology Review)

🛠️ Des outils, des tutos et des modèles à tester

🧠 L’article qui fait réfléchir - et qu’il faut absolument lire

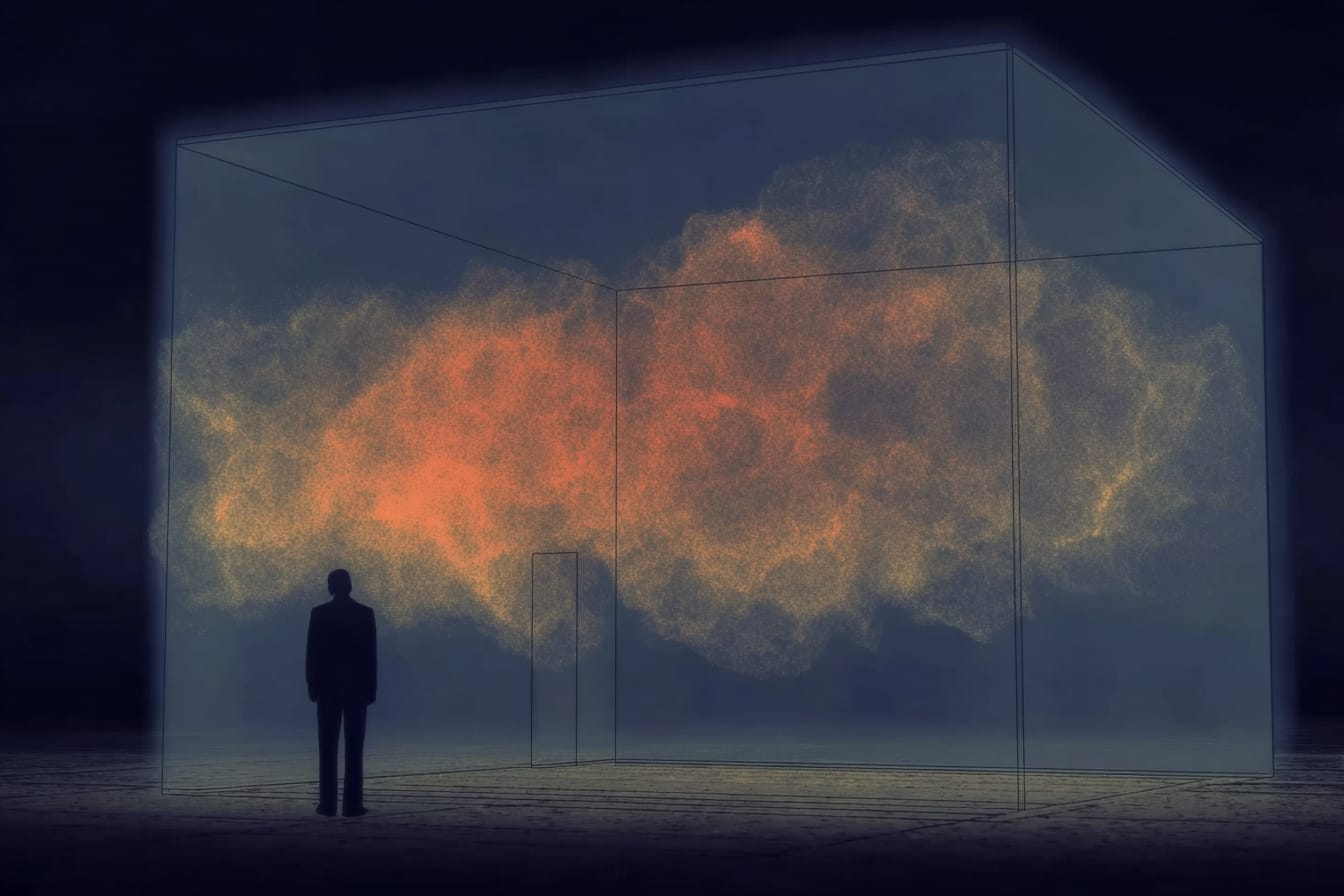

The Code Is Not the Law: Why Claude’s Constitution Misleads

“Give me something to believe in”

Il y a quelque chose d’effarant au moment où une entreprise privée s’approprie le vocabulaire du droit public pour décrire les règles internes d’un logiciel. Constitution, principes supérieurs, hiérarchie d’autorité, sagesse pratique : ces mots ne sont pas neutres. Ils portent une histoire — celle d’un long travail politique visant à limiter le pouvoir de ceux qui gouvernent en le confiant à plusieurs mains. Rédacteurs, exécutants, interprètes : la séparation n’est pas cosmétique, elle est la condition même de la légitimité. Quand un seul acteur écrit la règle, l’applique, la révise et décide des exceptions, il ne s’agit plus d’un dispositif constitutionnel mais d’une souveraineté commerciale déguisée en promesse morale.

Cette appropriation produit un effet secondaire plus discret : elle déplace l’attention. Prêter à un système conversationnel un « caractère », une « prudence », une « intégrité », revient à installer dans l’imaginaire public l’idée qu’un agent moral se tient quelque part, à l’autre bout du câble. La figure est rassurante. Elle est surtout trompeuse. Ce qui décide n’est pas une conscience en formation, mais un empilement de contrats, de conditions d’usage, de contraintes produit et d’impératifs concurrentiels, tous modifiables à la prochaine mise à jour. L’ironie tient à ceci : les équipes qui construisent ces modèles reconnaissent elles-mêmes que leur fonctionnement interne leur échappe. On nous demande donc d’avoir confiance et de juger la vertu d’un dispositif dont la mécanique reste opaque à ses propres auteurs.

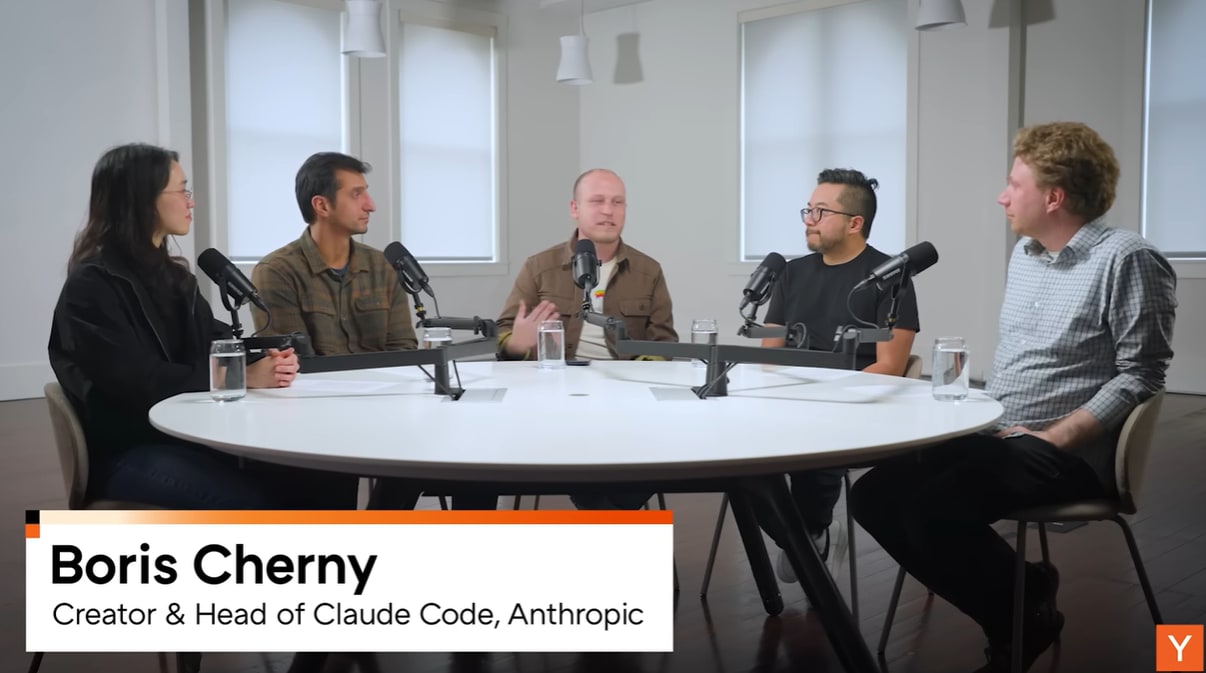

📻 Le podcast de la semaine

AI Engineer : State of the Claw — Peter Steinberger

Peter Steinberger fait le point après 5 mois sur OpenClaw, le projet open source qui connaît la croissance la plus rapide de l’histoire, et nous explique ce que cela implique d’en être le responsable, de la sécurité à la communauté.

N’hésitez à me contacter si vous avez des remarques et suggestions sur cette newsletter, ou si dans votre entreprise vous cherchez à être accompagnés dans l’intégration d’outils IA et d’IA générative : olivier@255hex.ai

Partagez cette newsletter

Et si vous n’êtes pas abonné, il ne tient qu’à vous de le faire !

“We’re changing that today with a set of updates for AI Mode and Chrome!

Now, when you’re using AI Mode in Chrome desktop, clicking a link opens the webpage right next to your search. You can visit the webpage and ask follow-up questions without ever losing your context—or your mind :)

We want to make it effortless to engage with the web, not just search it. By losing the friction of tab-switching, it’s much easier to stay focused on the incredible content you discover.” Elizabeth Reid, VP Search, Google