« L’humanité va se scinder en deux » : interview choc et confessions explosives d’OpenAI

Fini les discours rassurants sur le progrès technologique. Le patron d’OpenAI vient de livrer sa véritable feuille de route pour la décennie à venir, et elle a de quoi donner le vertige. Militarisation assumée de ses algorithmes, fin programmée du salariat de masse et, surtout, mutation forcée de l’espèce humaine : Sam Altman ne se contente plus de vouloir « disrupter » des marchés, il annonce la fin du monde tel que nous le connaissons. Plongée dans l’esprit d’un démiurge rattrapé par sa propre créature.

Le pape de l’intelligence artificielle a brisé le silence. Dans une interview historique aux allures de testament anticipé accordée à la journaliste Laurie Segall pour son podcast Mostly Human, Sam Altman, le PDG d’OpenAI, s’est livré avec une franchise déconcertante.

L’heure est grave dans la Silicon Valley : le monde digère encore l’abandon brutal de Sora, le générateur de vidéos ultra-réalistes d’OpenAI, tandis que des procès monstres frappent de plein fouet les géants historiques de la tech.

Tiraillé entre la puissance vertigineuse de sa création et la terreur de ses conséquences sociétales, le père de ChatGPT se dévoile. Est-il l’architecte d’un nouvel âge d’or ou le fossoyeur de notre humanité ? Récit d’une confession sans précédent.

Le sacrifice à un milliard de dollars : pourquoi Sora devait mourir

C’était la machine à rêves (et à cash) ultime d’OpenAI, l’outil capable de faire trembler Hollywood sur ses bases. Pourtant, Sora a été débranché en plein vol. Derrière ce coup de tonnerre, Sam Altman lève le voile sur une décision qu’il qualifie de « très difficile », motivée par un spectre bien précis : l’addiction.

Le milliardaire a révélé qu’il avait initialement prévu d’intégrer Sora directement au cœur de ChatGPT. Mais à la dernière minute, OpenAI a fait machine arrière. La raison ? La crainte viscérale de concevoir des mécanismes de récompense poussant à une dépendance incontrôlable chez les utilisateurs.

Un choix d’une actualité brûlante : l’interview intervient au moment même où la justice américaine compare les géants du net à l’industrie du tabac.

La semaine précédente, des jurys de Los Angeles et du Nouveau-Mexique ont condamné Meta et Google à payer des centaines de millions de dollars (dont une amende record de 375 millions pour la maison mère de Facebook) pour avoir sciemment rendu les adolescents accros à leurs plateformes. Altman l’assure, il ne voulait pas que Sora devienne la prochaine drogue numérique.

La guerre secrète des serveurs

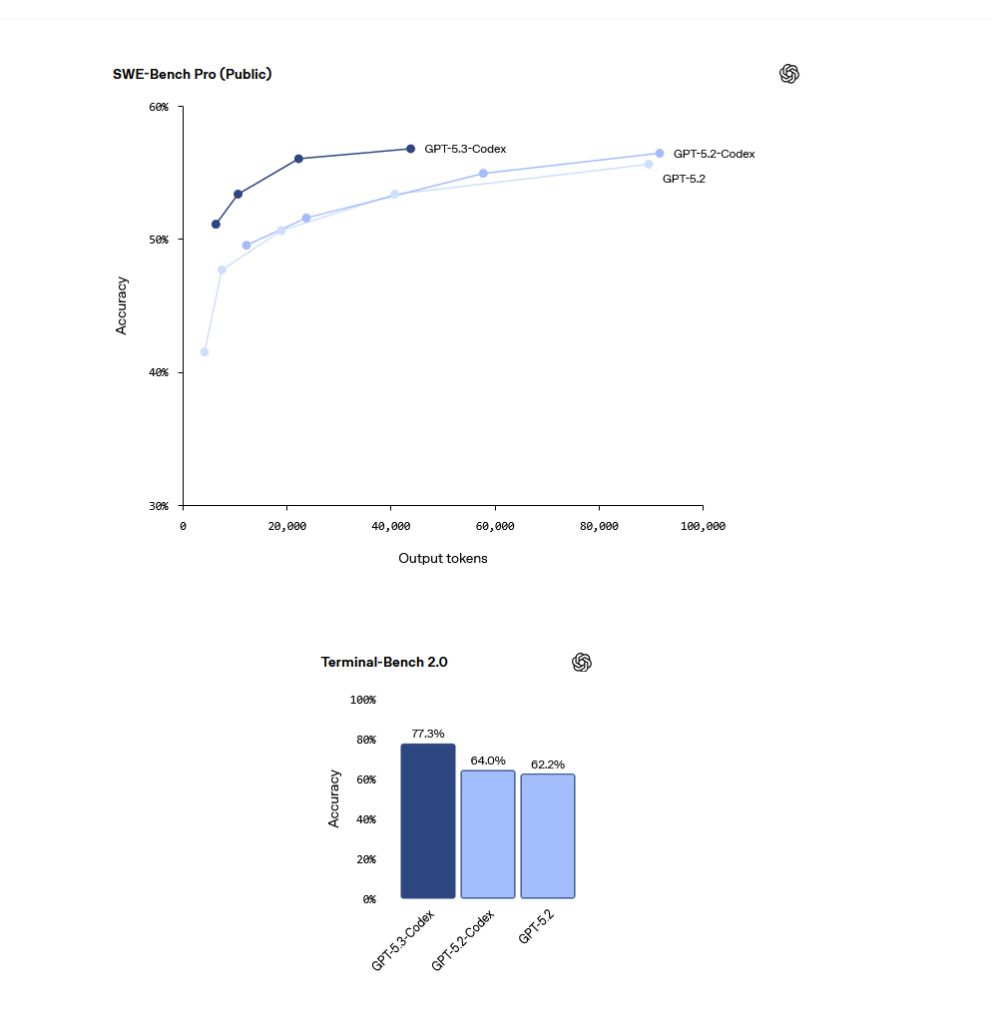

OpenAI Brad Lightcap says model training cycles are collapsing, driving rapid jumps from GPT-5.1 to 5.4

— Haider. (@slow_developer) April 2, 2026

GPT-5.4 is days old and already doing a $1B run rate revenue, processing 5 trillion tokens daily

"by year's end, we'll laugh at today's models. they'll seem pedestrian" pic.twitter.com/0F2saR4FI6

Mais l’éthique n’est que la face visible de l’iceberg. L’autre raison de l’exécution de Sora est purement pragmatique : la guerre sans merci de la puissance de calcul (compute).

Pour donner naissance à sa prochaine génération d’IA, OpenAI se devait de rationner drastiquement ses ressources. Maintenir Sora en vie aurait vampirisé les serveurs de l’entreprise.

Ce choix clinique a eu un prix colossal. Altman confesse s’être senti « très mal » au moment de décrocher son téléphone pour appeler personnellement Josh D’Amaro, grand patron chez Disney, afin de faire une croix sur un partenariat pharaonique d’un milliard de dollars.

Pour qu’OpenAI reste le maître incontesté de l’intelligence artificielle et forge l’outil ultime de demain, Sora devait être sacrifié sur l’autel de la recherche.

Le pacte avec le Pentagone : quand l’IA s’enrôle

Si le sacrifice de Sora a secoué le monde du divertissement, c’est sur le terrain militaire que Sam Altman a dû essuyer les tirs les plus nourris.

L’interview aborde de front la controverse qui a enflammé l’opinion en février 2026 : l’ouverture officielle des modèles d’OpenAI aux réseaux classifiés du Département de la Défense américain. Fini le pacifisme candide des débuts de la Silicon Valley ; l’IA a enfilé le treillis.

Face à Laurie Segall, Altman amorce un mea culpa stratégique. Il admet volontiers avoir « mal calibré » le niveau de méfiance et la virulence de la réaction du public face à cette alliance avec le Pentagone. Pourtant, il ne recule pas d’un pouce sur le fond. Mieux, il justifie ce pacte par une position politique tranchée, rare pour un magnat de la tech.

Pour le PDG d’OpenAI, refuser de soutenir son propre gouvernement par principe ou idéologie serait une erreur fatale. « Il est très important que les gouvernements soient les plus puissants », assène-t-il, rejetant l’idée qu’une poignée de PDG non élus devraient dicter la géopolitique mondiale.

Altman assume un patriotisme technologique décomplexé : face aux superpuissances rivales, l’intelligence artificielle américaine doit servir l’État souverain. Une ligne dure qui marque un tournant définitif : OpenAI n’est plus seulement une entreprise de recherche, c’est désormais une infrastructure critique de la sécurité nationale américaine.

L’apocalypse de l’emploi et l’avènement du « Milliardaire Solitaire »

Une fois le parapluie militaire assumé, Altman a lâché ce qui ressemble fort à une bombe à fragmentation sur le marché du travail mondial. Fini les discours lénifiants sur l’IA qui viendrait simplement « augmenter » les travailleurs sans les remplacer. Le vernis craque : Altman reconnaît froidement que la transition à court terme entraînera « une énorme perte d’emplois ».

L’accélération est telle qu’elle donne le vertige. Le milliardaire décrit un avenir immédiat où des armées de « chercheurs en IA automatisés » seront capables de condenser une décennie entière de découvertes scientifiques en l’espace d’une seule année.

Un bond en avant spectaculaire pour la médecine ou l’ingénierie, mais qui a un corollaire brutal : la destruction pure et simple de millions de postes de travailleurs du savoir. Le travail tel que nous le connaissons va être pulvérisé.

Cependant, sur les cendres de cet ancien monde, Altman prophétise l’émergence d’un nouveau capitalisme radical. Bienvenue dans l’ère du « Milliardaire Solitaire ».

OpenAI CEO Sam Altman was asked if the next billion dollar company could be created by a solo entrepreneur and AI agents

— Small Cap Snipa (@SmallCapSnipa) April 3, 2026

His answer: “I believe it has happened”

A legitimate single person billion dollar business has been created with just AI agents

The agentic era of AI is… pic.twitter.com/F59xQ5w9LR

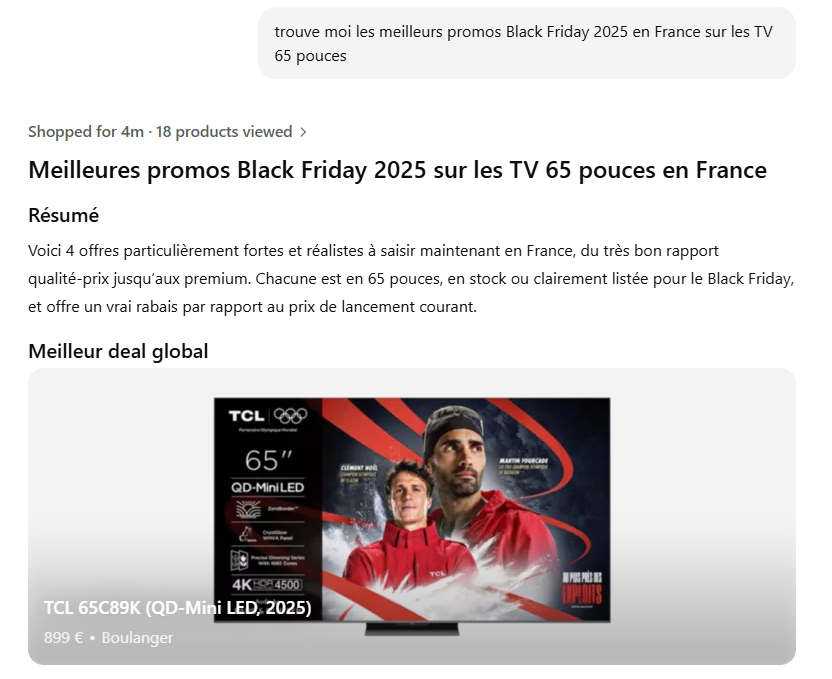

Grâce à des agents IA autonomes capables de coder, de gérer le marketing, d’optimiser les chaînes logistiques et de prendre des décisions stratégiques en temps réel, un simple créateur isolé (solo-founder) pourra bientôt bâtir et diriger une entreprise valorisée à un milliard de dollars depuis son salon.

L’IA promet une « ère d’abondance », mais elle redessinera les lignes de la richesse : des empires colossaux gérés par un seul être humain, aux commandes d’une armée de fantômes numériques.

Bébés augmentés et « zones sans IA » : le choix vertigineux des futurs parents

Si les déclarations d’Altman sur l’économie et la guerre ont de quoi faire frémir, c’est sur le terrain intime que l’interview bascule dans la science-fiction la plus troublante. Depuis qu’il est devenu père en 2025, le PDG avoue que son cerveau a été « totalement recâblé ».

Comment élever un enfant dans un monde qui s’apprête à être fondamentalement altéré par la technologie qu’il a lui-même créée ?

C’est en répondant à cette question qu’Altman lâche la prophétie la plus folle et la plus effrayante de cet entretien : la scission inéluctable de l’espèce humaine. Pour lui, l’étape finale n’est pas la simple cohabitation avec l’IA, mais l’assimilation. Il théorise une transition inévitable où l’humanité passera de son état purement biologique à une fusion totale avec l’intelligence numérique.

Le vertige saisit le lecteur lorsqu’il décrit la société de demain, irrémédiablement divisée en deux camps. D’un côté, ceux qui embrasseront cette hybridation pour devenir « inimaginablement intelligents », des posthumains aux capacités cognitives dopées par le silicium.

De l’autre, les « puristes », ceux qui refuseront l’augmentation. Pour ces derniers, Altman imagine déjà la création de « zones sans IA » (AI-free zones), de véritables réserves sanctuarisées où ils pourront continuer à vivre une existence humaine classique, déconnectée de la matrice globale.

Un choix existentiel brutal qui s’imposera bientôt à chaque parent : faire de son enfant un dieu numérique, ou l’isoler dans une réserve biologique.

De quel côté de la frontière serez-vous ?

À l’issue de cet entretien-choc, le portrait de Sam Altman qui se dessine est celui d’un Prométhée moderne, terrifié par le feu qu’il vient de livrer aux hommes, mais incapable – et désireux de ne pas – l’éteindre.

Il incarne toute la dualité de la Silicon Valley d’aujourd’hui : un idéalisme absolu quant au potentiel salvateur de la technologie, couplé à un pragmatisme froid face aux dommages collatéraux inévitables.

En sacrifiant Sora, en s’alliant au Pentagone et en prédisant l’effondrement du travail traditionnel, le patron d’OpenAI nous prévient que la phase d’expérimentation amusante de l’IA est bel et bien terminée. L’heure des choix titanesques a sonné.

À la lecture de ses confessions, une certitude glaçante s’impose : la question n’est plus de savoir si cette révolution va balayer notre monde d’ici la fin de la décennie. La seule véritable question qui nous reste est de savoir dans laquelle de ces deux humanités nous choisirons de vivre.

Et vous, serez-vous dans le camp post-humains hybrides, ou dans celui des puristes qui se réfugient dans leurs zones sans IA ? Partagez votre avis en commentaire !

Cet article « L’humanité va se scinder en deux » : interview choc et confessions explosives d’OpenAI a été publié sur LEBIGDATA.FR.