Promesses et défis de la révolution IA dans les systèmes de santé en transition : l’exemple du Maroc

L’intelligence artificielle se développe au Maroc dans plusieurs établissements hospitaliers, comme outils d’aide au diagnostic, en télémédecine pour la prise en charge de populations rurales, etc. Les premiers résultats sont prometteurs. Mais ces technologies posent aussi nombre de questions d’ordre éthique, juridique et aussi de fiabilité. Par exemple, le fait que la plupart des systèmes d’IA en santé soient développés sur des données issues de populations occidentales pose question.

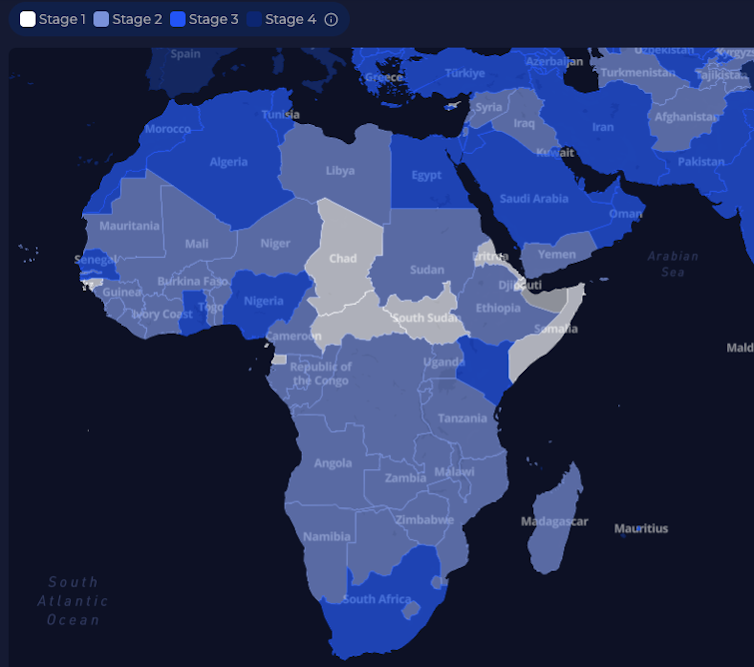

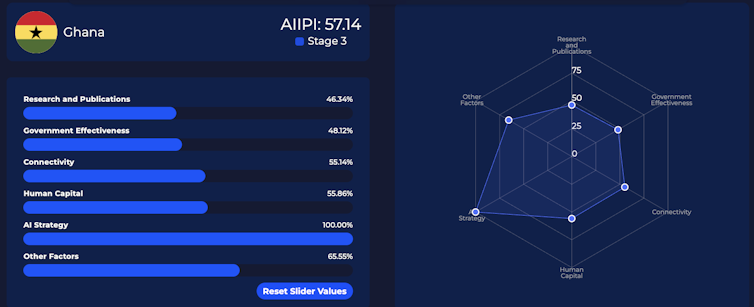

Le Maroc a franchi un cap symbolique en 2024 avec le lancement de sa stratégie nationale de développement de l’intelligence artificielle et la feuille de route « Maroc IA 2030 » qui a placé la santé parmi ses secteurs prioritaires.

À lire aussi : L’Afrique à l’assaut de l’IA, avec le Rwanda, le Maroc et le Kenya en moteurs

Cette ambition intervient alors que l’Organisation mondiale de la santé (OMS) estime que l’IA pourrait améliorer significativement l’accès aux soins dans les pays à ressources limitées.

Mais comment cette révolution technologique peut-elle s’adapter aux réalités du système de santé marocain, entre espoirs légitimes et défis considérables ?

Des applications concrètes qui transforment déjà la pratique médicale

L’intelligence artificielle commence à s’implanter dans plusieurs hôpitaux marocains, particulièrement dans les centres hospitaliers universitaires de Casablanca et Rabat. Les algorithmes d’aide au diagnostic médical montrent des résultats prometteurs, notamment en radiologie où ils détectent avec une précision comparable aux radiologues expérimentés certaines anomalies pulmonaires ou osseuses.

Prenons l’exemple concret d’une radiographie thoracique : là où un radiologue peut mettre plusieurs minutes à analyser l’image et rédiger son compte-rendu, un algorithme d’IA peut identifier en quelques secondes les zones suspectes, signalant par exemple une pneumonie ou une tumeur potentielle. Le médecin garde bien sûr le dernier mot, mais dispose d’une aide précieuse, particulièrement dans les services surchargés.

La télémédecine constitue un autre domaine d’application majeur. Dans un pays où les disparités géographiques d’accès aux soins restent importantes, les systèmes d’IA permettent de faire le lien entre patients des zones rurales et spécialistes urbains.

Imaginons une patiente diabétique vivant dans une région reculée de l’Atlas : grâce à une application mobile équipée d’IA, elle peut photographier ses analyses de sang, recevoir une première analyse automatisée et être mise en relation avec un endocrinologue si nécessaire, sans avoir à parcourir des centaines de kilomètres.

La gestion hospitalière bénéficie également de ces technologies. Les algorithmes prédictifs aident à anticiper les besoins en ressources, à optimiser la planification des blocs opératoires et à gérer les stocks de médicaments. Un système d’IA peut par exemple prédire les pics d’affluence aux urgences en fonction de multiples facteurs (épidémies saisonnières, accidents, conditions météorologiques) et permettre d’ajuster les effectifs en conséquence.

Des défis éthiques et juridiques à ne pas sous-estimer

L’enthousiasme technologique ne doit pas occulter des questions fondamentales. La protection des données de santé constitue le premier enjeu. Le Maroc dispose certes d’une loi sur la protection des données personnelles, mais son cadre juridique reste encore incomplet concernant spécifiquement les données de santé et leur utilisation par des algorithmes d’IA.

Concrètement, que se passe-t-il lorsqu’un hôpital collecte les dossiers médicaux de milliers de patients pour entraîner un algorithme ? Qui a accès à ces données ? Comment garantir leur anonymisation ? Peuvent-elles être transférées à l’étranger pour être traitées par des entreprises technologiques internationales ? Ces questions restent largement sans réponse.

L’équité d’accès représente un autre défi majeur. Si l’IA est déployée prioritairement dans les grands centres urbains, elle risque d’accentuer les inégalités territoriales existantes. Un cardiologue de Casablanca pourrait bénéficier d’un électrocardiogramme analysé instantanément par IA, tandis qu’un médecin généraliste isolé dans une commune rurale continuerait à travailler avec des moyens limités.

La question de la responsabilité médicale soulève également des interrogations inédites. Imaginons qu’un algorithme rate un diagnostic de cancer sur une mammographie et que la patiente ne soit diagnostiquée que des mois plus tard, à un stade avancé. Qui est responsable : le radiologue qui a validé l’analyse automatisée, l’établissement qui a adopté le système, ou la société qui l’a développé ? Le cadre juridique marocain actuel n’apporte pas de réponses claires.

Les biais algorithmiques, un risque invisible mais réel

Un problème plus subtil mais tout aussi crucial concerne les biais des algorithmes. La plupart des systèmes d’IA en santé sont développés sur des données issues de populations occidentales. Leur transposition directe au contexte marocain pose question : les particularités génétiques, épidémiologiques et socioculturelles de la population marocaine sont-elles suffisamment représentées ?

Un exemple parlant : un algorithme de diagnostic dermatologique entraîné principalement sur des peaux claires pourrait avoir des difficultés à détecter correctement un mélanome sur une peau plus foncée. De même, un outil d’évaluation du risque cardiovasculaire calibré sur des populations européennes pourrait sous-estimer ou surestimer les risques pour des patients marocains ayant un profil génétique et des habitudes alimentaires différents.

Des recherches internationales ont démontré que des algorithmes peuvent reproduire voire amplifier des discriminations existantes. Dans le contexte marocain, cela pourrait également se traduire par des performances dégradées pour certaines populations déjà vulnérables.

Vers une adoption responsable et adaptée

Pour que l’intégration de l’IA dans le système de santé marocain soit réellement bénéfique, plusieurs conditions doivent être réunies. D’abord, développer un cadre réglementaire spécifique combinant protection des données, certification des algorithmes médicaux et définition des responsabilités. L’Union européenne a récemment adopté une législation sur l’IA (l’AI Act) dont le Maroc pourrait s’inspirer.

Ensuite, investir massivement dans la formation des professionnels de santé. L’IA ne remplacera pas les médecins mais transformera leurs pratiques. Un jeune médecin marocain doit aujourd’hui apprendre non seulement la sémiologie clinique traditionnelle, mais aussi à interpréter les recommandations d’un algorithme, à identifier ses limites et à conserver son esprit critique.

La recherche locale en IA santé doit également être encouragée. Les universités marocaines doivent développer des algorithmes entraînés sur des données locales, reflétant les spécificités de la population et des pathologies prévalentes au Maroc.

Enfin, une approche inclusive s’impose. Le déploiement de l’IA en santé doit s’accompagner d’investissements dans les infrastructures de base : connectivité Internet dans les zones rurales, équipements médicaux numériques, formation du personnel… L’objectif étant que la technologie serve à réduire les inégalités plutôt qu’à les creuser.

L’intelligence artificielle offre au Maroc une opportunité historique de moderniser son système de santé et d’améliorer l’accès aux soins de millions de citoyens. Mais cette transformation ne réussira que si elle s’accompagne d’une réflexion éthique approfondie, d’un cadre juridique adapté et d’une volonté politique de garantir l’équité.

La technologie n’est qu’un outil : c’est la manière dont nous choisissons de l’utiliser qui déterminera si elle servira réellement l’intérêt général.

Oumaima Omari Harake ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.