Quand les IA font des rapprochements trompeurs

Connaissez-vous les « corrélations fallacieuses » ? Si les humains apprennent à ne pas se laisser berner par ces liens logiques apparents, les IA ont plus de mal.

Et si les ventes de dictionnaires en Allemagne étaient liées au nombre d’inscriptions à des cours de natation au Japon ? Et si la production d’énergie solaire à Taïwan influençait le cours en bourse de Netflix ?

On apprend très tôt qu’il y a une distinction entre corrélation et causalité : un lien n’explique toujours pas une cause. Notre cerveau cherche malgré tout un sens et des explications logiques lorsqu’il analyse des données : des lignes qui suivent la même inclinaison, des barres qui s’élèvent ensemble, ou encore des points qui se regroupent dans un diagramme. Instinctivement, il semble peu probable que la consommation de chocolat par habitant d’un pays soit corrélée au nombre de ses lauréats du prix Nobel : il s’agit là d’une « corrélation fallacieuse ».

Une équipe de recherche d’Apple a publié en septembre 2024 un article illustrant comment une banale modification de prénoms ou d’attributs des personnages d’un énoncé mathématique diminuait jusqu’à 10 % la part de réponses correctes fournies par diverses intelligences artificielles génératives. Ces liens, apparemment logiques, entraînent des corrélations fallacieuses. Imaginez un peu demander à une IA : « Adam a une pomme et Eve en a deux, combien ont-ils de pommes ? », puis lui demander ensuite : « Ada a une pomme et Evan en a deux, combien ont-ils de pommes ? » et obtenir des réponses différentes ! Pour un enfant, il parait clair que la présence d’Adam plutôt qu’Ada dans l’énoncé du problème ne change pas la réponse. Pour une IA, ce n’est pas si simple.

Comment se fait-il que nous arrivions à comprendre instantanément qu’il s’agit là de corrélations fallacieuses, là où les IA peuvent manifestement se laissent berner ?

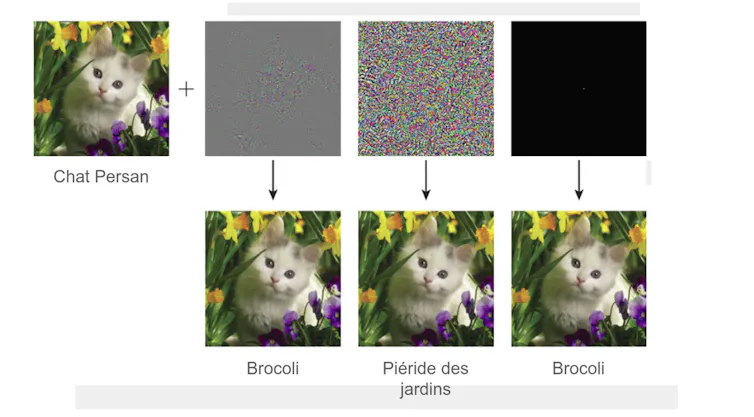

Ce problème n’est pas anecdotique, puisque certains types d’IA sujettes à ces méprises logiques sont utilisés pour des systèmes critiques de sécurité informatique. Elles sont vulnérables à un type d’attaque appelé parfois apprentissage antagoniste ou « adversarial attacks ».

Pour pallier ce problème, les chercheurs développent des méthodes qui permettent de corriger les processus d’apprentissage des IA en identifiant les caractéristiques parasites qui mènent à des corrélations fallacieuses.

Tous les quinze jours, des grands noms, de nouvelles voix, des sujets inédits pour décrypter l’actualité scientifique et mieux comprendre le monde. Abonnez-vous gratuitement dès aujourd’hui !

Comment les IA de type « GPT » apprennent-elles des corrélations fallacieuses ?

Pour comprendre comment les « GPT », ces IA qui semblent si prometteuses, se prennent les pieds dans le tapis des corrélations fallacieuses, il faut comprendre comment elles fonctionnent.

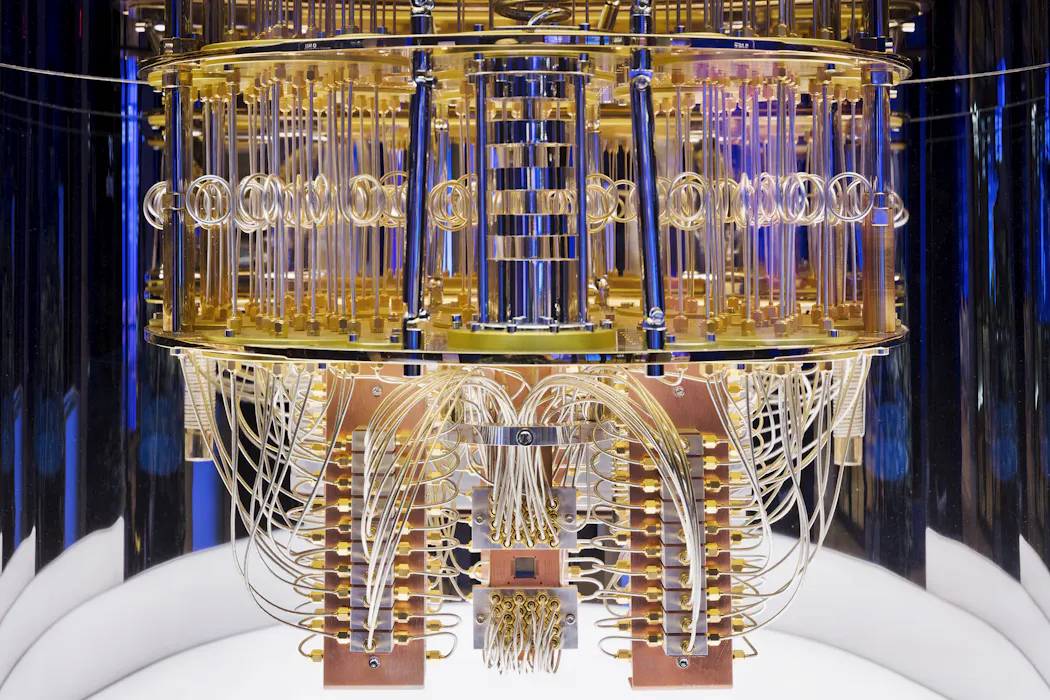

Parmi les modèles évalués dans la publication de septembre 2024 d’Apple, il y a GPT-4o, alors dernière création de la société OpenAI. Derrière le succès du GPT-4o, il y a un réseau de neurones Transformeur-Génératif-Pré-entraîné (les fameux GPT).

Génératif car il vise à générer du texte, préentraîné car il peut être réentraîné pour traiter des corpus documentaires spécialisés : contrats, composition mathématique ou analyse de code logiciel par exemple.

Les GPT appartiennent une plus grande famille de modèles appelés grands modèles de langage (LLM pour Large Language Model). Les LLM ont contribué à transformer les interactions humain-machines. Ils permettent à l’utilisateur d’interagir avec la machine via des instructions en langage naturel, appelées « prompts ». Ainsi, « écris-moi un article pour The Conversation sur le thème de l’IA Générative » est une instruction valide. En retour, le LLM répondra lui aussi en langage naturel, mais l’article en question ne serait pas publié car cela serait contraire à la charte éditoriale de The Conversation !

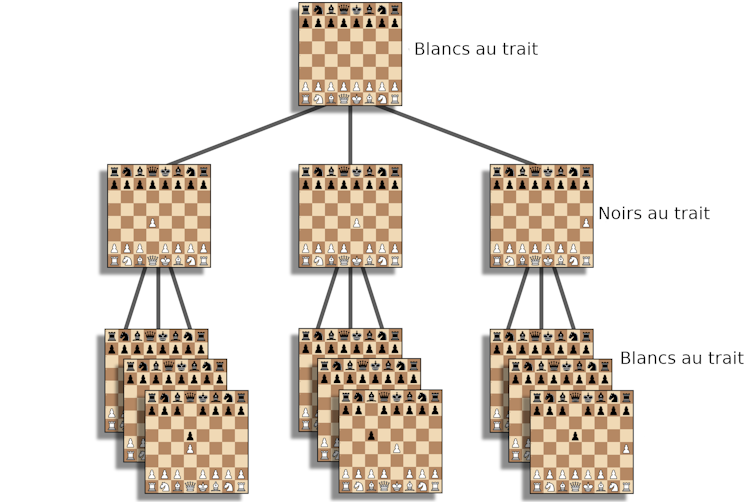

Pour préentraîner, les modèles, les chercheurs d’OpenIA ont utilisé un jeu de séquences de texte (de l’ordre du trillion de mots). Puis, à la manière d’un jeu de devinette, le transformeur doit analyser les séquences dont une partie est masquée, et prédire le contenu manquant. À chaque essai, les paramètres du modèle sont réajustés pour corriger la prédiction, c’est l’apprentissage.

Après l’entraînement, les paramètres appris permettent de représenter numériquement les relations sémantiques entre les mots (c’est le modèle de langage). Pour répondre à un utilisateur (c’est l’inférence), c’est le même processus : analyser la séquence (le prompt), prédire le mot suivant, puis le suivant, puis le suivant, etc.

Pour un utilisateur étranger au mécanisme à l’œuvre, le résultat sera bluffant, mais une fois encore, il ne s’agit que d’intelligence simulée par une machine. La syntaxe semble exacte, le raisonnement logique, les applications infinies : mathématiques, littérature, histoire ou géographie. Il ne faudra pas longtemps pour que les LLM se mettent à générer les copies des élèves, les mémoires des étudiants, ou soulager les chercheurs dans l’exécution de tâches fastidieuses.

Pourquoi est-ce dangereux en pratique ?

S’il existe des liens fallacieux dans les séquences d’entraînement, ces derniers seront intégrés lors de la phase d’apprentissage et régénérés dans la phase d’inférence. Ce phénomène de « corrélation fallacieuse » ne concerne pas que les LLM, mais plus globalement les réseaux de neurones profonds utilisant de grandes quantités de données à l’entraînement.

Dans le domaine de la sécurité informatique, des chercheurs avaient déjà alerté en janvier 2024 sur des symptômes similaires pour des LLM spécialisés dans la recherche de vulnérabilités logicielles : leur recherche montre comment une modification des noms de variables, pourtant sans impact sur la logique du code analysé, vient affecter jusqu’à 11 % la capacité du modèle à correctement identifier du code vulnérable. Tout comme dans le cas d’une modification des prénoms dans l’énoncé du problème mathématique des pommes ci-dessus, l’un des LLM audités a par exemple appris à associer les fonctions faisant appel à des variables nommées « maVariable » (souvent donné dans les exemples adressés aux débutants) et leur vulnérabilité. Pourtant, il n’existe aucune relation de cause à effet entre le nom de cette variable et la sûreté du logiciel. La corrélation est fallacieuse.

Ces LLM sont aujourd’hui utilisés dans les entreprises pour relire le code écrit par des développeurs, supposés garantir la détection des bugs logiciels. Les IA permettent d’identifier les vulnérabilités ou les comportements malveillants en sécurité informatique, ce travail d’analyse est donc crucial. Sans cela, un attaquant subtil pourrait profiler le système de détection pour identifier ces biais, le manipuler et jouer sur ces derniers pour le contourner.

C’est pourquoi, à l’instar des travaux sur l’analyse de code source, nous sommes en train d’explorer l’application des méthodes d’inférence causale pour améliorer la robustesse des réseaux de neurones utilisés par les systèmes de détection d’intrusions dans les réseaux informatiques.

Les travaux de Judea Pearl, prix Turing d’Informatique 2011, indiquent en effet que sous certaines conditions, il est possible de distinguer les corrélations probablement issues d’une relation causale de celles qui sont fallacieuses.

En travaillant sur un système de détection d’intrusions, outil qui surveille le trafic réseau pour détecter des activités suspectes, il est possible d’identifier les corrélations qui pourraient être à l’origine de biais. Nous pouvons ensuite les perturber (à l’instar d’un changement de prénom) et entraîner à nouveau le modèle de détection. Mathématiquement, la corrélation fallacieuse se retrouve marginalisée dans la masse d’exemples perturbés et le nouveau modèle est dé-biaisé.

L’IA est un outil, ne le laissons pas penser à notre place !

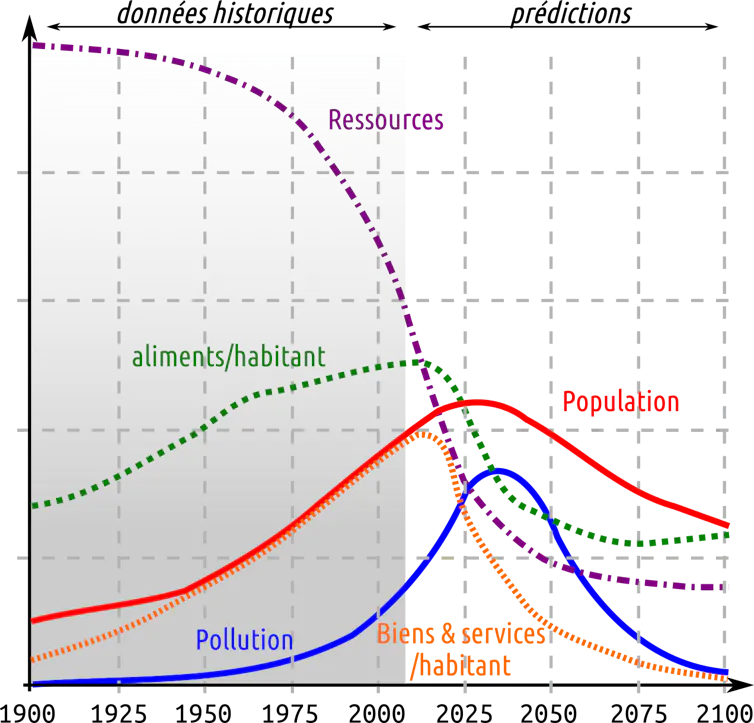

Qu’elles soient génératives ou non, les IA ayant appris des corrélations fallacieuses exposent leurs utilisateurs à des biais plus ou moins importants. Si les corrélations fallacieuses peuvent apparaître amusantes de par leur absurdité, elles peuvent également être source de discriminations.

Plus globalement, les récentes avancées en apprentissage profond, qui vont bien au-delà des IA génératives, bénéficient et vont bénéficier à de nombreux domaines, dont la sécurité informatique.

Néanmoins, bien que prometteuses, ces IA doivent être reconsidérées à leur juste place : elles peuvent certes permettre d’augmenter les capacités d’expertise, mais aussi induire des aveuglements dont les conséquences peuvent être dramatiques si l’on en vient à déléguer notre capacité de penser à des algorithmes.

Ainsi, il convient de nous éduquer au fonctionnement de ces systèmes — et à leurs limites — pour ne pas les suivre aveuglément. Le problème n’est pas tant l’absurdité d’un changement de prénom provoquant une baisse de performance, que le crédit que nous pouvons accorder au contenu généré par une IA.

Pierre-Emmanuel Arduin est membre de l'association française pour l'intelligence artificielle (AFIA).

Myriam Merad ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d'une organisation qui pourrait tirer profit de cet article, et n'a déclaré aucune autre affiliation que son organisme de recherche.